Cekura

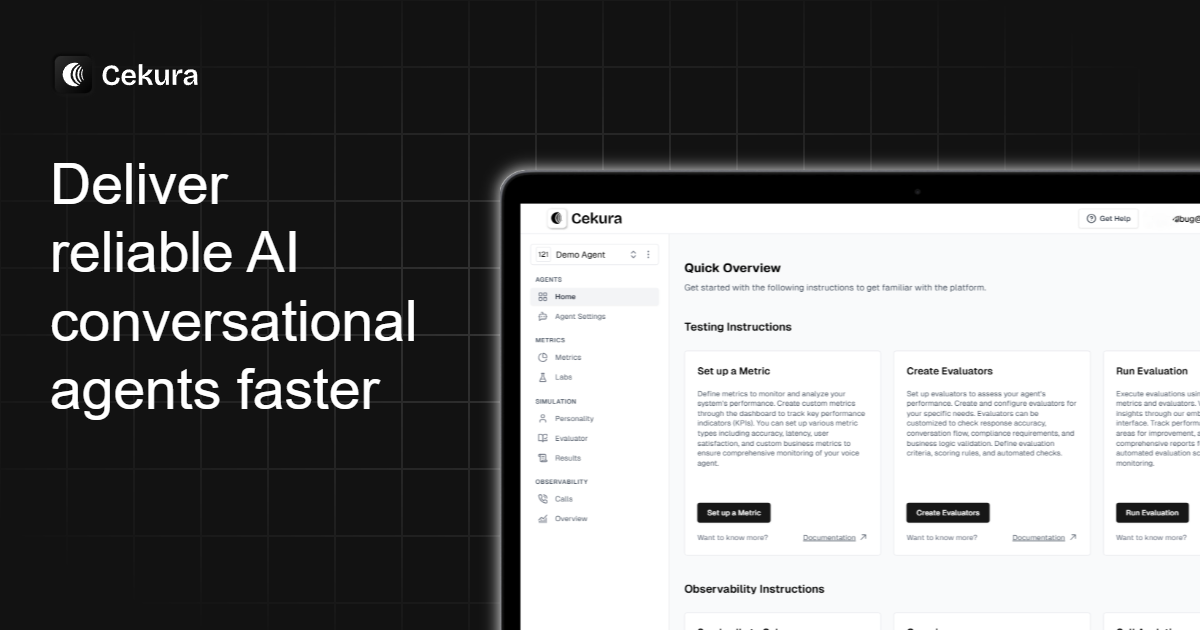

Cekura bietet End-to-End-Tests und Observability für Voice- und Chat-KI-Agenten: Vorab-Simulationen mit Personas sowie Monitoring in Produktion für Gesprächsqualität.

Was ist Cekura?

Cekura ist ein End-to-End-Testing- und Observability-Tool für konversationelle KI-Agenten, einschließlich Voice- und Chat-Systemen. Sein Kernzweck ist es, Teams dabei zu unterstützen, das Verhalten ihrer Agenten in vielfältigen Gesprächsszenarien vor dem Release zu validieren und dann echte Gespräche in der Produktion zu überwachen.

Die Plattform unterstützt Vorab-Simulationen (zur Überprüfung von Instruction-Following, Tool Calls und Gesprächsqualität) sowie Produktions-Monitoring (zur Inspektion von Calls und Identifikation von Problemen wie fehlenden Checks oder Ausfällen in erwarteten Flows).

Wichtige Funktionen

- Szenario-Simulation für Voice- und Chat-Agenten: Führen Sie Vorab-Tests über große Szenario-Sets durch, um das Agentenverhalten unter unterschiedlichen Nutzer- und Gesprächsbedingungen zu validieren.

- Persona- und Persönlichkeitsbasiertes Testing: Nutzen Sie vordefinierte Personas (z. B. verschiedene Akzente, Geschlechter und Nutzerdispositionen), um zu prüfen, ob der Agent auf variierte Gesprächsstile angemessen reagiert.

- Parallele Calls und handlungsrelevante Evaluation: Führen Sie Simulationen aus und erzeugen Sie Evaluationsergebnisse in Minuten, um Probleme in zentralen Nutzerflows aufzudecken.

- Replay bekannter Problemgespräche: Führen Sie zuvor problematische Gesprächsmuster erneut aus, um wiederkehrende Ausfälle bei Änderungen an Prompts oder Agentenlogik zu verhindern.

- Observability mit Echtzeit-Insights und Logs: Überwachen Sie Produktionsgespräche mit detaillierten Logs und Trendanalysen, um Instruction-Following, Tool Calls und Gesamtgesprächsqualität zu bewerten.

- Alerting bei Fehlern und Performance-Einbrüchen: Senden Sie sofortige Benachrichtigungen bei Ausfällen oder Performance-Rückgängen, damit Teams schnell reagieren können.

So nutzen Sie Cekura

- Erstellen oder wählen Sie Szenarien, die zu den Workflows Ihres Agenten passen (einschließlich Standardflows und Edge-Cases). Cekura bietet eine integrierte Bibliothek mit Tausenden von Szenarien oder Sie erstellen eigene.

- Führen Sie Vorab-Simulationen durch und nutzen Sie Personas, um die Agentenleistung mit verschiedenen Nutzertypen zu testen (z. B. verwirrte, unterbrechende oder off-script Nutzer).

- Überprüfen Sie Evaluationsergebnisse auf Probleme bei Kernaufgaben (wie Stornierungen, Umbuchungen oder Follow-ups) und nutzen Sie Replays, um bekannte Problemstellen nach Prompt- oder Verhaltensänderungen erneut zu testen.

- Setzen Sie Monitoring in der Produktion ein, um echte Gespräche zu beobachten, Logs zu inspizieren und Alerting für Ausfälle, fehlende Checks oder Performance-Einbrüche zu nutzen.

Anwendungsfälle

- Regressionstests bei Prompt-Änderungen für Terminflows: Wenn ein „neuer Prompt die Termin-Stornierung kaputt macht“, nutzen Sie Simulationen, um zu sehen, wie Änderungen Stornierungen, Umbuchungen und Folgeaufgaben beeinflussen.

- Umgang mit Unterbrechungen und off-script Nutzern: Prüfen Sie, ob der Agent mit ungeduldigem oder unterbrechendem Verhalten umgehen und dennoch die vorgesehene Anleitung befolgen kann.

- Validierung von Compliance-Checks und Hinweisen: Testen Sie Schlüssel-Flows auf fehlende Compliance-Schritte (z. B. ob erforderliche Hinweise oder Checks nicht übersprungen werden).

- Behebung wiederkehrender Gesprächsausfälle: Spielen Sie ein „altes Gespräch, das immer Probleme verursacht“ erneut ab, um den Ausfallgrund zu finden und Fixes nach Updates zu bestätigen.

- Produktions-Monitoring für Instruction-Following und Tool Calls: Überwachen Sie jeden Call, um zu prüfen, ob der Agent Anweisungen korrekt befolgt und erwartete Tool Calls ausführt, und verfolgen Sie Trends über die Zeit.

FAQ

-

Testet Cekura nur Vorab-Produktion oder auch die Produktion? Cekura unterstützt beides: Vorab-Simulationen zur Evaluation und Produktions-Monitoring für laufende Observability.

-

Welche Arten von Evaluations führt Cekura durch? Die Site beschreibt Evaluation von Instruction-Following, Tool Calls und Gesprächsqualität mit Beispielen wie Empathie/Reaktionsfähigkeits-Bewertung und Erfassung übersprungener Compliance-Checks.

-

Kann ich verschiedene Nutzertypen und Gesprächsstile testen? Ja. Cekura umfasst persona-basiertes Testing (z. B. unterschiedliche Akzente und Nutzerdispositionen) und unterstützt eigene Szenarien.

-

Wie hilft Cekura bei Prompt- oder Agentenverhaltensänderungen? Es ermöglicht schnelle Re-Simulation zentraler Nutzerflows und Replay bekannter Problemgespräche, um Auswirkungen von Prompt-Änderungen zu bewerten.

-

Wie werden Probleme dem Team mitgeteilt? Die Plattform bietet sofortige Benachrichtigungen/Alerting bei Fehlern, Ausfällen und Performance-Einbrüchen sowie Logs und Trendanalysen.

Alternativen

- Standalone LLM-/Agent-Test-Frameworks: Tools, die sich auf Testfall-Ausführung und -Bewertung konzentrieren (oft ohne vollständige Conversational Observability). Diese eignen sich besser, wenn Sie die Überwachung bereits anderswo abdecken.

- Conversational Analytics- und Monitoring-Plattformen: Lösungen, die sich auf die Analyse von Produktionsgesprächen konzentrieren (Dashboards, Logs, Trends), aber möglicherweise keinen strukturierten Vorab-Simulations-Workflow mit Personas bieten.

- Customer-Support-QA- und Ticket-Analytics-Tools: Systeme, die Support-Interaktionen nachträglich analysieren; sie helfen bei Überprüfung und Berichterstattung, bieten aber keine End-to-End-Simulation für Instruction-Following und Tool Calls.

- Agent-Workflow-Tests mit Custom-Scripts: Eigenes Test-Harness für Szenario-Durchläufe und Scoring aufbauen. Das ist flexibel, erfordert aber typischerweise mehr Engineering-Aufwand für Persona-Simulation, Replay und Alerting-Workflows.

Alternativen

BenchSpan

BenchSpan führt KI-Agent-Benchmarks parallel aus, erfasst Scores und Fehler in einer geordneten Run-Historie und macht Ergebnisse commit-gebunden reproduzierbar.

PromptScout

PromptScout trackt Markenerwähnungen, empfohlene Wettbewerber und zitierte Quellen in AI-Antworten (ChatGPT, Gemini, Google AI Overviews, Perplexity) inkl. Website-Audits.

Sleek Analytics

Leichtgewertige, datenschutzfreundliche Analytik mit Echtzeit-Visitor-Tracking: Woher Besucher kommen, was sie ansehen und wie lange sie bleiben.

Codex Plugins

Mit Codex Plugins bündelst du Skills, App-Integrationen und MCP-Server zu wiederverwendbaren Workflows und erweiterst Codex für Tools wie Gmail, Google Drive und Slack.

MacSpoof

MacSpoof ist ein MAC-Adressenwechsler für macOS: WLAN-MAC ändern oder randomisieren, um Verbindungen zu erneuern und die Protokollierung auf öffentlichem WLAN zu reduzieren.

ClawTick

ClawTick ist eine CLI-first KI-Agenten-Automationsplattform für cronbasierte Webhook-Tasks mit Monitoring, Alerts, Retries und Ausführungslogs.