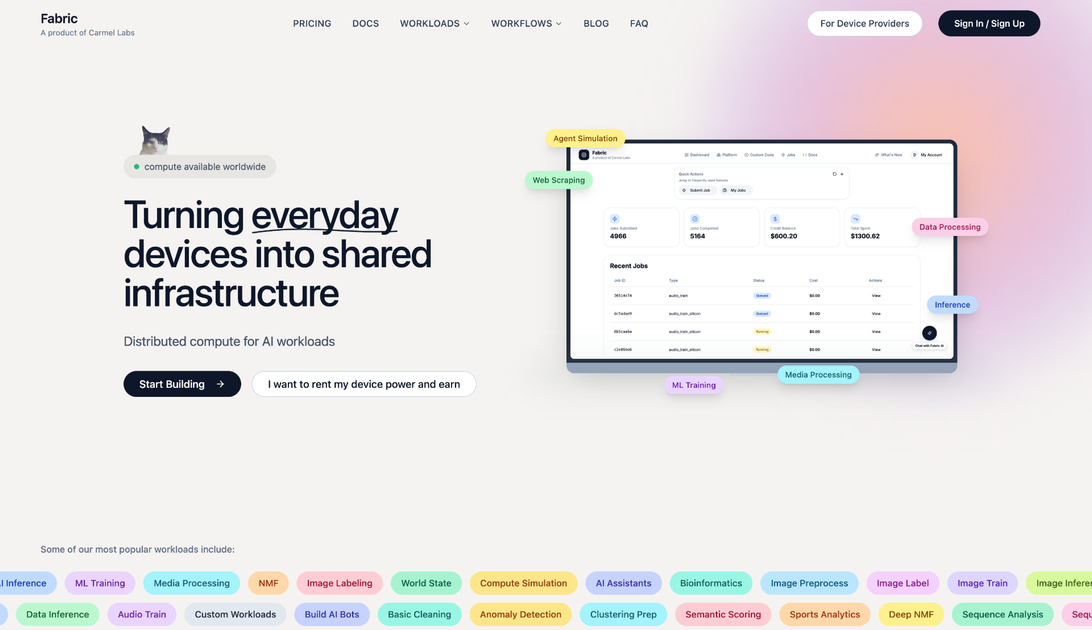

Fabric

Fabric ist ein dezentrales verteiltes Compute-Netzwerk, das ungenutzte Computerressourcen mit anspruchsvollen KI- und Machine-Learning-Workloads verbindet und kosteneffiziente Lösungen für Inferenz und Training bietet.

Was ist Fabric?

Fabric leistet Pionierarbeit für die nächste Generation dezentraler Infrastruktur, indem es ein globales, erlaubnisfreies Netzwerk für verteiltes Computing schafft. Im Kern löst Fabric die eskalierenden Kosten- und Zentralisierungsprobleme moderner KI-Workloads, wie z. B. Inferenz großer Sprachmodelle (LLMs) und komplexes Machine-Learning-Training. Durch die Nutzung ungenutzter GPU- und CPU-Kapazitäten, die über den gesamten Globus verteilt sind – von Rechenzentren bis hin zu einzelnen Hochleistungsmaschinen – bietet Fabric eine skalierbare, widerstandsfähige und wesentlich erschwinglichere Alternative zu herkömmlichen Cloud-Anbietern.

Dieses Netzwerk fungiert als Marktplatz, auf dem Compute-Anbieter (die über ungenutzte Ressourcen verfügen) passives Einkommen erzielen können, indem sie Compute-Anfragen von Workload-Anfragern (Entwicklern, Forschern und Unternehmen) bedienen. Dieses Peer-to-Peer-Modell reduziert den Overhead drastisch und führt zu Inferenzkosten, die nur einen Bruchteil der üblichen Cloud-Preise betragen, wodurch der Zugang zu Hochleistungsrechnen für die Entwicklung modernster KI demokratisiert wird.

Hauptmerkmale

- Dezentrale Compute-Aggregation: Verbindet riesige Pools ungenutzter GPU- und CPU-Leistung weltweit und gewährleistet hohe Verfügbarkeit und geografische Verteilung für Workloads.

- Kosteneffizienz: Bietet dramatisch reduzierte Preise für rechenintensive Aufgaben, insbesondere für Inferenzaufträge mit hohem Volumen, wodurch fortschrittliche KI auch für kleinere Teams und Start-ups zugänglich wird.

- Flexible Workload-Unterstützung: Optimiert für anspruchsvolle KI/ML-Aufgaben, einschließlich Echtzeit-Inferenz, Modell-Serving und verteilter Trainingsaufträge.

- Erlaubnisfreier Zugang: Jeder mit kompatibler Hardware kann als Anbieter beitreten, und jeder, der Rechenleistung benötigt, kann als Anfrager beitreten, was ein wirklich offenes Ökosystem fördert.

- Sicherheit und Verifizierung: Nutzt robuste Mechanismen, um die Integrität und Sicherheit von Daten und Berechnungen über die verteilten Knoten hinweg zu gewährleisten.

- Generierung von passivem Einkommen: Compute-Anbieter können ihre bestehenden ungenutzten Hardware-Assets einfach monetarisieren, indem sie zum Netzwerk beitragen.

Verwendung von Fabric

Der Einstieg in Fabric umfasst unterschiedliche Wege für diejenigen, die Ressourcen anbieten, und diejenigen, die sie nutzen.

Für Compute-Anbieter (Einkommen erzielen):

- Knoten einrichten: Installieren Sie die Fabric-Client-Software auf Ihrer Maschine und stellen Sie sicher, dass Sie über kompatible Hochleistungs-Hardware (insbesondere GPUs) verfügen.

- Onboarding & Staking: Folgen Sie den Anweisungen auf dem Bildschirm, um Ihre Hardware-Kapazität zu registrieren und möglicherweise Token zu staken, um Engagement und Qualität zu signalisieren.

- Workloads akzeptieren: Das System gleicht Ihre verfügbare Kapazität automatisch mit eingehenden Compute-Anfragen ab, basierend auf Hardware-Spezifikationen und geografischer Nähe.

- Verifizierung & Auszahlung: Sobald der Auftrag abgeschlossen und vom Netzwerk verifiziert wurde, erhalten Sie die Zahlung direkt.

Für Workload-Anfrager (Jobs ausführen):

- Anforderungen definieren: Geben Sie Ihren Rechenbedarf an, einschließlich des erforderlichen GPU-Typs (z. B. A100, H100), des Speichers und der Art der Aufgabe (z. B. LLM-Inferenz, Fine-Tuning).

- Job einreichen: Übermitteln Sie Ihr Workload-Paket (z. B. Docker-Container, Modellgewichte) an das Fabric-Netzwerk.

- Automatische Zuordnung: Die Orchestrierungsschicht von Fabric zerlegt den Job intelligent und verteilt ihn auf die am besten geeigneten, kostengünstigsten Knoten.

- Ergebnisse abrufen: Überwachen Sie den Fortschritt des Jobs und rufen Sie nach Abschluss sicher die Endergebnisse oder Modellantworten ab.

Anwendungsfälle

- LLM-Inferenz-Serving mit hohem Volumen: Start-ups und Unternehmen, die KI-Anwendungen für Endverbraucher betreiben (Chatbots, Inhaltserstellung), können ihre Modelle auf Fabric bereitstellen, um massive Anforderungsvolumen zu einem Bruchteil der Kosten zentralisierter Cloud-APIs zu bewältigen, was zu besseren Margen führt.

- KI-Modell-Fine-Tuning und Experimente: Forscher und ML-Ingenieure können schnell Iterationen beim Fine-Tuning großer Basismodelle durchführen, ohne durch hohe Stundensätze für GPU-Mieten eingeschränkt zu sein, was das Tempo der Entdeckungen beschleunigt.

- Edge-AI-Bereitstellung und Datenverarbeitung: Unternehmen, die große Datensätze verarbeiten oder Inferenz näher an der Datenquelle durchführen müssen, können die verteilte Natur von Fabric nutzen, um Rechenressourcen geografisch dort bereitzustellen, wo sie benötigt werden, wodurch die Latenz reduziert wird.

- Dezentrales Rendering und Simulation: Über reine KI hinaus kann Fabric auch andere rechenintensive Aufgaben unterstützen, wie z. B. komplexe wissenschaftliche Simulationen oder 3D-Rendering-Farmen, die Burst-Kapazität benötigen.

- Unabhängige KI-Entwickler: Einzelne Entwickler, die sich die Infrastruktur für das Training oder die Bereitstellung großer Modelle bisher nicht leisten konnten, können nun erschwinglich auf Rechenleistung auf Unternehmensniveau zugreifen.

FAQ

F: Wie stellt Fabric die Sicherheit meiner proprietären Modelle und Daten sicher? A: Fabric setzt fortschrittliche kryptografische Verifizierungstechniken und Containerisierung (wie sichere Docker-Umgebungen) ein, um Workloads zu isolieren. Daten werden sicher innerhalb des Knotens des Anbieters verarbeitet, und Ergebnisse werden vor der Auszahlung verifiziert, wodurch der Schutz des geistigen Eigentums gewährleistet wird.

F: Welche Art von Hardware ist im Fabric-Netzwerk am wertvollsten? A: Derzeit ist Hardware, die mit modernen NVIDIA GPUs ausgestattet ist (insbesondere solche mit hohem VRAM wie A10G, A100, H100), für KI-Workloads am stärksten nachgefragt. Hochkernige CPUs sind jedoch auch für bestimmte vorbereitende Aufgaben und kleinere Inferenzjobs wertvoll.

F: Wie wird die Preisgestaltung für Compute-Jobs bestimmt? A: Die Preisgestaltung ist dynamisch und wird durch Angebot (verfügbare Anbietergebote) und Nachfrage (Anfragerbedürfnisse) bestimmt. Anbieter legen wettbewerbsfähige Preise fest, und das Netzwerk wählt automatisch die effizienteste Kombination von Ressourcen, die die vom Anfrager festgelegten Qualitäts- und Latenzanforderungen erfüllen.

F: Ist Fabric nur für KI gedacht, oder kann ich allgemeine Computeraufgaben ausführen? A: Obwohl Fabric aufgrund der aktuellen Marktnachfrage stark auf KI/ML-Workloads optimiert und vermarktet wird, unterstützt die zugrunde liegende Architektur allgemeine verteilte Computeraufgaben, die containerisiert und über das Netzwerk ausgeführt werden können.

F: Was passiert, wenn ein Compute-Anbieter mitten im Job offline geht? A: Das Netzwerk nutzt Redundanz- und Fehlertoleranzmechanismen. Wenn ein Knoten ausfällt, werden die verbleibenden Teile des Jobs automatisch auf andere verfügbare, verifizierte Knoten im Netzwerk umverteilt, um den Abschluss des Jobs ohne Datenverlust oder erhebliche Verzögerungen zu gewährleisten.

Alternativen

AakarDev AI

AakarDev AI ist eine leistungsstarke Plattform, die die Entwicklung von KI-Anwendungen mit nahtloser Integration von Vektordatenbanken vereinfacht und eine schnelle Bereitstellung und Skalierbarkeit ermöglicht.

Ably Chat

Ably Chat ist eine Chat-API und SDKs für maßgeschneiderte Realtime-Chat-Apps: Reactions, Presence sowie Nachrichten editieren/löschen.

Paperpal

Paperpal ist ein KI-Tool für wissenschaftliches Schreiben: smarter Literaturzugriff, englische Lektorierung & wissenschaftliches Umschreiben, plus Pre-Check und Ähnlichkeitsanalyse.

VForms

VForms ermöglicht die Erstellung interaktiver Fragebögen, die direkt über YouTube-Videos gelegt werden, sodass Benutzer hochkontextbezogenes Feedback und tiefe Einblicke in die Nutzer erhalten.

BookAI.chat

BookAI ermöglicht es Ihnen, mit Ihren Büchern zu chatten, indem Sie einfach den Titel und den Autor angeben.

DeepMotion

DeepMotion ist eine AI-Motion-Capture- und Body-Tracking-Plattform für 3D-Animationen aus Video (und Text) im Browser – per Animate 3D API integrierbar.