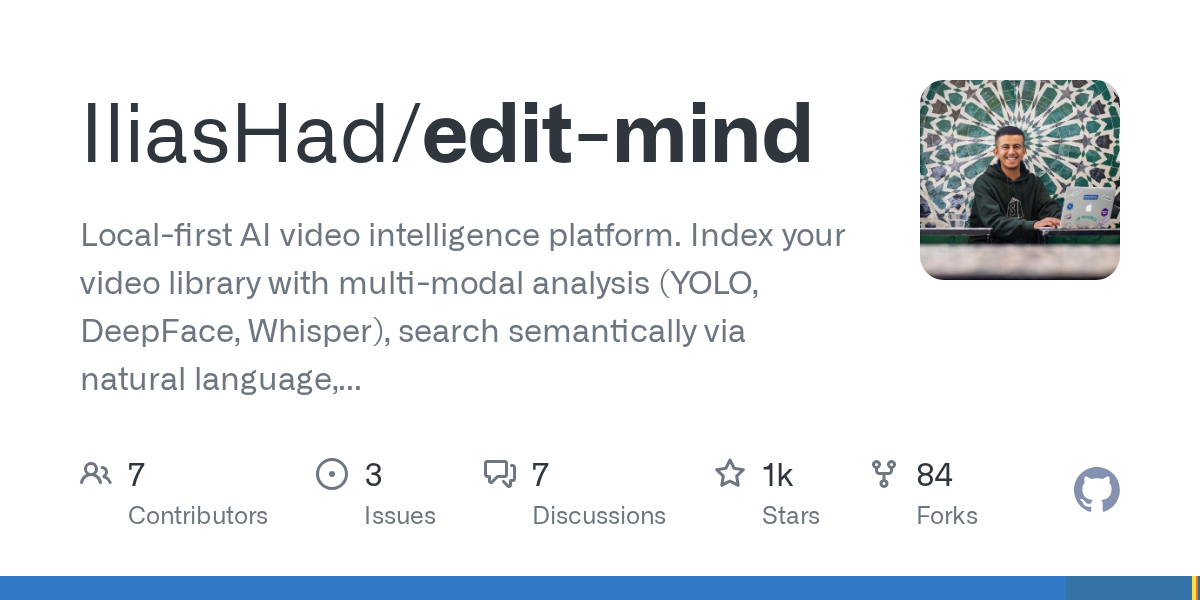

edit-mind

edit-mind es una plataforma de inteligencia de video con IA local que indexa transcripción, caras/objetos/texto y permite buscar por contenido en lenguaje natural.

¿Qué es Edit Mind?

Edit Mind es una plataforma de inteligencia de video con IA local que indexa una biblioteca de videos y permite buscar contenido de video usando lenguaje natural. Procesa videos para extraer metadatos como transcripción, objetos detectados y caras, y luego almacena esa información para consultas semánticas.

El propósito principal es convertir un conjunto existente de videos en conocimiento searchable —cubriendo videos completos y, donde aplique, escenas específicas— mientras se ejecuta vía Docker para que funcione en cualquier computadora o servidor con Docker instalado.

Características clave

- Servicio de indexación de video en segundo plano: Vigila nuevos archivos de video y los encola para análisis impulsado por IA, manteniendo tu biblioteca actualizada.

- Análisis de video multi-modelo: Extrae metadatos incluyendo reconocimiento facial, transcripción, detección de objetos y texto, y análisis a nivel de escena.

- Búsqueda semántica basada en vectores (ChromaDB): Soporta búsqueda en lenguaje natural sobre contenido de video usando embeddings almacenados en ChromaDB.

- Ejecución local con Docker: Se ejecuta como servicios contenedorizados usando Docker Compose para mantener la configuración modular y desplegable en diferentes máquinas.

- Opciones de modelos para procesamiento de IA/NLP: Usa Whisper para transcripción y soporta elegir entre Google Gemini o localmente vía Ollama (por configuración).

Cómo usar Edit Mind

- Instala y ejecuta Docker Desktop (o asegúrate de que Docker esté disponible en tu servidor).

- Clona el repositorio y ejecuta el flujo de configuración proporcionado.

- Expón tu carpeta de medios a Docker configurando el intercambio de archivos de Docker Desktop (macOS/Windows). En Linux, el intercambio de archivos suele estar habilitado por defecto.

- Crea archivos de entorno: Descarga/copia

.env.exampley.env.system.exampleen.envy.env.system, luego configura los ajustes requeridos. - Establece la ruta de la carpeta de video (

HOST_MEDIA_PATH) y elige tu opción de modelo de IA:- Ollama: establece

USE_OLLAMA_MODEL, másOLLAMA_HOST,OLLAMA_PORTyOLLAMA_MODEL(y ejecutaollama serve/ descarga el modelo primero). - Gemini: establece

USE_GEMINIy proporcionaGEMINI_API_KEY.

- Ollama: establece

- Genera claves de seguridad: Establece

ENCRYPTION_KEYySESSION_SECRETusando los comandos mostrados en la guía de configuración. - Inicia el stack de Docker Compose (el repositorio proporciona tanto un archivo compose estándar como uno orientado a CUDA para GPUs NVIDIA).

Casos de uso

- Buscar por palabras habladas: Consulta tu biblioteca con frases que recuerdes del audio, basándote en la transcripción extraída de los videos.

- Encontrar videos con objetos específicos o texto en pantalla: Usa consultas en lenguaje natural vinculadas a salidas de detección de objetos y texto generadas durante la indexación.

- Localizar escenas con caras conocidas: Usa metadatos derivados del reconocimiento facial para reducir resultados a videos o escenas donde aparecen personas.

- Curar y navegar archivos personales grandes: Mantiene los metadatos actualizados automáticamente al agregar nuevos archivos de video, luego busca sin etiquetado manual.

- Ejecutar en un entorno local centrado en privacidad: Indexa y busca completamente en tu propia máquina (o servidor) a través de Docker en lugar de requerir un flujo alojado.

Preguntas frecuentes

-

¿Está Edit Mind listo para producción? El repositorio indica que está en desarrollo activo y no está listo para producción, con expectativas de funciones incompletas y errores ocasionales.

-

¿Requiere Edit Mind Docker? Sí. Las instrucciones de configuración especifican Docker Compose para ejecutar todo en contenedores.

-

¿Qué opciones de IA están soportadas para procesamiento? La documentación menciona Whisper para transcripción y soporta Google Gemini u Ollama para tareas relacionadas con NLP, seleccionadas vía variables de entorno.

-

¿Cómo conecto el sistema a mis archivos de video? Configura Docker para acceder a tu carpeta de medios (intercambio de archivos de Docker Desktop en macOS/Windows) y establece

HOST_MEDIA_PATHen el archivo.envpara que coincida con esa ruta de carpeta. -

¿Dónde reside los datos de búsqueda semántica? El stack incluye ChromaDB para búsqueda semántica basada en vectores y PostgreSQL (vía Prisma ORM) como base de datos relacional.

Alternativas

- Plataformas de búsqueda de video alojadas en la nube: Estas suelen centralizar el procesamiento en infraestructura alojada. Comparadas con el enfoque local-first de Docker de Edit Mind, pueden intercambiar privacidad/control por una configuración más simple.

- Herramientas de gestión de medios de escritorio con etiquetado manual: Algunas herramientas permiten organizar videos mediante etiquetas y metadatos introducidos por el usuario. Difieren en que no realizan transcripción basada en IA, extracción de objetos/caras para búsqueda semántica.

- Pipelines de transcripción + búsqueda autoalojados: Puedes construir un flujo de trabajo que transcriba video e indexe texto para búsqueda. Esto diferiría de Edit Mind al centrarse más estrechamente en audio/texto en lugar de análisis multimodal (caras/objetos/escenas) y consulta semántica integrada.

- Aplicaciones generales de búsqueda en bases de datos vectoriales: Podrías usar embeddings y una base de datos vectorial para implementar búsqueda semántica, pero tendrías que manejar tú mismo la ingesta de video, extracción multimodal y vinculación a nivel de escena—trabajo que Edit Mind empaqueta en su pipeline.

Alternativas

Wikiwand

Agregador de wikis impulsado por IA creado para mejorar la experiencia del usuario en Wikipedia al simplificar el consumo de conocimiento.

Lasso

Lasso es un PIM con IA para equipos de ecommerce: enriquece atributos y descripciones, procesa datos de proveedores y monitoriza competidores por app o API.

Struere

Struere es un sistema operativo nativo de IA que reemplaza los flujos en hojas de cálculo por software estructurado: paneles, alertas y automatizaciones.

garden-md

Convierte transcripciones de reuniones en un wiki de empresa estructurado y enlazado con archivos Markdown locales y vista HTML; sincroniza desde fuentes compatibles.

Falconer

Falconer es una plataforma de conocimiento autoactualizable para equipos ágiles: escribe, comparte y encuentra documentación interna y contexto de código en un solo lugar.

ClayHog

ClayHog es una plataforma de AI Search Visibility y GEO que muestra qué dicen sobre tu marca ChatGPT, Gemini, Perplexity, Claude y Google AI Overviews.