Lamatic.ai

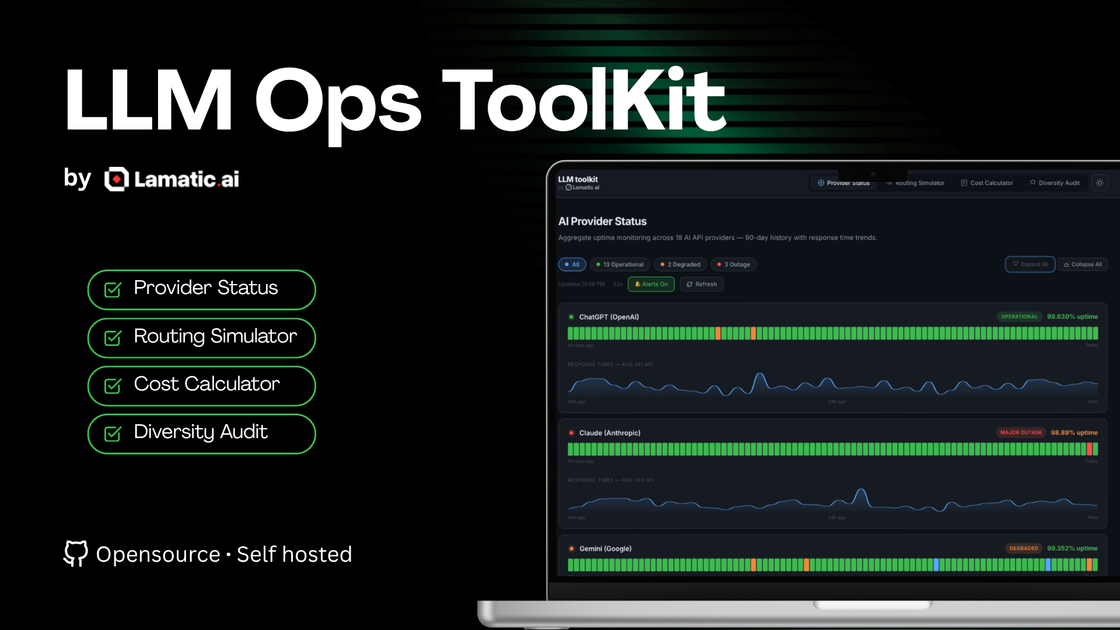

El LLM Ops Toolkit de Lamatic.ai ofrece monitorización de uptime en 18 proveedores, calculadora de costes con TCO, simulador de routing y auditoría.

¿Qué es Lamatic.ai?

El LLM Ops Toolkit de Lamatic.ai ayuda a los equipos a evaluar y operar múltiples proveedores de LLM con visibilidad de planificación y operativa. Combina herramientas para estimación de costes, simulación de enrutamiento de modelos, monitorización de uptime de proveedores y evaluación de madurez operativa.

El propósito principal es apoyar la toma de decisiones sobre qué modelos usar, cómo enrutar solicitudes entre proveedores y cómo cuantificar los “costes ocultos” operativos (como el tiempo dedicado a operaciones de modelos) junto con la fiabilidad observada de los proveedores.

Características clave

- Calculadora de costes de LLM y análisis de coste real: Estima costes mensuales y anuales usando entradas como número de proveedores, gasto mensual en API, tamaño del equipo de ingeniería, tiempo asignado a operaciones de modelos y un multiplicador de TCO para calcular un coste mensual “real” y costes ocultos.

- Simulador de routing con comparación de estrategias: Simula el enrutamiento de solicitudes entre diferentes modelos usando parámetros como volumen de solicitudes, complejidad de solicitudes y una estrategia de routing (incluyendo conceptos de optimización de costes y priorización de calidad) para estimar ahorros de costes y resultados de calidad/latencia.

- Auditoría de diversidad de modelos y madurez: Evalúa la madurez de LLM ops mediante un conjunto de preguntas dirigidas (mostradas como evaluación de madurez con recomendaciones) para guiar los siguientes pasos.

- Radar de capacidades (vista de comparación de modelos): Muestra una comparación en estilo radar de capacidades para múltiples modelos listados, incluyendo coste por 1K tokens, puntuación de calidad y latencia.

- Monitorización agregada de uptime en proveedores de API de IA: Rastrea el estado de proveedores con historial de 90 días y tendencias de tiempo de respuesta, incluyendo estados operativos como operativo, degradado y caída; incluye controles de notificación de caídas (indicados por un icono de alerta).

Cómo usar Lamatic.ai

- Comienza con tus suposiciones base en la calculadora de costes: establece el número de proveedores de LLM, gasto mensual en API, tamaño del equipo de ingeniería y el porcentaje de tiempo de ingeniería dedicado a operaciones de modelos para generar una estimación de “coste real” y costes ocultos.

- Ejecuta una simulación de routing: elige un volumen y complejidad de solicitudes y compara resultados de estrategias de routing (por ejemplo, routing que prioriza costes versus routing que prioriza calidad) para cuantificar ahorros potenciales y cambios esperados en calidad/latencia.

- Evalúa la fiabilidad de proveedores usando la vista de monitorización de uptime para revisar los últimos 90 días de uptime y tendencias de tiempo de respuesta en el conjunto de proveedores soportados.

- Completa la auditoría de madurez respondiendo las preguntas dirigidas para identificar pasos recomendados y dónde encaja tu proceso actual de operaciones de LLM en el espectro de madurez.

Casos de uso

- Planificación de presupuestos multi-proveedor de LLM: Un equipo puede usar la calculadora de costes para convertir la facturación bruta de API en una vista de “coste mensual real” más amplia que incluye tiempo de ingeniería y un multiplicador estimado de TCO, ayudando a justificar inversiones operativas.

- Evaluación de si el routing puede reducir gastos: Al simular una estrategia de routing donde una porción del tráfico va a modelos más baratos, un equipo de ingeniería puede estimar ahorros anuales potenciales y comparar asignaciones de routing conservadoras versus optimistas.

- Comparación de modelos bajo suposiciones de carga: Los equipos pueden usar el radar de capacidades y el simulador de routing juntos para comparar modelos listados por coste por token y latencia, y validar cómo el routing impacta la calidad y latencia media bajo un perfil de solicitudes dado.

- Revisión de riesgos operativos para rendimiento de proveedores: Usando la monitorización agregada de uptime con historial de 90 días, los equipos pueden revisar tendencias de tiempo de respuesta y caídas/degradaciones para informar la estrategia de proveedores o planificación de incidentes.

- Análisis de brechas para madurez de LLM Ops: Organizaciones nuevas en LLMOps o con herramientas existentes pueden usar la auditoría de madurez para estructurar mejoras mediante la evaluación de capacidades guiada por cuestionario.

Preguntas frecuentes

-

¿Qué métricas calcula el toolkit para el coste? La página describe un análisis de coste real que combina el gasto mensual en API con el tiempo de ingeniería en operaciones de modelos y un multiplicador TCO, produciendo un “coste mensual real” y cifras de costes ocultos.

-

¿Puedo simular routing entre múltiples modelos? Sí. El simulador de routing está diseñado para visualizar cómo el routing distribuye las solicitudes entre modelos y estimar ahorros de coste y resultados de routing.

-

¿Qué proveedores cubre la monitorización de uptime? La sección de monitorización de uptime indica que cubre 18 proveedores de API de IA y proporciona un historial de 90 días con tendencias de tiempo de respuesta.

-

¿Qué mide la auditoría de madurez? La auditoría de madurez se presenta como una evaluación con 10 preguntas específicas y genera recomendaciones ad hoc y una vista estilo radar de capacidades.

Alternativas

- Herramientas de contabilidad de costes y tokens de LLM (dashboards de costes): Se centran en el uso de API y seguimiento de costes por token, pero normalmente no incluyen la misma combinación de modelado TCO real, simulación de routing, historial de uptime de proveedores y auditoría de madurez.

- Plataformas generales de monitorización de uptime/latencia de API: Las herramientas de monitorización pueden rastrear uptime y tiempos de respuesta para endpoints, pero pueden requerir más configuración para modelar decisiones de routing de LLM y compensaciones coste/calidad entre múltiples proveedores de modelos.

- Lógica de routing personalizada con analítica interna: Los equipos pueden construir routing y evaluación internamente usando su telemetría; esto puede replicar partes del simulador pero suele requerir más esfuerzo de ingeniería para construir comparaciones de coste/calidad/latencia y vistas de estado histórico de proveedores.

Alternativas

ClawTick

ClawTick es una plataforma de automatización de agentes con IA por CLI para programar tareas con webhooks en cron: monitoreo, alertas, reintentos y logs.

OpenFlags

OpenFlags es un sistema de feature flags open source y autohospedado con control plane y SDKs para evaluaciones locales y rollouts progresivos.

skills-janitor

skills-janitor audita y registra el uso de tus habilidades de Claude Code, comparándolas con 9 acciones de slash y sin dependencias.

BenchSpan

BenchSpan ejecuta benchmarks de agentes con IA en paralelo, registra puntuaciones y fallos en un historial organizado y ayuda a reproducir resultados por commit.

Rectify

Rectify es una plataforma de operaciones todo en uno para SaaS: supervisión, analíticas, soporte, roadmaps, changelogs y gestión de agentes en un espacio visual.

PromptScout

PromptScout monitoriza cómo se menciona tu marca y qué competidores y fuentes se citan en respuestas de IA en ChatGPT, Gemini, Google AI Overviews y Perplexity.