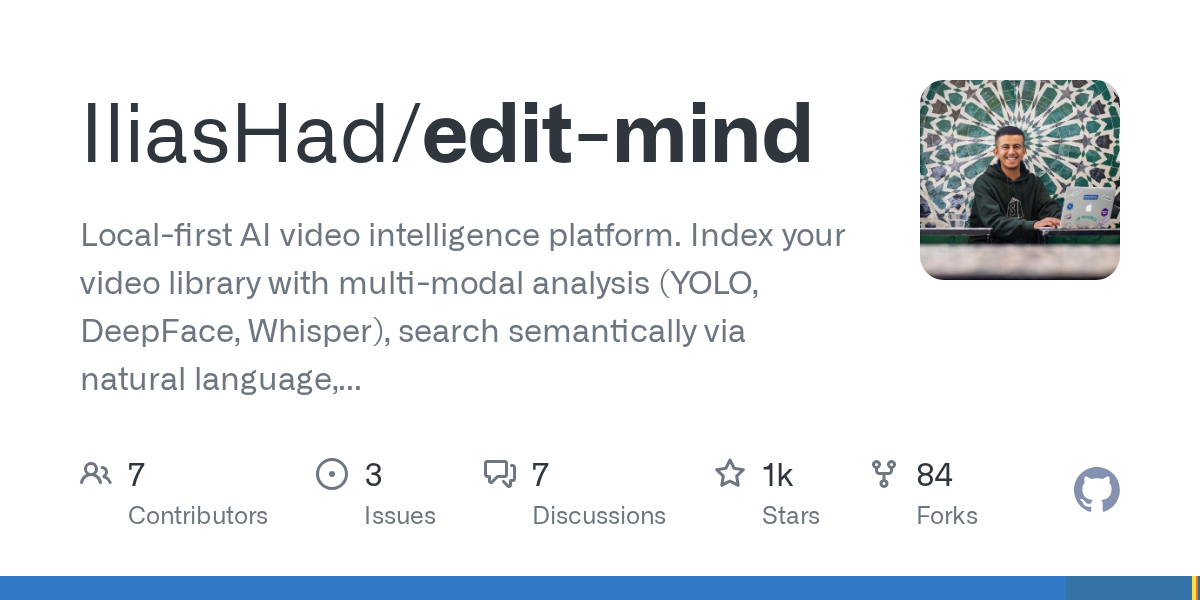

edit-mind

Edit Mind é uma plataforma local-first de inteligência de vídeo com transcrição, análise de faces/objetos/texto e embeddings para busca por linguagem natural.

O que é Edit Mind?

Edit Mind é uma plataforma local-first de inteligência de vídeo que indexa uma biblioteca de vídeos e permite buscar conteúdo de vídeo usando linguagem natural. Ela processa vídeos para extrair metadados como transcrição, objetos detectados e faces, armazenando essas informações para consultas semânticas.

O propósito principal é transformar um conjunto existente de vídeos em conhecimento pesquisável — cobrindo vídeos inteiros e, quando aplicável, cenas específicas — rodando via Docker para funcionar em qualquer computador ou servidor com Docker instalado.

Principais Recursos

- Serviço de indexação de vídeo em segundo plano: Monitora novos arquivos de vídeo e os coloca em fila para análise com IA, mantendo sua biblioteca atualizada.

- Análise de vídeo multi-modelo: Extrai metadados incluindo reconhecimento facial, transcrição, detecção de objetos & texto e análise em nível de cena.

- Busca semântica baseada em vetores (ChromaDB): Suporta busca por linguagem natural sobre conteúdo de vídeo usando embeddings armazenados no ChromaDB.

- Execução local com Docker: Executa como serviços containerizados usando Docker Compose para manter a configuração modular e implantável em diferentes máquinas.

- Opções de modelo para processamento AI/NLP: Usa Whisper para transcrição e suporta escolha entre Google Gemini ou localmente via Ollama (por configuração).

Como Usar Edit Mind

- Instale e execute o Docker Desktop (ou garanta que o Docker esteja disponível no seu servidor).

- Clone o repositório e execute pelo fluxo de configuração fornecido.

- Exponha sua pasta de mídia ao Docker configurando o compartilhamento de arquivos do Docker Desktop (macOS/Windows). No Linux, o compartilhamento de arquivos geralmente está ativado por padrão.

- Crie arquivos de ambiente: Baixe/copie

.env.examplee.env.system.examplepara.enve.env.system, depois configure as definições necessárias. - Defina o caminho da pasta de vídeo (

HOST_MEDIA_PATH) e escolha sua opção de modelo de IA:- Ollama: defina

USE_OLLAMA_MODEL, maisOLLAMA_HOST,OLLAMA_PORTeOLLAMA_MODEL(e executeollama serve/ baixe o modelo primeiro). - Gemini: defina

USE_GEMINIe forneçaGEMINI_API_KEY.

- Ollama: defina

- Gere chaves de segurança: Defina

ENCRYPTION_KEYeSESSION_SECRETusando os comandos mostrados no guia de configuração. - Inicie o stack Docker Compose (o repositório fornece tanto um arquivo compose padrão quanto um otimizado para CUDA em GPUs NVIDIA).

Casos de Uso

- Busca por palavras faladas: Consulte sua biblioteca com frases que você lembra do áudio, contando com a transcrição extraída dos vídeos.

- Encontre vídeos com objetos específicos ou texto na tela: Use consultas em linguagem natural ligadas às saídas de detecção de objetos & texto geradas durante a indexação.

- Localize cenas com faces conhecidas: Use metadados derivados de reconhecimento facial para refinar resultados em vídeos ou cenas onde pessoas aparecem.

- Curate e navegue por grandes arquivos pessoais: Mantenha metadados atualizados automaticamente à medida que novos arquivos de vídeo são adicionados, depois busque sem marcação manual.

- Execute em ambiente local focado em privacidade: Indexe e busque inteiramente na sua própria máquina (ou servidor) via Docker, em vez de exigir um fluxo hospedado.

FAQ

-

Edit Mind está pronto para produção? O repositório afirma que está em desenvolvimento ativo e ainda não está pronto para produção, com expectativa de recursos incompletos e bugs ocasionais.

-

Edit Mind requer Docker? Sim. As instruções de configuração especificam Docker Compose para executar tudo em contêineres.

-

Quais opções de IA são suportadas para processamento? A documentação menciona Whisper para transcrição e suporta Google Gemini ou Ollama para tarefas relacionadas a NLP, selecionadas via variáveis de ambiente.

-

Como conecto o sistema aos meus arquivos de vídeo? Configure o Docker para acessar sua pasta de mídia (compartilhamento de arquivos do Docker Desktop em macOS/Windows) e defina

HOST_MEDIA_PATHno arquivo.envpara corresponder ao caminho da pasta. -

Onde ficam os dados de busca semântica? O stack inclui ChromaDB para busca semântica baseada em vetores e PostgreSQL (via Prisma ORM) como banco de dados relacional.

Alternativas

- Plataformas de busca de vídeo hospedadas na nuvem: Elas geralmente centralizam o processamento em infraestrutura hospedada. Comparadas à abordagem local-first com Docker do Edit Mind, podem trocar privacidade/controle por configuração mais simples.

- Ferramentas de gerenciamento de mídia desktop com marcação manual: Algumas ferramentas permitem organizar vídeos via tags e metadados inseridos pelo usuário. Elas diferem por não realizarem transcrição baseada em IA/extratação de objetos/faces para busca semântica.

- Pipelines de transcrição + busca auto-hospedadas: Você pode criar um fluxo de trabalho que transcreve vídeo e indexa texto para busca. Isso difere do Edit Mind por focar mais estreitamente em áudio/texto em vez de análise multi-modal (faces/objetos/cenas) e consulta semântica integrada.

- Aplicativos gerais de busca em banco de dados vetorial: Você poderia usar embeddings e um banco de dados vetorial para implementar busca semântica, mas precisaria lidar com ingestão de vídeo, extração multi-modal e vinculação em nível de cena sozinho — trabalho que o Edit Mind empacota em seu pipeline.

Alternativas

Wikiwand

Agregador de wikis impulsionado por IA criado para melhorar a experiência do usuário na Wikipedia ao simplificar o consumo de conhecimento.

Lasso

Lasso é um PIM com IA para equipes de e-commerce: enriquece atributos e descrições, processa dados de fornecedores e monitora concorrentes via app ou API.

Struere

Struere é um sistema operacional nativo de IA que substitui planilhas por software estruturado com dashboards, alertas e automações.

garden-md

Transforme transcrições de reuniões em uma wiki de empresa estruturada e vinculada, com arquivos Markdown locais e visualização em HTML, com sincronização.

Falconer

Falconer é uma plataforma de conhecimento que se atualiza sozinha, reunindo documentação interna e contexto de código para equipes rápidas encontrarem e compartilharem.

ClayHog

ClayHog é uma plataforma de AI Search Visibility e GEO que mostra o que ChatGPT, Gemini, Perplexity, Claude e Google AI Overviews dizem sobre sua marca.