Plask

Plask — AI motion capture и 3D-анимация: загрузите видео, извлеките движения и примените их к 3D-моделям, экспортируйте рендер или 3D-активы.

Что такое Plask?

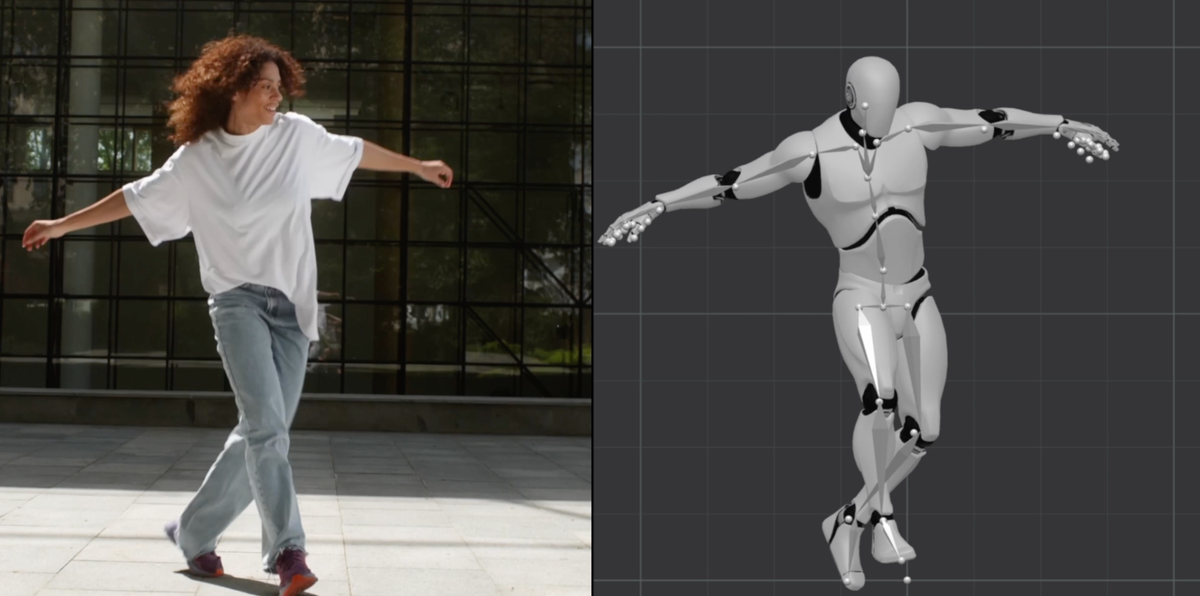

Plask — инструмент на базе ИИ для захвата движений и 3D-анимации, который преобразует видео пользователя в 3D-анимацию с использованием данных о движениях, извлечённых ИИ. Основная цель — позволить создателям применять захваченные движения к 3D-персонажам и создавать отрендеренные видео или экспортировать 3D-активы.

Рабочий процесс строится вокруг загрузки видео, извлечения данных о движениях, применения этих движений к импортированной 3D-модели, затем настройки элементов направления видео, таких как освещение и управление камерой, перед экспортом результатов для анимации или дальнейших 3D-инструментов.

Ключевые возможности

- AI-захват движений из загруженного видео: Загружайте видеоматериалы (включая съёмки со смартфона и онлайн-видео), и ИИ извлечёт данные о движениях для использования в 3D-анимации.

- Анимация персонажей с использованием извлечённых движений: Импортируйте 3D-модель персонажа и применяйте извлечённые движения; поддержка моргания и физики указана для моделей MMD и VRM.

- Управление направлением видео: Используйте интерфейс с несколькими кликами для контроля освещения и камеры, включая кинематографические эффекты, такие как motion blur и depth-of-field.

- Экспорт рендеров или 3D-активов: Генерируйте высококачественные видеорендеры или экспортируйте 3D-активы, совместимые с популярными DCC и пайплайнами реального времени.

- Постобработка для отрендеренного вывода: Добавляйте эффекты, указанные в тексте страницы, включая vignettes, motion blur, auto-focus depth-of-field и advanced tone mapping.

- Интеграция workflow с 3D-программами: Экспорт в инструменты, упомянутые на странице, включая Unreal, Maya, Blender и Unity.

- Бесплатный старт: На странице есть призыв «Get started— it’s free» для онбординга.

Как использовать Plask

- Создайте проект и загрузите видеоклип, который хотите анимировать.

- Запустите AI-захват движений, чтобы система извлекла данные о движениях из вашего материала.

- Импортируйте вашего 3D-персонажа (с поддержкой MMD/VRM) и примените извлечённые движения.

- Настройте освещение и направление камеры, чтобы задать вид сцены, включая эффекты вроде motion blur и depth-of-field.

- Экспортируйте результаты — как отрендеренное видео или 3D-активы для использования в другом ПО.

Сценарии использования

- Превращайте съёмки со смартфона в 3D-анимацию: Загружайте любительскую запись и генерируйте 3D-анимацию на основе движений из видео.

- Анимируйте персонажей MMD/VRM извлечёнными движениями: Применяйте захваченные движения к моделям MMD или VRM с поддержкой моргания и физики (как указано на странице).

- Создавайте клипы в кинематографическом стиле: Используйте указанные контролы освещения/камеры и опции постобработки (например, motion blur и depth-of-field) для стилизованного рендера.

- Отправляйте анимацию в производственный пайплайн: Экспортируйте в инструменты вроде Unreal, Unity, Maya или Blender для продолжения работы в существующем 3D-workflow.

- Заказывайте быстрые кастомные анимации: Если не хотите генерировать анимацию сами, страница описывает создание кастомных видео в стиле TikTok и вирусных танцевальных анимаций для вас в течение 24 часов после описания танцевального видео.

FAQ

Сколько стоит использование Plask?

На странице есть вопрос FAQ «How much does it cost to use Plask?», но в предоставленном тексте нет деталей о ценах.

Могу ли я использовать анимации Plask в коммерческих целях?

На странице есть вопрос FAQ «Can I use my Plask animations for commercial use?», но в предоставленном контенте нет ответа.

Могу ли я загрузить свою 3D-модель?

В FAQ есть пункт о возможности загрузки собственной 3D-модели; в контенте страницы ответ не включён.

Поддерживает ли Plask трекинг пальцев?

В списке FAQ есть вопрос о трекинге пальцев, но деталей в предоставленном контенте нет.

В чём разница между MoCap V1 и V2?

На странице есть пункт FAQ о разнице между MoCap V1 и V2, но фактическое различие в предоставленном тексте не указано.

Альтернативы

- Ручная 3D-анимация (keyframing в Blender/Maya/других DCC-инструментах): Вместо извлечения движения из видео с помощью ИИ вы анимируете вручную. Это даёт больше контроля, но обычно занимает больше времени для сцен с интенсивным движением.

- Специализированные motion-capture workflows: Инструменты или пайплайны, полагающиеся на традиционные motion capture (например, специализированные системы захвата), подходят, когда нужен аппаратный трекинг вместо AI-извлечения из видео.

- Реал-тайм анимация аватаров из видео: Альтернативы в категории ИИ-анимации аватаров также могут преобразовывать видео в движения персонажа, с разными уровнями контроля и вариантами экспорта в зависимости от платформы.

- Универсальные ИИ-инструменты редактирования видео в видео: Если цель — в основном визуальное преобразование, а не полноценная 3D-анимация персонажа с экспортом в 3D-программы, другие подходы к видеоредактированию могут подойти лучше, хотя они не обеспечивают такой же workflow с 3D-активами, как в Plask.

Альтернативы

MIRA vision

MIRA vision — ИИ-система для медицинской диагностики: выполняет запатентованные синтетические патологоанатомические анализы с точностью и быстрыми результатами.

Dancing Cats App

Dancing Cats App превращает фото котиков в короткие танцующие видео-клипы из ваших изображений — создавайте анимацию для быстрого шаринга.

VIDEOAI.ME

VIDEOAI.ME — ИИ-генератор видео: создавайте профессиональные ролики с реалистичными AI-актёрами и озвучкой из текста или одного селфи для TikTok/Instagram.

HeyGen

HeyGen Developers — API-платформа для генерации, перевода и lipsync видео с аватарами и TTS-моделями для масштабируемых продакшн-процессов.

DeepMotion

DeepMotion — платформа ИИ для motion capture и body-tracking: создавайте 3D-анимации из видео (и текста) в браузере; интеграция через Animate 3D API.

艺映AI

艺映AI — это бесплатная платформа для генерации видео на основе ИИ, сосредоточенная на преобразовании текста и изображений в динамические видео высокого качества.