CanopyAI 是什么?

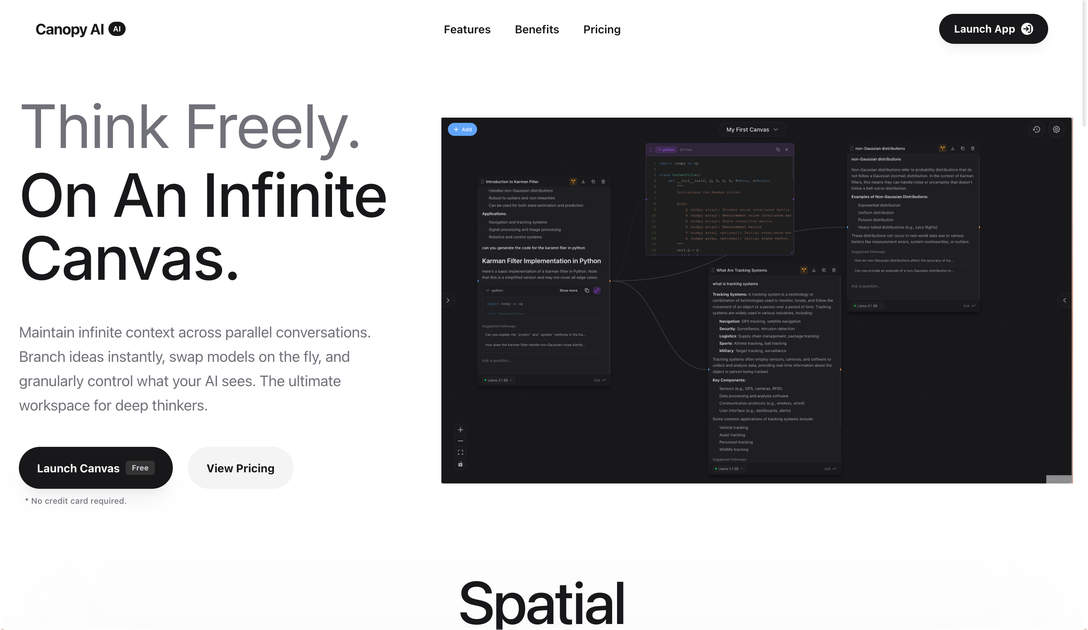

CanopyAI 是一个围绕“无限画布”设计的 AI 对话工作区,支持在多个并行线程中思考和写作。它不会将思路困在单一线性对话中,而是允许您分支对话、在节点间保持上下文,并随着思路演变重组探索路径。

核心目的是帮助您同时处理多个持续提示,同时保持清晰的推理脉络。网站还介绍了每个节点 AI 可见内容的控制,以及会话中切换模型的能力。

主要功能

- 无限画布与并行对话:在分支“节点”间保持上下文,而不是将每个对话视为孤立。

- 从任意点即时分支:分叉对话以探索新思路,同时保留原始上下文。

- 实时切换多种模型:更改分支使用的推理模型,在同一画布上下文中比较输出。

- 精细生成与可见性控制:控制 AI 可见内容,并调整每个节点的生成参数(例如温度和令牌限制)。

- “可搜索的永久记忆”:保存、标注并稍后返回之前的输出和笔记。

- 流式响应:逐步接收输出,而非等待完整响应。

- 适用于重型工作流的画布:单一控制中心管理多个持续对话,而非众多浏览器标签页。

如何使用 CanopyAI

- 开始新画布/会话,输入初始提示。

- 当想探索备选方向时,从当前消息分叉/分支对话。

- 对于每个分支,根据需要切换模型,并调整节点级生成参数(例如温度或最大令牌数),以匹配所需推理类型。

- 保存并标注结果,以便稍后返回早期分支,包括使用画布的可搜索记忆。

- 通过再次分支继续优化,同时保持原始上下文完整,探索分支路径。

使用场景

- 研究式探索:在关键决策点分叉对话,调查竞争假设,同时在分支间保持共享上下文。

- 同问题模型比较:在同一画布中使用多种模型,比较不同推理引擎处理问题的差异,同时保留上游上下文。

- 控制范围的长篇分析:调整 AI 可见内容并调优每个分支的生成参数,确保相关子问题输出一致。

- 多线程活跃项目:在单一组织化画布中管理项目讨论(例如多个草稿、变体或后续问题)。

- 工作流审查与检索:保存并标注重要输出,然后搜索并重访早期分支。

常见问题

-

CanopyAI 支持分支对话吗?

是的。网站强调“无限分支”和即时分叉对话的能力,同时保持原始上下文。

-

会话中可以切换 AI 模型吗?

是的。CanopyAI 支持实时切换模型,并在分支间比较输出。

-

可以控制 AI 生成响应方式吗?

页面提到每个节点的精细控制,包括生成参数如温度和最大令牌设置。

-

可以使用自己的 AI 提供商凭证吗?

网站声明:“Bring Your Own API Key” 和 “Use your preferred providers with no usage limits。”

-

有办法保存并查找以往工作吗?

页面提到“searchable, permanent memory”,可保存、标注作品并稍后返回。

替代方案

- 笔记本式 AI 助手(多笔记工作区): 如果您偏好文档导向组织更合适,但可能无法获得相同的节点分支与上下文保留。

- 无分支上下文的聊天多线程工具: 可处理多个聊天,但通常将线程视为独立,难以在变体间维护共享上下文。

- 通用 IDE 或开发者工作区集成 LLM: 适用于代码中心工作流,但复制“无限画布”分支体验可能需更多设置。

- 带 AI 功能的项目管理工具: 适合跟踪任务和草稿,但通常不提供 CanopyAI 描述的每个节点模型切换和生成控制。

替代品

Falconer

Falconer 是自更新知识平台,帮高速度团队在一个地方编写、分享并搜索可靠内部文档与代码上下文。

BookAI.chat

BookAI允许您通过简单提供书名和作者与您的书籍进行AI聊天。

skills-janitor

skills-janitor 插件用于审计和跟踪 Claude Code 技能使用情况,并与九个聚焦的斜杠命令进行对比,零依赖。

Lasso

Lasso 是面向电商团队的 AI 优先 PIM,可丰富商品属性与描述、处理供应商数据,并通过应用或 API 支持竞品监控。

Struere

Struere 是 AI 原生运营系统,用结构化软件替代表格流程,支持仪表盘、告警与自动化,集中管理运营数据与流程。

garden-md

garden-md 将会议转录内容整理成结构化、可互链的企业维基:基于本地 Markdown,并可用 HTML 浏览视图同步转录来源。