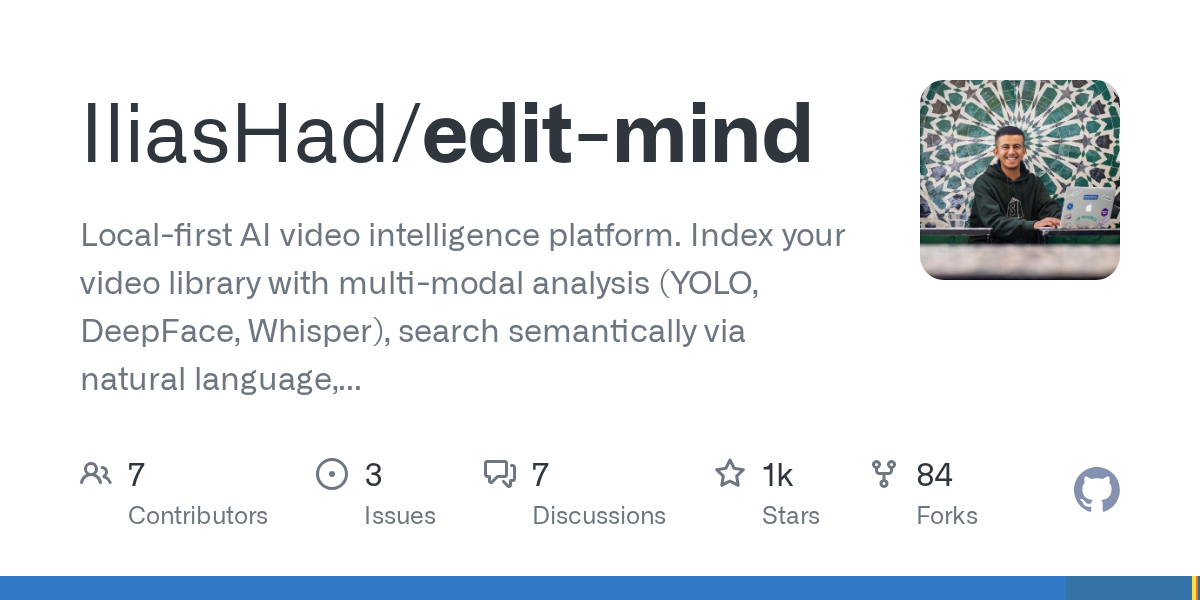

edit-mind

Edit Mind: Local-first KI-Video-Intelligenz. Indiziert Videos mit Transkription, Gesichts-/Objekt-/Texterkennung und bietet semantische Suche per natürlicher Sprache.

Was ist Edit Mind?

Edit Mind ist eine local-first KI-Video-Intelligenz-Plattform, die eine Videobibliothek indiziert und dir ermöglicht, Videoinhalte per natürlicher Sprache zu durchsuchen. Sie verarbeitet Videos, um Metadaten wie Transkription, erkannte Objekte und Gesichter zu extrahieren, und speichert diese Informationen für semantische Abfragen.

Der Kernzweck ist es, eine bestehende Videosammlung in durchsuchbares Wissen umzuwandeln – für ganze Videos und, wo anwendbar, spezifische Szenen – und läuft via Docker, sodass es auf jedem Computer oder Server mit installiertem Docker funktioniert.

Wichtige Funktionen

- Hintergrund-Indexierungsdienst für Videos: Überwacht neue Videodateien und stellt sie für KI-gestützte Analyse bereit, damit deine Bibliothek stets aktuell bleibt.

- Multi-Model-Videoanalyse: Extrahiert Metadaten inklusive Gesichtserkennung, Transkription, Objekt- & Texterkennung sowie Szenenanalyse.

- Vektor-basierte semantische Suche (ChromaDB): Unterstützt natürliche Sprachsuche über Videoinhalte mit Embeddings in ChromaDB.

- Lokale Ausführung mit Docker: Läuft als containerisierte Dienste via Docker Compose für modulare Einrichtung und Einsatz auf verschiedenen Maschinen.

- Modelle für KI/NLP-Verarbeitung: Nutzt Whisper für Transkription und erlaubt die Wahl zwischen Google Gemini oder lokal via Ollama (per Konfiguration).

So nutzt du Edit Mind

- Installiere und starte Docker Desktop (oder stelle sicher, dass Docker auf deinem Server verfügbar ist).

- Klone das Repository und führe den bereitgestellten Einrichtungsablauf aus.

- Stelle deinen Medienordner für Docker bereit durch Konfiguration der Dateifreigabe in Docker Desktop (macOS/Windows). Unter Linux ist Dateifreigabe standardmäßig aktiviert.

- Erstelle Umgebungdateien: Kopiere

.env.exampleund.env.system.examplezu.envund.env.system, dann konfiguriere die erforderlichen Einstellungen. - Setze den Videordner-Pfad (

HOST_MEDIA_PATH) und wähle deine KI-Model-Option:- Ollama: Setze

USE_OLLAMA_MODELplusOLLAMA_HOST,OLLAMA_PORTundOLLAMA_MODEL(und starteollama serve/ lade das Modell vorher). - Gemini: Setze

USE_GEMINIund gibGEMINI_API_KEYan.

- Ollama: Setze

- Generiere Sicherheitsschlüssel: Setze

ENCRYPTION_KEYundSESSION_SECRETmit den Befehlen aus dem Einrichtungsleitfaden. - Starte den Docker-Compose-Stack (das Repo bietet eine Standard-Compose-Datei und eine CUDA-optimierte für NVIDIA-GPUs).

Anwendungsfälle

- Suche nach gesprochenen Wörtern: Durchsuche deine Bibliothek mit Phrasen, die du aus dem Audio erinnerst, basierend auf extrahierter Transkription.

- Finde Videos mit bestimmten Objekten oder On-Screen-Text: Nutze natürliche Sprachabfragen, die an Objekt- & Texterkennung aus der Indexierung gekoppelt sind.

- Lokalisierung von Szenen mit bekannten Gesichtern: Verwende Gesichtserkennungs-Metadaten, um Ergebnisse auf Videos oder Szenen mit bestimmten Personen einzugrenzen.

- Kuratiere und navigiere große persönliche Archive: Halte Metadaten automatisch frisch bei neuen Videodateien und suche ohne manuelles Taggen.

- Betrieb in datenschutzorientierter lokaler Umgebung: Indiziere und suche vollständig auf deinem eigenen Rechner (oder Server) via Docker statt gehosteter Workflows.

FAQ

-

Ist Edit Mind produktionsreif? Das Repository gibt an, es befindet sich in aktiver Entwicklung und ist noch nicht produktionsreif, mit unvollständigen Funktionen und gelegentlichen Fehlern.

-

Erfordert Edit Mind Docker? Ja. Die Einrichtungsanweisungen sehen Docker Compose für den containerisierten Betrieb vor.

-

Welche KI-Optionen werden für die Verarbeitung unterstützt? Die Dokumentation nennt Whisper für Transkription und unterstützt entweder Google Gemini oder Ollama für NLP-Aufgaben, auswählbar per Umgebungsvariablen.

-

Wie verbinde ich das System mit meinen Videodateien? Konfiguriere Docker für Zugriff auf deinen Medienordner (Dateifreigabe in Docker Desktop auf macOS/Windows) und setze

HOST_MEDIA_PATHin der.env-Datei passend zum Ordnerpfad. -

Wo speichert die semantische Suche ihre Daten? Der Stack umfasst ChromaDB für vektor-basierte semantische Suche und PostgreSQL (via Prisma ORM) als relationale Datenbank.

Alternativen

- Cloud-basierte Video-Suchplattformen: Diese zentralisieren die Verarbeitung meist auf gehosteter Infrastruktur. Im Vergleich zu Edit Minds local-first Docker-Ansatz opfern sie möglicherweise Datenschutz/Kontrolle für einfachere Einrichtung.

- Desktop-Tools für Medienverwaltung mit manueller Tagging: Einige Tools ermöglichen die Organisation von Videos über benutzergenerierte Tags und Metadaten. Sie unterscheiden sich dadurch, dass sie keine KI-basierte Transkription/Objekt-/Gesichtserkennung für semantische Suche durchführen.

- Selbst gehostete Transkriptions- + Such-Pipelines: Sie können einen Workflow aufbauen, der Videos transkribiert und Text für die Suche indiziert. Das unterscheidet sich von Edit Mind durch einen engeren Fokus auf Audio/Text statt multimodaler Analyse (Gesichter/Objekte/Szenen) und integrierter semantischer Abfragen.

- Allgemeine Vektordatenbank-Such-Apps: Sie könnten Embeddings und eine Vektordatenbank für semantische Suche nutzen, müssten aber Video-Ingestion, multimodale Extraktion und Szenen-Verknüpfung selbst handhaben – Arbeit, die Edit Mind in seiner Pipeline paketiert.

Alternativen

Wikiwand

KI-gesteuertes Wiki-Aggregator, das entwickelt wurde, um die Benutzererfahrung auf Wikipedia zu verbessern, indem der Wissensverbrauch vereinfacht wird.

Lasso

Lasso ist ein AI-first PIM für E-Commerce-Teams: bereichert Produktattribute & -beschreibungen, verarbeitet Lieferantendaten und überwacht Wettbewerber per App oder API.

Struere

Struere ist ein AI-natives Betriebssystem, das Spreadsheet-Workflows durch strukturierte Software ersetzt – mit Dashboards, Alerts und Automationen.

garden-md

Verwandle Meeting-Transkripte in eine strukturierte, verlinkte Company-Wiki aus lokalen Markdown-Dateien mit HTML-Ansicht und Sync aus unterstützten Quellen.

Falconer

Falconer ist eine selbstaktualisierende Wissensplattform für schnelle Teams: interne Doku und Code-Context schreiben, teilen und gezielt finden – an einem Ort.

ClayHog

ClayHog ist eine AI Search Visibility- und GEO-Plattform: Sie zeigt, was ChatGPT, Gemini, Perplexity, Claude und Google AI Overviews über Ihre Marke sagen.