Playground by Natoma

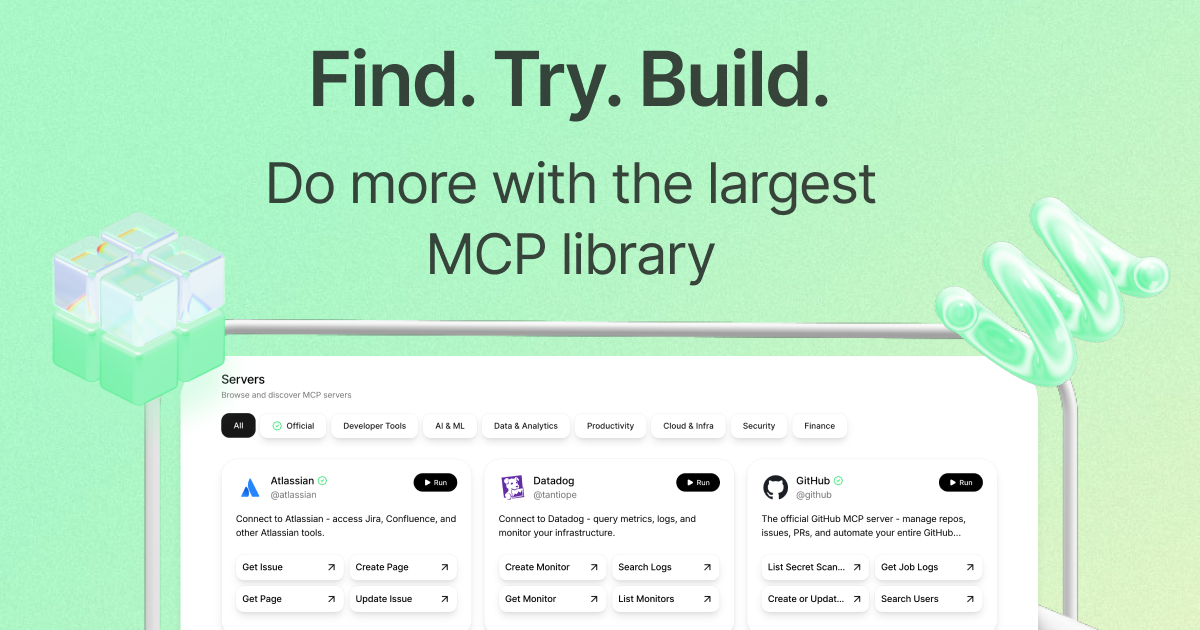

Playground by Natoma: Entdecke und teste MCP-Server direkt im Browser – schnell, ohne Setup. Offizielle und kategorisierte Server inkl. Tool-Aktionen.

Was ist Playground by Natoma?

Playground by Natoma ist eine Weboberfläche zum Durchsuchen und Testen von MCP (Model Context Protocol)-Servern. Sie ist für schnelle Entdeckung konzipiert – so finden Sie einen MCP-Server für ein bestimmtes Tool oder eine Datenquelle und führen Aktionen aus, ohne eigene Umgebung einrichten zu müssen.

Die Seite listet zahlreiche MCP-Server in Kategorien wie Atlassian, Datadog, GitHub, Linear, Notion, Slack, Google Workspace und Datenbanken/Analytics-Tools auf. Jeder Server-Eintrag beschreibt, was möglich ist (z. B. Issues abrufen, Metriken abfragen, Dateien durchsuchen oder Jobs ausführen) und bietet eine handlungsorientierte Möglichkeit, diese Funktionen direkt „auszuführen“.

Wichtige Funktionen

- MCP-Server nach Kategorien durchsuchen (z. B. Productivity, Cloud & Infra, Security, Finance), um schnell das Passende zu finden.

- „Offizielle“ MCP-Server entdecken, inklusive bekannter Integrationen wie GitHub, Linear, Notion, Slack und mehr.

- Server-Aktionen direkt im Playground ausführen (z. B. Elemente erstellen/aktualisieren, suchen, Logs oder Analytics abrufen) ohne zusätzliche Einrichtung, wie auf der Seite erwähnt.

- Tool-spezifische Workflows in verschiedenen Bereichen unterstützen, wie:

- Atlassian (Jira/Confluence-ähnliche Aktionen wie Issues abrufen/erstellen/aktualisieren)

- Observability (Datadog Metriken/Logs/Monitore; Dynatrace Logs/Events/Metriken/Traces)

- Code und CI/CD (GitHub Repo/Issue/PR-Operationen; CircleCI Job/Build/Status)

- Business/Productivity-Apps (Notion Pages/Datenbanken; Slack Nachrichten/Suche/Post; Linear Issue/Project-Operationen)

- Server-Beispiele aus Cloud- und Daten-Tools wie AWS, Azure DevOps, Airbyte, Amplitude, Elasticsearch, Docker und Chroma (Vektorsuche/Dokumentenindizierung).

So verwenden Sie Playground by Natoma

- Öffnen Sie Playground by Natoma und durchsuchen Sie die Liste verfügbarer MCP-Server.

- Wählen Sie den MCP-Server für Ihr Zielsystem aus (z. B. GitHub für Repos/Issues/PRs oder Datadog für Metriken/Logs/Monitore).

- Nutzen Sie die verfügbaren Aktionen des Servers (als ausführbare Items wie „Get Issue“, „Search Logs“, „List Monitors“, „Create Page“ usw.), um den Workflow im Browser zu testen.

- Wiederholen Sie mit anderen Aktionen oder Servern, um Fähigkeiten über Tools hinweg zu vergleichen.

Anwendungsfälle

- MCP-Integration testen vor dem Bauen: Führen Sie Aktionen gegen einen MCP-Server aus (z. B. GitHub für Repos/Issues/PRs verwalten), um verfügbare Operationen zu verstehen.

- Observability-Fehlerbehebung: Nutzen Sie Datadog- oder Dynatrace-MCP-Server-Listings, um Log/Metriken/Monitor-Abfragen zu erkunden (und verwandte Operationen wie „get traces“/„query metrics“).

- Wissensdatenbank-Interaktion und Inhaltsaktualisierungen: Verwenden Sie Notion-Server-Aktionen, um Workspace-Seiten zu durchsuchen, Inhalte zu lesen/aktualisieren und Datenbanken zu verwalten.

- Team-Workflow-Automatisierung erkunden: Nutzen Sie Linear- oder Slack-Server-Aktionen, um Issues/Nachrichten zu durchsuchen und gängige Operationen wie Erstellen/Aktualisieren durchzuführen.

- Datenpipeline- und Analytics-Erkundung: Verwenden Sie Airbyte-Server-Aktionen, um Destinations/Sources/Connections aufzulisten oder Syncs auszulösen; nutzen Sie Amplitude/Elasticsearch/Chroma-Server-Aktionen für Analytics-Abfragen, Suche und Filterung.

FAQ

- Muss ich etwas einrichten, um MCP-Server hier zu testen? Die Seite beschreibt die Nutzung als „einfach, schnell“ mit „kein Setup“ – Sie können Server direkt über den Playground entdecken und testen.

- Ist das auf einen MCP-Server-Typ beschränkt? Nein. Die Server-Liste umfasst viele Kategorien (Developer-Tools, Productivity-Apps, Cloud/Infrastructure, Security, Analytics/Data).

- Welche Aktionen kann ich ausführen? Die Seite zeigt handlungsorientierte Operationen wie „run“, „search“, „list“, „create/update“ und Abruf von Tasks/Jobs/Logs je nach gewähltem MCP-Server.

- Beziehen sich diese Integrationen auf spezifische Tools wie GitHub oder Notion? Ja. Die Liste enthält benannte MCP-Server für diese Tools (z. B. GitHub, Notion, Slack, Linear, Atlassian).

Alternativen

- Direkte MCP-Server-Clients/Tools: Statt eines zentralen Playgrounds kannst du einen selbst konfigurierten MCP-Client/Host nutzen, um spezifische MCP-Server zu verbinden und Aktionen auszulösen.

- Vendorspezifische APIs und Dashboards: Zum Beispiel bieten GitHub/GitHub Actions, Slack APIs oder Datadog/Dynatrace-Konsolen ähnliche Funktionen – allerdings ohne den einheitlichen „MCP-Server-Aktionen ausführen“-Workflow.

- Allgemeine API-Test-Tools: Tools zum Aufrufen von HTTP-APIs und Inspizieren von Antworten eignen sich zum Prototyping von Integrationen, sind aber nicht um MCP-Server-Aktionen und -Entdeckung organisiert.

- Daten-/Observability-Query-Konsolen: Bei datenintensiven Anwendungsfällen können native Query-Interfaces (z. B. für Analytics/Logging/Search) Teile dessen ersetzen, was ein MCP-Server-Playground zur Erkundung bietet – je nach Integrationszielen.

Alternativen

AakarDev AI

AakarDev AI ist eine leistungsstarke Plattform, die die Entwicklung von KI-Anwendungen mit nahtloser Integration von Vektordatenbanken vereinfacht und eine schnelle Bereitstellung und Skalierbarkeit ermöglicht.

Lasso

Lasso ist ein AI-first PIM für E-Commerce-Teams: bereichert Produktattribute & -beschreibungen, verarbeitet Lieferantendaten und überwacht Wettbewerber per App oder API.

Ably Chat

Ably Chat ist eine Chat-API und SDKs für maßgeschneiderte Realtime-Chat-Apps: Reactions, Presence sowie Nachrichten editieren/löschen.

Tavus

Tavus entwickelt KI für Echtzeit-Gespräche von Mensch zu Mensch: sie sieht, hört und reagiert. Zudem Video-Agents, Digital Twins & AI Companions via APIs.

HiringPartner.ai

HiringPartner.ai ist eine autonome Recruiting-Plattform mit KI-Agenten, die rund um die Uhr Kandidaten sourcen, vorqualifizieren, anrufen und interviewen und so die Time-to-Hire von mehreren Wochen auf bis zu 48 Stunden reduziert.

AgentMail

AgentMail ist eine E-Mail-Postfach-API für AI Agents: E-Mails per REST erstellen, senden, empfangen und durchsuchen für bidirektionale Gespräche.