Lamatic.ai

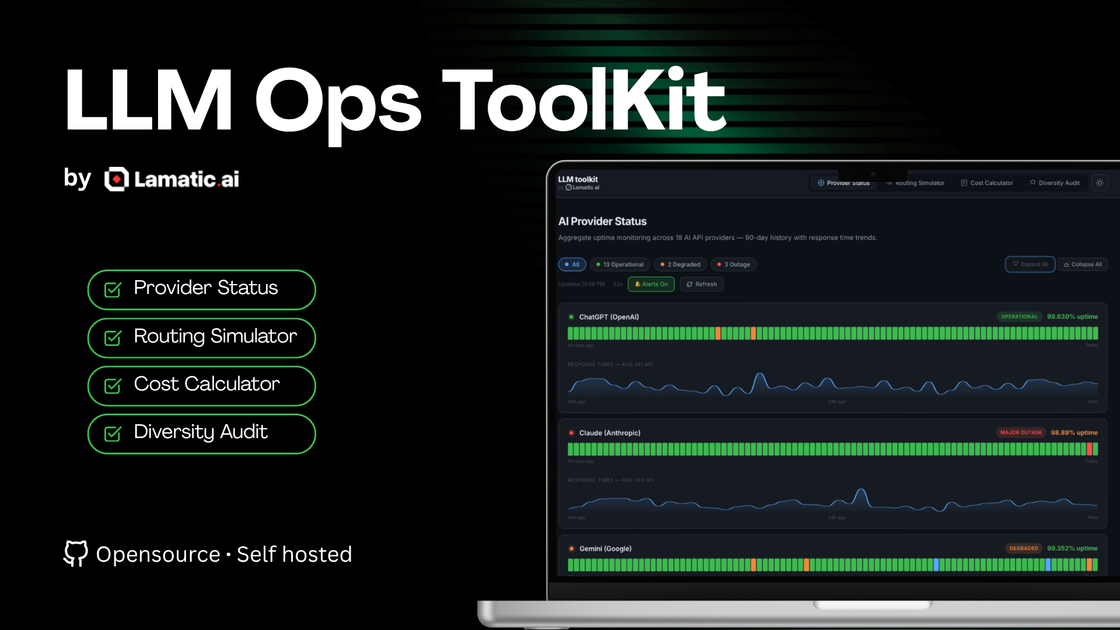

Lamatic.ai LLM Ops Toolkit: Echtzeit-Uptime-Überwachung für 18 AI-API-Provider, Kostenrechner mit TCO, Routing-Simulator & Maturity-Audit.

Was ist Lamatic.ai?

Das LLM Ops Toolkit von Lamatic.ai hilft Teams, mehrere LLM-Provider mit Planungs- und Betriebsübersicht zu evaluieren und zu betreiben. Es kombiniert Tools für Kostenschätzung, Model-Routing-Simulation, Provider-Uptime-Überwachung und eine Operations-Maturity-Bewertung.

Der Kernzweck ist die Unterstützung bei Entscheidungen zu Modellwahl, Request-Routing über Provider und Quantifizierung operativer „versteckter Kosten“ (wie Zeitaufwand für Model-Operations) neben der beobachteten Provider-Zuverlässigkeit.

Wichtige Features

- LLM-Kostenrechner und echte Kostenanalyse: Schätzt monatliche und jährliche Kosten basierend auf Eingaben wie Anzahl Provider, monatlichem API-Ausgabenvolumen, Engineering-Teamgröße, Zeitanteil für Model-Operations und einem TCO-Multiplikator für „echte“ monatliche Kosten und versteckte Kosten.

- Routing-Simulator mit Strategievergleich: Simuliert Request-Routing über verschiedene Modelle mit Parametern wie Request-Volumen, Request-Komplexität und Routing-Strategie (inkl. kostengünstig und Qualitäts-priorisiert), um Kosteneinsparungen und Qualitäts-/Latenz-Ergebnisse zu schätzen.

- Model-Diversität und Maturity-Audit: Bewertet LLM-Ops-Maturity mit gezielten Fragen (als Maturity-Assessment mit Empfehlungen), um nächste Schritte zu leiten.

- Capability Radar (Model-Vergleichsansicht): Zeigt Radar-Style-Vergleich für mehrere Modelle mit Kosten pro 1K Tokens, Qualitätsscore und Latenz.

- Aggregierte Uptime-Überwachung über AI-API-Provider: Verfolgt Provider-Status mit 90-Tage-Historie und Response-Time-Trends, inkl. Status wie betriebsbereit, beeinträchtigt und Ausfall; mit Ausfall-Benachrichtigungssteuerung (markiert durch Alert-Icon).

So nutzen Sie Lamatic.ai

- Starten Sie mit Basisannahmen im Kostenrechner: Legen Sie Anzahl LLM-Provider, monatliches API-Ausgabenvolumen, Engineering-Teamgröße und Prozentsatz der Engineering-Zeit für Model-Operations fest, um „echte Kosten“ und versteckte Kosten zu schätzen.

- Führen Sie eine Routing-Simulation durch: Wählen Sie Request-Volumen und -Komplexität und vergleichen Sie Routing-Strategie-Ergebnisse (z. B. kostenpriorisiert vs. qualitätsorientiert), um Einsparungen und Qualitäts-/Latenz-Veränderungen zu quantifizieren.

- Bewerten Sie Provider-Zuverlässigkeit mit der Uptime-Überwachungsansicht für die letzten 90 Tage Uptime und Response-Time-Trends über unterstützte Provider.

- Führen Sie den Maturity-Audit durch, indem Sie gezielte Fragen beantworten, um empfohlene nächste Schritte aufzudecken und den Platz Ihres aktuellen LLM-Ops-Prozesses im Maturity-Spektrum zu bestimmen.

Anwendungsfälle

- Planung von Multi-Provider-LLM-Budgets: Teams nutzen den Kostenrechner, um rohe API-Rechnungen in eine breitere „echte monatliche Kosten“-Sicht umzuwandeln, inkl. Engineering-Zeit und geschätztem TCO-Multiplikator, um operative Investitionen zu rechtfertigen.

- Bewertung von Routing zur Ausgabensenkung: Durch Simulation einer Routing-Strategie mit Traffic-Anteil an günstigeren Modellen schätzen Engineering-Teams potenzielle Jahreseinsparungen und vergleichen konservative vs. optimistische Routing-Zuweisungen.

- Vergleich von Modellen unter Workload-Annahmen: Teams kombinieren Capability Radar und Routing-Simulator, um Modelle nach Token-Kosten und Latenz zu vergleichen und zu validieren, wie Routing Durchschnittsqualität und -latenz bei gegebenem Request-Profil beeinflusst.

- Überprüfung operativer Risiken bei Provider-Performance: Mit aggregierter Uptime-Überwachung und 90-Tage-Historie analysieren Teams Response-Time-Trends und Ausfälle/Beeinträchtigungen zur Provider-Strategie oder Incident-Planung.

- Lückenanalyse für LLM-Ops-Maturity: Neueinsteiger oder etablierte Organisationen nutzen den Maturity-Audit, um Verbesserungen strukturiert über fragebasierte Capability-Bewertung anzugehen.

FAQ

-

Welche Metriken berechnet das Toolkit für Kosten? Die Seite beschreibt eine echte Kostenanalyse, die monatliche API-Ausgaben mit Engineering-Zeit für Modellbetrieb und einem TCO-Multiplikator kombiniert, um einen „echten monatlichen Kostenwert“ und versteckte Kosten zu erzeugen.

-

Kann ich Routing über mehrere Modelle simulieren? Ja. Der Routing-Simulator ist dafür ausgelegt, zu visualisieren, wie Routing Anfragen über Modelle verteilt, und Kosteneinsparungen sowie Routing-Ergebnisse abzuschätzen.

-

Welche Provider werden von der Uptime-Überwachung abgedeckt? Der Uptime-Monitoring-Bereich gibt an, dass er 18 AI-API-Provider abdeckt und eine 90-Tage-Historie mit Response-Time-Trends bietet.

-

Was misst der Maturity-Audit? Der Maturity-Audit wird als Bewertung mit 10 gezielten Fragen dargestellt und erzeugt Ad-hoc-Empfehlungen sowie eine Capability-Radar-Ansicht.

Alternativen

- LLM-Kosten- und Token-Accounting-Tools (Kostendashboards): Diese konzentrieren sich auf API-Nutzung und Token-Kostentracking, enthalten aber typischerweise nicht dieselbe Kombination aus TCO-Modellierung, Routing-Simulation, Provider-Uptime-Historie und Maturity-Auditing.

- Allgemeine API-Uptime-/Latenz-Monitoring-Plattformen: Monitoring-Tools können Uptime und Response-Zeiten für Endpoints tracken, erfordern aber oft mehr Setup, um LLM-Routing-Entscheidungen und Kosten-/Qualitäts-Trade-offs über mehrere Model-Provider zu modellieren.

- Eigene Routing-Logik mit interner Analytik: Teams können Routing und Evaluation intern mit ihrer Telemetrie aufbauen; das kann Teile des Simulators replizieren, erfordert aber meist mehr Engineering-Aufwand für Kosten-/Qualitäts-/Latenz-Vergleiche und historische Provider-Status-Ansichten.

Alternativen

ClawTick

ClawTick ist eine CLI-first KI-Agenten-Automationsplattform für cronbasierte Webhook-Tasks mit Monitoring, Alerts, Retries und Ausführungslogs.

OpenFlags

OpenFlags ist ein Open-Source, self-hosted Feature-Flag-System für progressive Delivery: lokale Evaluation in App-SDKs und ein simples Control-Plane für gezielte Rollouts.

skills-janitor

skills-janitor prüft, verfolgt die Nutzung und vergleicht deine Claude Code Skills mit neun Slash-Command-Aktionen – ohne Abhängigkeiten.

BenchSpan

BenchSpan führt KI-Agent-Benchmarks parallel aus, erfasst Scores und Fehler in einer geordneten Run-Historie und macht Ergebnisse commit-gebunden reproduzierbar.

Rectify

Rectify ist eine All-in-One-Operations-Plattform für SaaS: Monitoring, Analytics, Support, Roadmaps, Changelogs und Agent-Management in einer visuellen Workspace – steuerbar per Konversation.

PromptScout

PromptScout trackt Markenerwähnungen, empfohlene Wettbewerber und zitierte Quellen in AI-Antworten (ChatGPT, Gemini, Google AI Overviews, Perplexity) inkl. Website-Audits.