CanopyAI

CanopyAI : espace de conversation IA sur toile infinie. Branchez vos idées, conservez le contexte entre threads et changez de modèles par nœud.

Qu'est-ce que CanopyAI ?

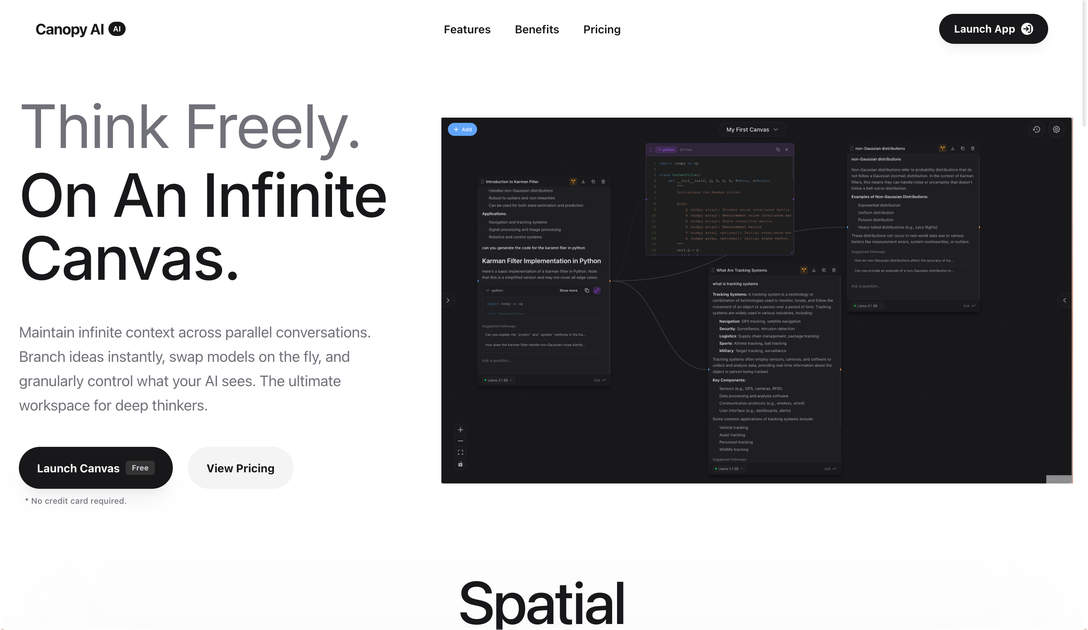

CanopyAI est un espace de conversation IA conçu autour d'une « toile infinie » pour penser et écrire à travers plusieurs threads parallèles. Au lieu de piéger les idées dans un chat linéaire unique, il permet de brancher les conversations, de conserver le contexte entre les nœuds et de réorganiser l'exploration au fur et à mesure que vos idées évoluent.

L'objectif principal est de vous aider à travailler avec de nombreuses invites en cours tout en gardant un fil de raisonnement clair. Le site décrit aussi les contrôles pour ce que voit l'IA par nœud et la possibilité de changer de modèles pendant une session.

Fonctionnalités clés

- Toile infinie avec conversations parallèles : conservez le contexte entre les « nœuds » branchés plutôt que de traiter chaque chat comme isolé.

- Branchage instantané depuis n'importe quel point : bifurquez une conversation pour explorer de nouvelles idées sans perdre le contexte original.

- Changement de modèles en direct : modifiez le modèle de raisonnement pour une branche afin de comparer les sorties dans le même contexte de toile.

- Contrôles fins de génération et de visibilité : gérez ce que voit l'IA et ajustez les paramètres de génération par nœud (ex. : température et limites de tokens).

- « Mémoire searchable et permanente » pour votre travail : enregistrez, annotez et revenez plus tard à vos sorties et notes antérieures.

- Réponses streamées : recevez la sortie progressivement plutôt que d'attendre une réponse complète.

- Espace de travail pour workflows intensifs : un centre de contrôle unique pour gérer de nombreux dialogues en cours au lieu de multiples onglets de navigateur.

Comment utiliser CanopyAI

- Créez une nouvelle toile/session et saisissez votre invite initiale.

- Pour explorer une direction alternative, bifurquez/brancher la conversation depuis le message en cours.

- Pour chaque branche, changez de modèles si besoin et ajustez les paramètres de génération au niveau du nœud (comme la température ou le nombre max de tokens) pour correspondre au type de raisonnement souhaité.

- Enregistrez et annotez les résultats pour revenir plus tard aux branches antérieures, y compris via la mémoire searchable de l'espace de travail.

- Continuez à affiner en branchant à nouveau, en gardant intact le contexte original pendant l'exploration de digressions.

Cas d'usage

- Exploration style recherche : investiguez des hypothèses concurrentes en bifurquant le chat aux points de décision clés tout en conservant un contexte partagé entre branches.

- Comparaison de modèles sur le même problème : utilisez plusieurs modèles dans la même toile pour comparer comment différents moteurs de raisonnement abordent une question tout en préservant le contexte amont.

- Analyse longue avec portée contrôlée : ajustez ce que voit l'IA et affinez les paramètres de génération par branche pour garder les sorties cohérentes entre sous-questions liées.

- Projets actifs avec de nombreux threads : gérez des discussions en cours pour une initiative (ex. : multiples brouillons, variantes ou questions de suivi) dans un espace de travail unique et organisé.

- Revues de workflow et récupération : enregistrez et annotez les sorties importantes, puis recherchez et revisitez les branches antérieures lors du retour au travail.

FAQ

-

CanopyAI supporte-t-il les conversations branchées ? Oui. Le site met en avant le « branchage infini » et la possibilité de bifurquer une conversation instantanément tout en conservant le contexte original.

-

Puis-je changer de modèles IA pendant une session ? Oui. CanopyAI permet de swapper les modèles en direct et de comparer les sorties entre branches.

-

Puis-je contrôler la génération des réponses par l'IA ? La page indique un contrôle avancé par nœud, incluant des paramètres de génération comme la température et une limite de tokens max.

-

Puis-je utiliser mes propres identifiants de fournisseur IA ? Le site indique : « Bring Your Own API Key » et « Use your preferred providers with no usage limits ».

-

Y a-t-il un moyen d'enregistrer et retrouver un travail passé ? La page mentionne une « mémoire searchable et permanente » où vous pouvez enregistrer, annoter vos travaux et y revenir plus tard.

Alternatives

- Assistants IA style notebook (espaces multi-notes) : Mieux adaptés si vous voulez une organisation orientée document, mais vous n'obtiendrez pas le même branchage basé sur nœuds avec contexte préservé.

- Outils multi-threads basés sur chat sans contexte de branchage : Ils gèrent plusieurs chats, mais traitent souvent les threads comme séparés, rendant plus difficile le maintien d'un contexte partagé entre variantes.

- IDE généralistes ou espaces dev avec intégrations LLM : Utiles pour workflows centrés code, mais nécessitent plus de configuration pour recréer une expérience de « toile infinie » avec branchage.

- Outils de gestion de projet avec fonctionnalités IA : Adaptés pour suivre tâches et brouillons, mais ne fournissent généralement pas le même changement de modèles par nœud et contrôles de génération décrits pour CanopyAI.

Alternatives

Falconer

Falconer est une plateforme de connaissances qui se met à jour automatiquement pour équipes rapides : écrivez, partagez et trouvez une documentation interne fiable.

BookAI.chat

BookAI vous permet de discuter avec vos livres en utilisant l'IA en fournissant simplement le titre et l'auteur.

skills-janitor

skills-janitor audite, suit l’usage et compare vos compétences Claude Code avec neuf actions d’analyse par commandes slash, sans dépendances.

Lasso

Lasso est un PIM orienté IA pour équipes e-commerce : enrichit attributs et descriptions, traite les données fournisseurs et suit les concurrents via app ou API.

Struere

Struere est un système opérationnel natif AI qui remplace les workflows Excel par des logiciels structurés : tableaux de bord, alertes et automatisations.

garden-md

Transformez des transcriptions de réunion en wiki d’entreprise structuré et lié, via des fichiers markdown locaux et une vue HTML, avec synchronisation.