Arlopass

Arlopass è un’estensione browser e SDK open-source gratuito: consente alle web app di usare i provider AI (Ollama, Claude, GPT, Gemini, Bedrock) senza esporre chiavi API.

Cos'è Arlopass?

Arlopass è un'estensione browser e SDK per sviluppatori open-source gratuito che aiuta le web app a usare i tuoi provider AI senza esporre le chiavi API al browser o a un proxy server. Invece di codificare le credenziali nell'applicazione, Arlopass gestisce le connessioni ai provider e il routing lato utente.

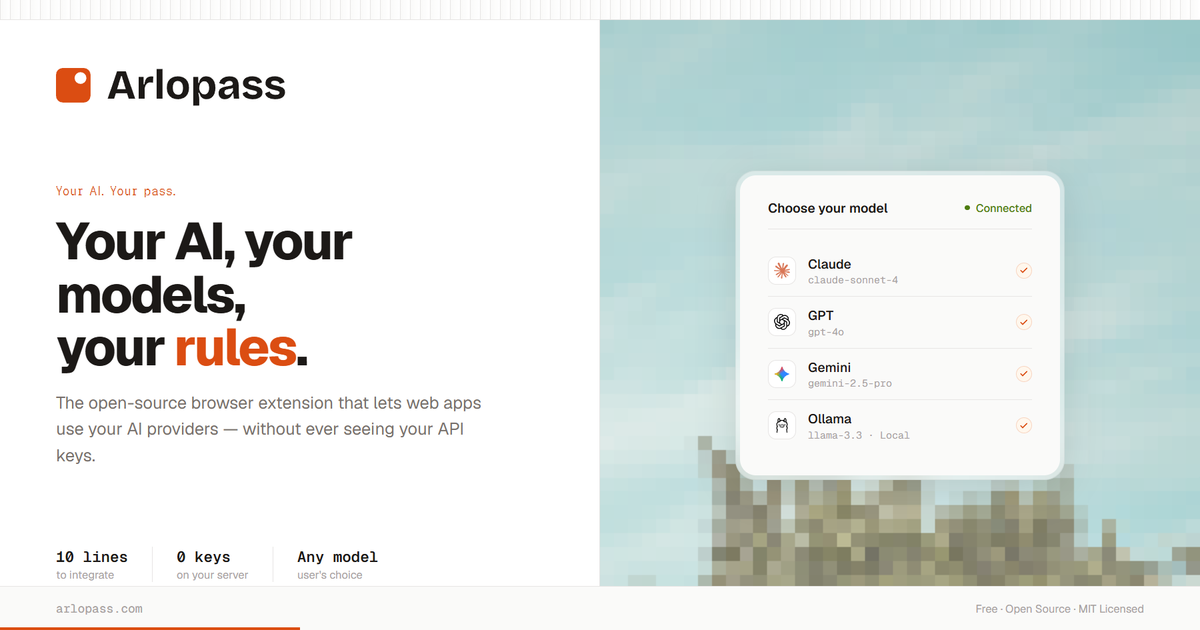

Con Arlopass, gli utenti possono scegliere quali provider AI e modelli un sito specifico può accedere, approvare richieste di connessione e impostare regole come l'obbligo di permesso per ogni richiesta. L'obiettivo è mantenere il controllo sulla selezione dei modelli e la gestione delle credenziali in mano all'utente.

Caratteristiche Principali

- Estensione browser per accesso AI per-app: Quando una web app richiede l'uso di AI tramite Arlopass, l'utente può approvare o negare la connessione e selezionare quali provider/modelli sono consentiti.

- Selezione di provider e modelli: Gli utenti possono attivare/disattivare provider (es. Ollama, Claude, OpenAI/GPT, Gemini, Bedrock) e scegliere quali modelli specifici il sito può usare.

- Vault credenziali locale (nessuna chiave nel browser/server): Le credenziali API sono memorizzate in un vault locale sul dispositivo, con crittografia a riposo (AES-256-GCM). Le chiavi non vengono mai inserite nel browser né inviate a un server.

- Flusso “zero gestione chiavi”: Per sviluppatori e utenti, l'interfaccia si concentra sull'approvazione dell'accesso e la scelta dei modelli, senza gestire chiavi nel codice dell'app.

- SDK sviluppatore con integrazione ~10 righe: L'esempio fornito usa

connect()esession.createChat()conchat.stream(...)per trasmettere l'output tramite iteratore asincrono, mentre Arlopass dell'utente gestisce auth provider e routing. - Regole e limiti permessi per-app: L'UI supporta opzioni come “Chiedi sempre permesso”, modalità “Autopilot” per chiamate consecutive e impostazione “Limite token giornaliero”.

Come Usare Arlopass

- Installa l'estensione Chrome dal Chrome Web Store.

- Collega i tuoi provider AI in Arlopass (Ollama, Claude, OpenAI, Gemini, Bedrock mostrati nella sorgente). Le credenziali sono crittografate in un vault locale sul tuo dispositivo.

- Consenti l'accesso per una web app specifica: quando un sito richiede uso AI, Arlopass ti invita a selezionare provider e modelli consentiti, confermando poi la sessione sicura.

- Usa l'SDK nella tua app (per sviluppatori): installa

@arlopass/web-sdk, chiamaconnect(), crea una sessione chat e trasmetti risultati dachat.stream(...). La tua app non riceve né memorizza chiavi API.

Casi d'Uso

- Accesso AI controllato dall'utente per un sito specifico: Puoi collegare e limitare un singolo sito (es. consentendo solo modelli Claude per quel sito) negando gli altri.

- Passaggio tra modelli senza modificare il codice app: Se più provider/modelli sono consentiti per un sito, gli utenti possono aggiornare i permessi per usare modelli diversi mentre l'app continua a chiamare Arlopass.

- Flussi di richiesta con permesso vs automatizzati: Per task ad alta sensibilità, mantieni “Chiedi sempre permesso”; per workflow leggeri, attiva “Autopilot mode” per eseguire chiamate AI consecutive senza prompt per richiesta.

- Limitazione rate via limiti token giornalieri: Imposta un “Limite token giornaliero” (la sorgente mostra es. 100k / 50k) per app collegate per contenere il consumo.

- Integrazione sviluppatore senza proxy backend: Invece di creare un proxy credenziali lato server, uno sviluppatore può instradare richieste AI tramite Arlopass con l'SDK, tenendo le credenziali utente sul dispositivo.

FAQ

-

Arlopass espone le mie chiavi API al browser? No. Le credenziali sono crittografate in un vault locale sul tuo dispositivo e non vengono inserite nel browser.

-

Uno sviluppatore deve gestire chiavi API nel server o codice? La sorgente enfatizza “zero gestione chiavi” e “no proxy backend”, con l'esempio SDK che mostra

connect()e creazione sessione senza che lo sviluppatore veda o memorizzi chiavi API. -

Gli utenti possono approvare quali provider e modelli un sito può usare? Sì. Il flusso di connessione include selezione provider (passo 1) e modelli (passo 2) per l'app richiedente.

-

C'è un'opzione per richiedere conferma per ogni richiesta AI? Sì. L'UI permessi include “Chiedi sempre permesso” e anche modalità “Autopilot” per chiamate consecutive.

-

Quali limiti si possono impostare per l'uso di un'app? La sorgente menziona “Limite token giornaliero” e mostra valori esempio di limiti token nell'UI permessi app.

Alternative

- Integrazioni dirette delle API dei provider nella tua web app: Puoi chiamare direttamente i provider di modelli dal tuo server, ma di solito devi gestire chiavi API e routing da solo invece di affidarti a un vault di credenziali lato utente e approvazioni per-app.

- Servizi proxy server-side per LLM: Un altro approccio è creare un backend che custodisce le credenziali e inoltra le richieste. Questo differisce da Arlopass spostando la gestione delle chiavi sulla tua infrastruttura anziché sul dispositivo dell'utente.

- Chiamate ai modelli lato client con chiavi gestite dall'utente: Alcune configurazioni richiedono agli utenti di incollare le chiavi API nel browser o client. Questo differisce dall'approccio di Arlopass di mantenere le credenziali in un vault crittografato locale e non nel browser.

Alternative

AakarDev AI

AakarDev AI è una piattaforma potente che semplifica lo sviluppo di applicazioni AI con integrazione fluida dei database vettoriali, consentendo un rapido deployment e scalabilità.

Arduino VENTUNO Q

Arduino VENTUNO Q è un edge AI computer per robotica: unisce inferenza AI e microcontrollore per controllo deterministico, con sviluppo in Arduino App Lab.

Devin

Devin è un agente AI per la programmazione che aiuta i team software a completare migrazioni e grandi refactoring eseguendo sottotask in parallelo, con approvazione umana.

BenchSpan

BenchSpan esegue benchmark per AI agent in parallelo, salva punteggi e errori in una run history ordinata e replica risultati con commit-tag.

open-codex-computer-use

open-codex-computer-use è un servizio open-source “Computer Use” in wrapper MCP per far eseguire azioni GUI agli agenti su macOS, Linux e Windows.

Codex Plugins

Usa Codex Plugins per combinare skill, integrazioni app e server MCP in workflow riutilizzabili: estendi Codex per lavorare con Gmail, Google Drive e Slack.