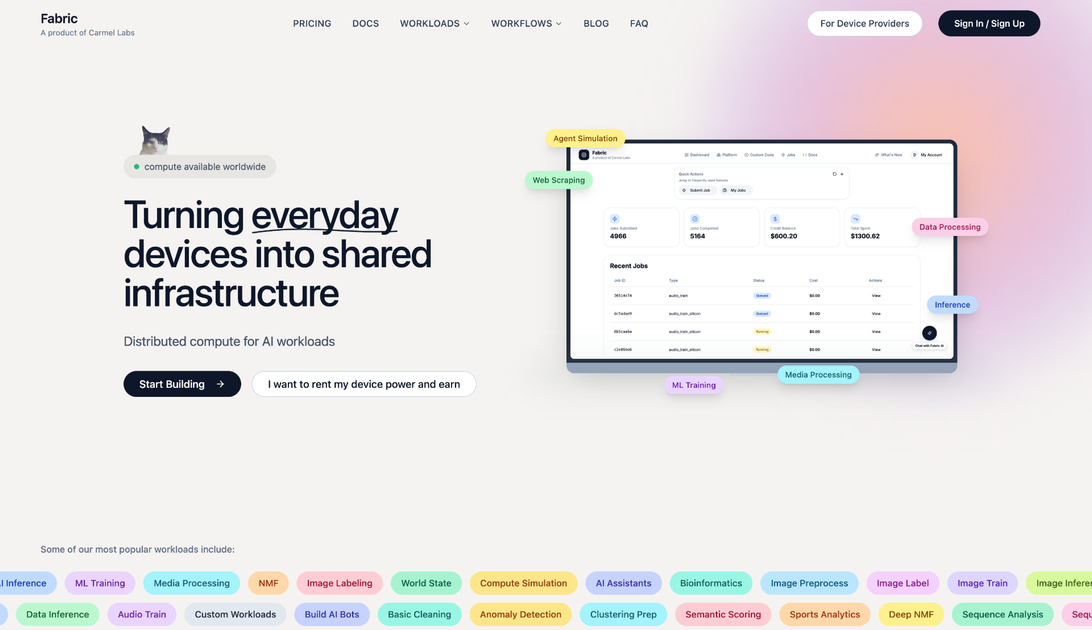

Fabric

Fabric è una rete di calcolo distribuita decentralizzata che collega risorse di calcolo inattive con carichi di lavoro di intelligenza artificiale (AI) e machine learning (ML) esigenti, offrendo soluzioni convenienti per inferenza e training.

Cos'è Fabric?

Fabric sta aprendo la strada alla prossima generazione di infrastrutture decentralizzate creando una rete globale e senza permessi per il calcolo distribuito. Al suo centro, Fabric risolve i crescenti problemi di costo e centralizzazione associati ai moderni carichi di lavoro AI, come l'inferenza di modelli linguistici di grandi dimensioni (LLM) e il complesso training di machine learning. Sfruttando la capacità GPU e CPU sottoutilizzata sparsa in tutto il mondo—dai data center alle singole macchine ad alte prestazioni—Fabric fornisce un'alternativa scalabile, resiliente e significativamente più economica rispetto ai fornitori di cloud tradizionali.

Questa rete agisce come un marketplace dove i fornitori di calcolo (coloro che dispongono di risorse inattive) possono guadagnare un reddito passivo servendo richieste di calcolo dai richiedenti di carichi di lavoro (sviluppatori, ricercatori e aziende). Questo modello peer-to-peer riduce drasticamente i costi generali, portando a costi di inferenza che possono essere una frazione delle tariffe standard del cloud, democratizzando l'accesso al calcolo ad alte prestazioni per lo sviluppo AI all'avanguardia.

Caratteristiche Principali

- Aggregazione di Calcolo Decentralizzata: Collega vaste riserve di potenza GPU e CPU inattive a livello globale, garantendo alta disponibilità e distribuzione geografica per i carichi di lavoro.

- Efficienza dei Costi: Offre prezzi drasticamente ridotti per attività ad alta intensità di calcolo, in particolare per lavori di inferenza ad alto volume, rendendo l'AI avanzata accessibile a team più piccoli e startup.

- Supporto Flessibile per Carichi di Lavoro: Ottimizzato per compiti AI/ML esigenti, inclusa l'inferenza in tempo reale, il serving di modelli e i lavori di training distribuiti.

- Accesso Senza Permessi (Permissionless): Aperto a chiunque disponga di hardware compatibile per unirsi come fornitore o a chiunque necessiti di potenza di calcolo per unirsi come richiedente, favorendo un ecosistema veramente aperto.

- Sicurezza e Verifica: Utilizza meccanismi robusti per garantire l'integrità e la sicurezza dei dati e del calcolo attraverso i nodi distribuiti.

- Generazione di Reddito Passivo: I fornitori di calcolo possono monetizzare facilmente le loro risorse hardware inattive esistenti contribuendo alla rete.

Come Usare Fabric

Iniziare con Fabric comporta percorsi distinti per coloro che offrono risorse e per coloro che le consumano.

Per i Fornitori di Calcolo (Guadagnare Reddito):

- Configurazione del Nodo: Installare il software client Fabric sulla propria macchina, assicurandosi di disporre di hardware ad alte prestazioni compatibile (specialmente GPU).

- Onboarding e Staking: Seguire le istruzioni a schermo per registrare la propria capacità hardware e potenzialmente mettere in stake token per segnalare impegno e qualità.

- Accettare Carichi di Lavoro: Il sistema abbina automaticamente la capacità disponibile con le richieste di calcolo in arrivo in base alle specifiche hardware e alla prossimità geografica.

- Verifica e Pagamento: Una volta che il lavoro è completato e verificato dalla rete, si riceve il pagamento direttamente.

Per i Richiedenti di Carichi di Lavoro (Eseguire Lavori):

- Definire i Requisiti: Specificare le proprie esigenze computazionali, inclusi il tipo di GPU richiesto (es. A100, H100), la memoria e la natura del compito (es. inferenza LLM, fine-tuning).

- Inviare il Lavoro: Inviare il pacchetto del carico di lavoro (es. container Docker, pesi del modello) alla rete Fabric.

- Abbinamento Automatico: Lo strato di orchestrazione di Fabric suddivide intelligentemente il lavoro e lo distribuisce sui nodi più adatti ed economicamente vantaggiosi.

- Recuperare i Risultati: Monitorare l'avanzamento del lavoro e recuperare in modo sicuro gli output finali o le risposte del modello al completamento.

Casi d'Uso

- Serving di Inferenza LLM ad Alto Volume: Startup e aziende che eseguono applicazioni AI rivolte ai consumatori (chatbot, generazione di contenuti) possono implementare i loro modelli su Fabric per gestire enormi volumi di richieste a una frazione del costo del cloud centralizzato, portando a margini migliori.

- Fine-Tuning e Sperimentazione di Modelli AI: Ricercatori e ingegneri ML possono iterare rapidamente sul fine-tuning di grandi modelli di base senza essere limitati dagli alti costi orari di noleggio GPU, accelerando il ritmo della scoperta.

- AI Edge Deployment ed Elaborazione Dati: Le aziende che necessitano di elaborare grandi set di dati o eseguire inferenza più vicino alla fonte dei dati possono sfruttare la natura distribuita di Fabric per implementare risorse di calcolo geograficamente dove necessario, riducendo la latenza.

- Rendering e Simulazione Decentralizzati: Oltre alla pura AI, Fabric può supportare altri compiti ad alta intensità di calcolo come complesse simulazioni scientifiche o farm di rendering 3D che richiedono capacità di picco (burst capacity).

- Sviluppatori AI Indipendenti: Gli sviluppatori individuali che in precedenza non potevano permettersi l'infrastruttura necessaria per addestrare o implementare modelli di grandi dimensioni possono ora accedere a potenza di calcolo di livello enterprise a prezzi accessibili.

FAQ

D: In che modo Fabric garantisce la sicurezza dei miei modelli e dati proprietari? A: Fabric impiega tecniche avanzate di verifica crittografica e containerizzazione (come ambienti Docker sicuri) per isolare i carichi di lavoro. I dati vengono elaborati in modo sicuro all'interno del nodo del fornitore e i risultati vengono verificati prima del pagamento, garantendo che la proprietà intellettuale rimanga protetta.

D: Che tipo di hardware è più prezioso sulla rete Fabric? A: Attualmente, l'hardware dotato di moderne GPU NVIDIA (in particolare quelle con elevata VRAM come A10G, A100, H100) è quello più richiesto per i carichi di lavoro AI. Tuttavia, anche le CPU con un elevato numero di core sono preziose per alcuni compiti preparatori e lavori di inferenza più piccoli.

D: Come viene determinato il prezzo per i lavori di calcolo? A: Il prezzo è dinamico, determinato dall'offerta (offerte dei fornitori disponibili) e dalla domanda (esigenze dei richiedenti). I fornitori stabiliscono tariffe competitive e la rete seleziona automaticamente la combinazione più efficiente di risorse che soddisfa i requisiti di qualità e latenza specificati dal richiedente.

D: Fabric è solo per l'AI, o posso eseguire attività di calcolo generico? A: Sebbene Fabric sia fortemente ottimizzato e commercializzato per i carichi di lavoro AI/ML a causa della domanda di mercato attuale, l'architettura sottostante supporta compiti di calcolo distribuito generico che possono essere containerizzati ed eseguiti attraverso la rete.

D: Cosa succede se un fornitore di calcolo si disconnette a metà lavoro? A: La rete utilizza meccanismi di ridondanza e tolleranza ai guasti. Se un nodo fallisce, i segmenti rimanenti del lavoro vengono automaticamente ridistribuiti ad altri nodi verificati disponibili nella rete per garantire il completamento del lavoro senza perdita di dati o ritardi significativi.

Alternative

AakarDev AI

AakarDev AI è una piattaforma potente che semplifica lo sviluppo di applicazioni AI con integrazione fluida dei database vettoriali, consentendo un rapido deployment e scalabilità.

Ably Chat

Ably Chat è un’API e SDK per chat realtime: crea applicazioni personalizzate con reazioni, presenza e modifica/eliminazione dei messaggi.

Paperpal

Paperpal è un tool AI per la scrittura accademica: lettura intelligente dei documenti, revisione e riscrittura in inglese, componenti e controlli pre-submissione.

VForms

VForms consente la creazione di questionari interattivi sovrapposti direttamente sui video di YouTube, permettendo agli utenti di raccogliere feedback altamente contestuali e approfondite informazioni sugli utenti.

BookAI.chat

BookAI ti consente di chattare con i tuoi libri utilizzando l'IA semplicemente fornendo il titolo e l'autore.

DeepMotion

DeepMotion è una piattaforma AI di motion capture e body-tracking per creare animazioni 3D da video (e testo) nel browser, con Animate 3D API.