CanopyAI

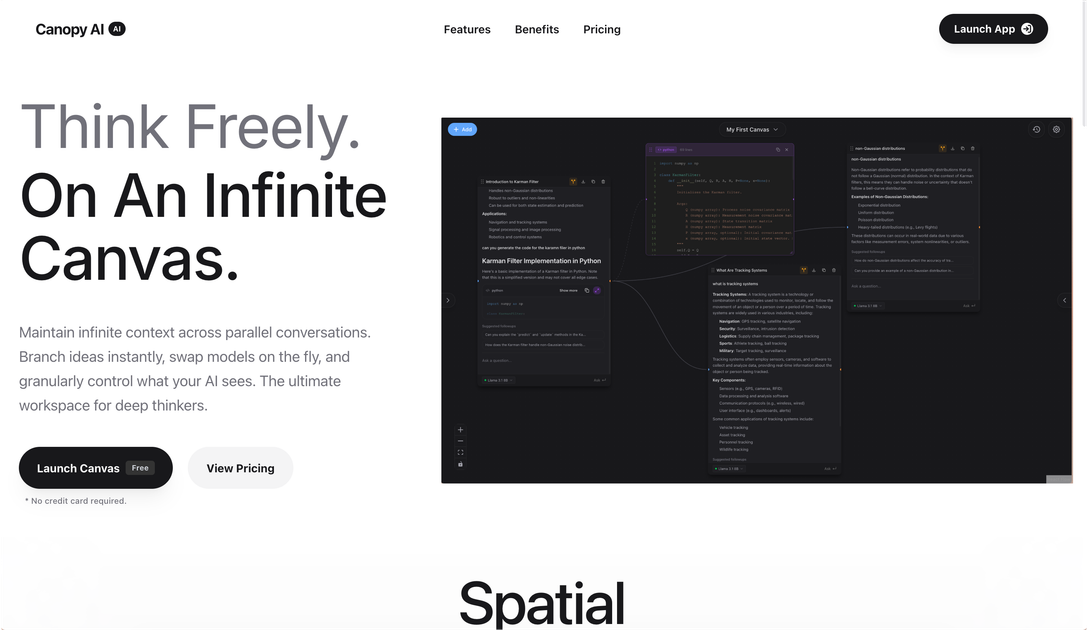

CanopyAIは、複雑なAI対話を管理するために設計された無限キャンバスワークスペースであり、ユーザーがアイデアを分岐させ、モデルを切り替え、並行するディスカッション全体で完全なコンテキストを維持できるようにします。

CanopyAIとは?

CanopyAIは、線形的で孤立したチャットウィンドウの限界を超え、AIインタラクションの状況を一変させます。これは、思考とAIの会話が有機的かつ相互に接続された状態で展開できる空間環境である「無限キャンバス」という概念を導入します。このプラットフォームは、堅牢なコンテキスト管理と、主要な目的に関する追跡を失うことなく複数の推論ラインを同時に探求する柔軟性を必要とするパワーユーザー、研究者、開発者、そして深い思考を持つ人々のために特別に設計されています。

標準的なチャットボットインターフェースとは異なり、CanopyAIは一連のプロンプトと応答を視覚的なマップ上の相互接続されたノードに変換します。この空間的インテリジェンスにより、ユーザーは会話を即座にフォーク(分岐)させたり、接線的なアイデアを探求したり、その後シームレスにマージしたり、並行するパスを進んだりすることができます。中核となる価値提案は、これらの並行する探求全体で無限のコンテキストを維持し、すべてのAIモデルのやり取りがプロジェクトまたは問題空間の完全で共有された理解に基づいて構築されることを保証する点にあります。

主な機能

CanopyAIは、高度なワークフロー管理とモデルの柔軟性を中心に構築されています。

- 無限の分岐 (Infinite Branching): 任意のメッセージまたは会話ノードを即座にフォークし、新しいアイデアを追求したり仮説をテストしたりできます。これにより、元の主要なスレッドを脱線させることなく、あらゆる可能性を包括的に探求できます。

- 空間的インテリジェンス (Spatial Intelligence): 従来の逐次的なチャットログの制約から解放され、複雑な思考プロセスを非線形のキャンバス上に視覚化します。異なる調査ライン間の関係を整理し、確認できます。

- マルチモデル切り替え (Multi-Model Switching): GPT-4、Claude 3.5、Perplexity、Grokなどの異なる大規模言語モデル(LLM)間を、ノードごと、またはブランチごとに楽に切り替えることができます。これにより、同一のコンテキストを維持しながら、推論エンジンの直接比較が可能になります。

- 高度なパラメーター制御 (Advanced Parameter Control): 生成パラメーター(温度や最大トークンなど)を特定のノードごとに細かく調整でき、AIの出力スタイルと長さを正確に制御できます。

- 独自のAPIキー持ち込み (Bring Your Own API Key - BYOK): ユーザーは既存のAPIキーをさまざまなプロバイダーから統合でき、プラットフォームの使用制限に縛られることなく柔軟な利用が可能です。

- 検索可能な永続メモリ (Searchable, Permanent Memory): すべての作業、注釈、会話は保存、インデックス化、検索可能であり、将来の参照のための永続的で整理されたナレッジベースとして機能します。

- コンテキストの保持 (Context Preservation): 派生した話題やブランチがメインスレッドのコンテキストを損なうことはなく、深い探求であっても元の問題記述にしっかりと結びついた状態を保ちます。

CanopyAIの使い方

CanopyAIの開始は、初期キャンバスの確立と、複雑なタスクのための分岐機能の活用に焦点を当てています。

- キャンバスの起動: ワークスペースを起動します。初期ティアではクレジットカードが不要なため、ユーザーはすぐに探求を開始できます。

- コアスレッドの確立: キャンバス上で主要な会話または問題記述を開始します。これが思考プロセスのルートノードを形成します。

- 探求のための分岐: 複数の方向性が実行可能と思われる点(例:異なる仮定のテストや、異なるモデルを使用したフォローアップの質問)に遭遇した場合、その特定のメッセージを右クリックするか、「フォーク (Fork)」オプションを選択します。

- モデル比較: 新しく作成されたブランチ内で、アクティブなAIモデルを切り替えます(例:GPT-4からClaude 3.5へ)。これにより、親ノードからコンテキストを継承しながら、同じ入力に対する推論がどのように変化するかを確認できます。

- 整理と洗練: 並行するスレッドの開発を続けます。視覚的なキャンバスを使用して、関連するノードをグループ化し、重要な発見に注釈を付け、派生的な探求が明確に分離されつつもアクセス可能であることを確認します。

- 保存と再開: CanopyAIはキャンバスの状態全体を自動的に保存するため、セッションを閉じても、次回開いたときにすべてのコンテキストが維持された正確な時点から作業を再開できます。

ユースケース

CanopyAIは、高い認知的負荷と厳格なコンテキスト管理を要求するワークフローに最適化されています。

- 科学研究と仮説検定: 研究者は、複雑な理論(表示されているフェルミのパラドックスの例など)をマッピングし、反論をテストしたり、データ分析や文献レビューのための専門モデルを使用して異なる裏付け証拠を探求したりするために即座に分岐できます。

- ソフトウェア開発とデバッグ: 開発者は、機能実装のためのメインスレッドを維持しつつ、特定のバグのデバッグ、代替アーキテクチャ設計のテスト、または異なるLLMからのコード生成出力の並行比較のために分岐できます。

- 戦略的なビジネス計画: 起業家や戦略家は、市場参入計画をマッピングできます。一つのブランチがハイリスク・ハイリターンの戦略を探求する一方で、もう一つのブランチが保守的なアプローチを探求し、経営陣が同じ初期市場データに基づいて結果を比較できるようにします。

- 複雑なコンテンツ作成とアウトライン作成: 作家や教育者は、大規模なドキュメントのアウトラインを作成し、特定の章や議論を孤立させて開発するために分岐させることができます。これにより、すべての開発セクションでコアとなる物語構造の一貫性が保証されます。

- 比較AI監査: 特定のタスクに最適な基盤モデルを選択する必要があるチームは、3つの異なるモデルに対して全く同じ複雑なプロンプトシーケンスを個別のブランチで同時に実行し、パフォーマンス指標を客観的に評価できます。

FAQ

Q: CanopyAIは無料で利用できますか? A: CanopyAIは無料ティアを提供しており、開始にあたりクレジットカードは不要です。高度な機能、より高い使用制限、BYOK統合への完全なアクセスは、通常、有料サブスクリプションプランで利用可能です。

Q: モデルを切り替える際、CanopyAIはコンテキストをどのように処理しますか? A: これは中核的な強みです。ブランチ内またはノード内でモデルを切り替える際、新しいモデルはキャンバス上のそれまでの全コンテキスト履歴を継承するため、連続性が確保され、モデルが最初から開始するのを防ぎます。

Q: 自分のOpenAIやAnthropicのAPIキーを使用できますか? A: はい、CanopyAIは独自のAPIキー持ち込み(BYOK)機能をサポートしており、好みのプロバイダーを接続して、CanopyAI自体を介した使用料を発生させることなくプラットフォームを使用できます(ただし、プロバイダーからの標準API料金は適用されます)。

Q: ブランチを削除した場合、どうなりますか? A: ブランチを削除すると、その特定の調査ラインとその関連履歴がキャンバスビューから削除されます。ただし、元の親ノードとメインスレッドには完全に影響が残り、コアな作業は保護されます。

Q: データは永続的に保存されますか? A: はい、CanopyAIは、作業が検索可能な永続メモリで保存されることを重視しています。これは、アプリケーションを閉じても、次回開いたときにワークスペース全体が完全にインデックス化された状態で、まさに中断した時点に戻れることを意味します。

代替品

BookAI.chat

BookAIは、書名と著者を提供するだけで、AIを使って本とチャットできるサービスです。

skills-janitor

skills-janitorでClaude Codeのスキルを監査・使用状況を追跡し、9つの/コマンドと比較。重複や不備もチェック。依存なし。

Lasso

LassoはAI-firstのPIM。商品属性や説明の充実、サプライヤーデータ処理、アプリまたはAPIでの競合モニタリングに対応。

Biji

Bijiは、革新的なツールと機能を通じて生産性を向上させるために設計された多目的プラットフォームです。

Struere

Struereはスプレッドシートの運用を置き換えるAIネイティブな業務OS。ダッシュボード、アラート、オートメーションで一元化。

garden-md

会議の文字起こしをローカルMarkdownで構造化し、HTMLブラウザ表示の会社wikiを作成。対応ソースから同期可能。