CanopyAI

CanopyAIは無限キャンバスのAI会話ワークスペース。並列スレッドで文脈維持し、ノードごとにモデル切替。枝分かれ作業に最適。

CanopyAIとは?

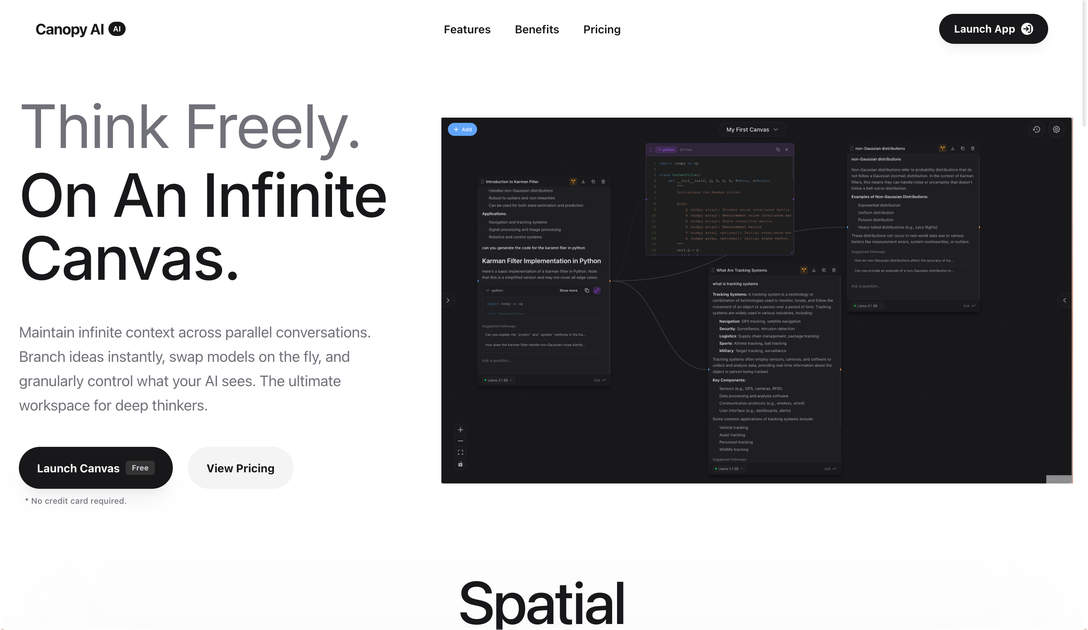

CanopyAIは、無限キャンバスを中心としたAI会話ワークスペースです。複数の並列スレッドで思考・執筆が可能。単一の直線的チャットにアイデアを閉じ込めず、会話を枝分かれさせ、ノード間で文脈を維持し、アイデアの進化に応じて探索を再編成します。

主な目的は、多くの進行中プロンプトを扱いつつ、明確な推論の流れを保つこと。サイトでは、ノードごとのAIが見る内容の制御と、セッション中のモデル切替機能も説明されています。

主な機能

- 並列会話付き無限キャンバス:各チャットを孤立扱いせず、枝分かれ「ノード」で文脈を維持。

- 任意の地点からの即時枝分かれ:元の文脈を失わず、新アイデアを追求するための会話分岐。

- 即時複数モデル切替:同一キャンバス文脈内で分岐ごとの推論モデルを変更し、出力を比較。

- 詳細な生成・表示制御:ノードごとにAIが見る内容を制御し、生成パラメータ(例: temperature、トークン制限)を調整。

- 作業のための「検索可能・永続メモリ」:出力やノートを保存・注釈付け、後で戻って利用。

- ストリーミング応答:完全応答を待たず、逐次出力を受け取る。

- 重いワークフロー向けワークスペース:多数の別タブではなく、単一のコントロールセンターで進行中対話を管理。

CanopyAIの使い方

- 新しいキャンバス/セッションを開始し、初期プロンプトを入力。

- 代替方向を探る場合、作業中のメッセージから会話を分岐/枝分かれ。

- 各分岐で必要に応じモデルを切り替え、ノードレベルの生成パラメータ(temperatureや最大トークン数など)を目的の推論に合わせて調整。

- 結果を保存・注釈付けし、検索可能メモリを使って後で初期分岐に戻る。

- さらに枝分かれを繰り返し、元の文脈を保持したまま派生を探求。

ユースケース

- リサーチスタイルの探索:キー決定点でチャットを分岐し、競合仮説を調査。分岐間で共有文脈を保持。

- 同一問題でのモデル比較:同一キャンバス内で複数モデルを使い、上流文脈を保持したまま異なる推論エンジンのアプローチを比較。

- 制御されたスコープの長文分析:分岐ごとにAIの見える内容を調整し、生成パラメータをチューニングして関連サブ質問で出力の一貫性を保つ。

- 多数スレッドのアクティブプロジェクト:イニシアチブの進行中議論(複数ドラフト、バリエーション、フォローアップ質問など)を単一の整理されたワークスペースで管理。

- ワークフローレビューと検索:重要出力を保存・注釈付けし、後で検索して初期分岐を再訪。

FAQ

-

CanopyAIは会話の枝分かれをサポートしますか? はい。サイトでは「無限枝分かれ」と、元の文脈を維持した即時会話分岐を強調。

-

セッション中にAIモデルを切り替えられますか? はい。CanopyAIは即時モデル交換と分岐間出力比較を可能と記述。

-

AIの応答生成を制御できますか? ページではノードごとの高度制御を記載。temperatureや最大トークン設定などの生成パラメータを含む。

-

独自のAIプロバイダ認証情報を利用できますか? サイトでは「Bring Your Own API Key」と「使用制限なしで好みのプロバイダ利用」を記載。

-

過去の作業を保存・検索できますか? ページでは「検索可能・永続メモリ」を言及。作業を保存・注釈付けし、後で戻る。

代替品

- ノートブックスタイルAIアシスタント(マルチノートワークスペース):ドキュメント指向の整理を求める場合に適するが、ノードベースの枝分かれと文脈保持は得られない可能性。

- 枝分かれ文脈なしのチャットベースマルチスレッドツール:複数チャット対応だが、スレッドを分離扱いし、バリエーション間の共有文脈維持が困難。

- LLM統合付き汎用IDEや開発者ワークスペース:コード中心ワークフロー時に有用だが、「無限キャンバス」枝分かれ体験の再現にセットアップが必要。

- AI機能付きプロジェクト管理ツール:タスク・ドラフト追跡に適するが、CanopyAI記述のノードごとモデル切替・生成制御は通常提供されない。

代替品

Falconer

Falconerは、スピード重視のチーム向けの自己更新ナレッジ基盤。社内ドキュメントとコード文脈を一元化して共有・検索できます。

BookAI.chat

BookAIは、書名と著者を提供するだけで、AIを使って本とチャットできるサービスです。

skills-janitor

skills-janitorでClaude Codeのスキルを監査・使用状況を追跡し、9つの/コマンドと比較。重複や不備もチェック。依存なし。

Lasso

LassoはAI-firstのPIM。商品属性や説明の充実、サプライヤーデータ処理、アプリまたはAPIでの競合モニタリングに対応。

Struere

Struereはスプレッドシートの運用を置き換えるAIネイティブな業務OS。ダッシュボード、アラート、オートメーションで一元化。

garden-md

会議の文字起こしをローカルMarkdownで構造化し、HTMLブラウザ表示の会社wikiを作成。対応ソースから同期可能。