Fabricとは?

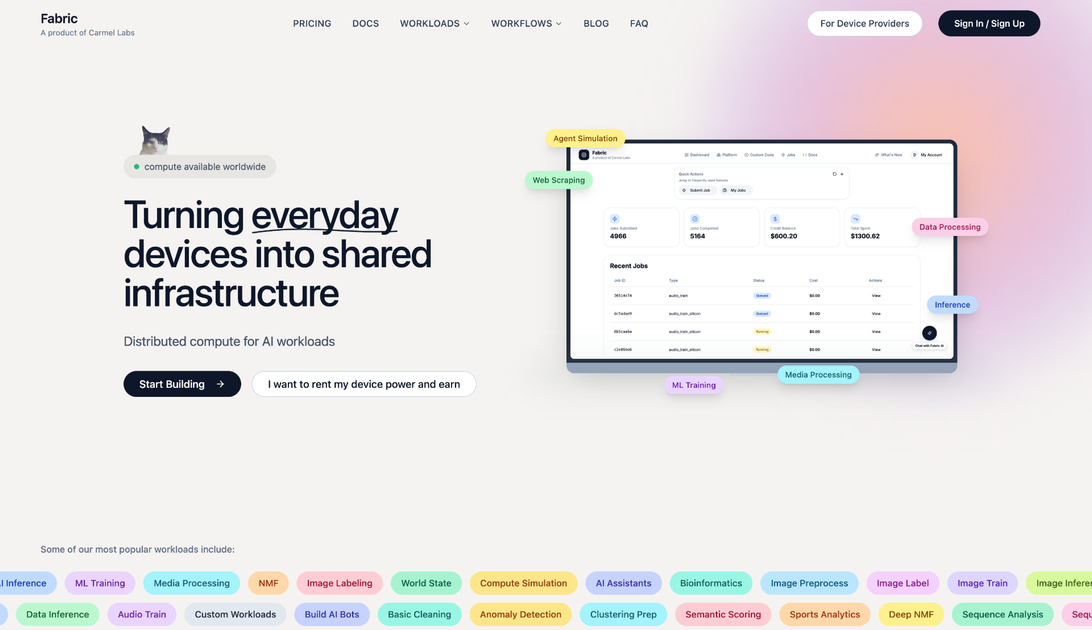

Fabricは、分散コンピューティングのためのグローバルでパーミッションレスなネットワークを構築することにより、次世代の分散インフラストラクチャの先駆けとなります。その核となるのは、大規模言語モデル(LLM)の推論や複雑な機械学習トレーニングなどの最新のAIワークロードに伴うコスト増大と集中化の問題を解決することです。世界中に散在する、データセンターから個々の高性能マシンに至るまで、利用されていないGPUおよびCPU容量を活用することで、Fabricは従来のクラウドプロバイダーに代わる、スケーラブルで回復力があり、大幅に安価な選択肢を提供します。

このネットワークは、コンピューティングプロバイダー(アイドルリソースを持つ者)が、ワークロードリクエスター(開発者、研究者、企業)からのコンピューティング要求に応えることで不労所得を得ることができるマーケットプレイスとして機能します。このピアツーピアモデルにより、オーバーヘッドが劇的に削減され、推論コストが標準的なクラウド料金のほんの一部となり、最先端のAI開発のための高性能コンピューティングへのアクセスを民主化します。

主な特徴

- 分散型コンピューティング集約: 世界中の膨大なアイドル状態のGPUおよびCPUパワーを接続し、ワークロードに対する高い可用性と地理的分散を保証します。

- コスト効率: 特に高負荷の推論ジョブにおいて、コンピューティング集約型タスクの価格を劇的に引き下げ、小規模チームやスタートアップでも高度なAIを利用しやすくします。

- 柔軟なワークロードサポート: リアルタイム推論、モデル提供、分散トレーニングジョブなど、要求の厳しいAI/MLタスクに最適化されています。

- パーミッションレスアクセス: 互換性のあるハードウェアを持つ誰もがプロバイダーとして参加でき、コンピューティングパワーを必要とする誰もがリクエスターとして参加できるため、真にオープンなエコシステムが促進されます。

- セキュリティと検証: 分散ノード全体でのデータと計算の完全性およびセキュリティを確保するための堅牢なメカニズムを利用しています。

- 不労所得の創出: コンピューティングプロバイダーは、ネットワークに貢献することで、既存のアイドルハードウェア資産を簡単に収益化できます。

Fabricの使い方

Fabricを使い始めるには、リソースを提供する側と消費する側で異なる経路があります。

コンピューティングプロバイダー向け(収入を得るため):

- ノードのセットアップ: 互換性のある高性能ハードウェア(特にGPU)があることを確認し、Fabricクライアントソフトウェアをマシンにインストールします。

- オンボーディングとステーキング: 画面の指示に従ってハードウェア容量を登録し、コミットメントと品質を示すためにトークンをステーキングする場合があります。

- ワークロードの受け入れ: システムは、ハードウェア仕様と地理的な近接性に基づいて、利用可能な容量を流入するコンピューティング要求に自動的にマッチングさせます。

- 検証と支払い: ジョブが完了し、ネットワークによって検証されると、直接支払いを受け取ります。

ワークロードリクエスター向け(ジョブの実行のため):

- 要件の定義: 必要なGPUタイプ(例:A100、H100)、メモリ、タスクの性質(例:LLM推論、ファインチューニング)など、計算ニーズを指定します。

- ジョブの送信: ワークロードパッケージ(例:Dockerコンテナ、モデルウェイト)をFabricネットワークに送信します。

- 自動マッチング: Fabricのオーケストレーションレイヤーがジョブをインテリジェントに分解し、最も適した、費用対効果の高いノードに分散します。

- 結果の取得: ジョブの進捗を監視し、完了時に最終的な出力またはモデル応答を安全に取得します。

ユースケース

- 大量LLM推論提供: 消費者向けAIアプリケーション(チャットボット、コンテンツ生成)を実行するスタートアップや企業は、Fabric上にモデルを展開することで、集中型クラウドAPIよりもはるかに低いコストで大量のリクエストを処理でき、利益率の向上につながります。

- AIモデルのファインチューニングと実験: 研究者やMLエンジニアは、高額な時間単位のGPUレンタル料金に制約されることなく、大規模な基盤モデルのファインチューニングを迅速に反復でき、発見のペースを加速させます。

- エッジAIデプロイメントとデータ処理: 大規模データセットの処理やデータソースに近い場所での推論実行が必要な企業は、Fabricの分散性を活用して、必要な場所にコンピューティングリソースを地理的に展開し、レイテンシを削減できます。

- 分散レンダリングとシミュレーション: 純粋なAI以外にも、Fabricは複雑な科学シミュレーションやバースト容量を必要とする3Dレンダリングファームなど、コンピューティング集約型のタスクをサポートできます。

- 独立系AI開発者: 以前は大規模モデルのトレーニングやデプロイに必要なインフラストラクチャを手に入れることができなかった個々の開発者は、手頃な価格でエンタープライズグレードのコンピューティングパワーにアクセスできるようになります。

FAQ

Q: Fabricはどのようにして私の独自のモデルとデータのセキュリティを確保するのですか? A: Fabricは、高度な暗号学的検証技術とコンテナ化(安全なDocker環境など)を採用してワークロードを分離します。データはプロバイダーのノード内で安全に処理され、支払い前に結果が検証されるため、知的財産が保護されます。

Q: Fabricネットワークで最も価値のあるハードウェアの種類は何ですか? A: 現在、最新のNVIDIA GPU(特にA10G、A100、H100のような高VRAMを持つもの)を搭載したハードウェアがAIワークロードで最も需要が高いです。ただし、コア数の多いCPUも、準備タスクや小規模な推論ジョブにとって価値があります。

Q: コンピューティングジョブの価格設定はどのように決定されますか? A: 価格設定は動的であり、供給(利用可能なプロバイダーの入札)と需要(リクエスターのニーズ)によって決定されます。プロバイダーは競争力のあるレートを設定し、ネットワークはリクエスターが指定した品質とレイテンシの要件を満たす、最も効率的なリソースの組み合わせを自動的に選択します。

Q: FabricはAI専用ですか、それとも汎用コンピューティングタスクを実行できますか? A: 現在の市場の需要によりAI/MLワークロードに重点的に最適化され宣伝されていますが、その基盤となるアーキテクチャは、コンテナ化されネットワーク全体で実行できる汎用分散コンピューティングタスクもサポートしています。

Q: ジョブの途中でコンピューティングプロバイダーがオフラインになった場合はどうなりますか? A: ネットワークは冗長性と耐障害性のメカニズムを利用します。ノードが失敗した場合、ジョブの残りのセグメントは、データ損失や大幅な遅延なしにジョブが完了するように、ネットワーク内の他の利用可能な検証済みノードに自動的に再配布されます。

代替品

AakarDev AI

AakarDev AIは、シームレスなベクターデータベース統合を通じてAIアプリケーションの開発を簡素化し、迅速な展開とスケーラビリティを実現する強力なプラットフォームです。

Ably Chat

Ably Chatはカスタムリアルタイムチャット用のAPI/SDK。リアクション、プレゼンス、メッセージ編集/削除に対応し高負荷も設計。

Paperpal

Paperpalは学術執筆向けAIツール。文献の読み取り、英語の校正・学術改稿、執筆コンポーネント生成、投稿前チェックと類似度検知をサポート。

VForms

VFormsは、YouTube動画上に直接インタラクティブなアンケートを重ねて表示できるようにすることで、非常に文脈に即したフィードバックと深いユーザーインサイトを収集可能にします。

BookAI.chat

BookAIは、書名と著者を提供するだけで、AIを使って本とチャットできるサービスです。

DeepMotion

DeepMotionはAIモーションキャプチャ/ボディトラッキングで、動画(テキストも可)からWebブラウザで3Dアニメを生成。Animate 3D API連携も。