Cekura 是什么?

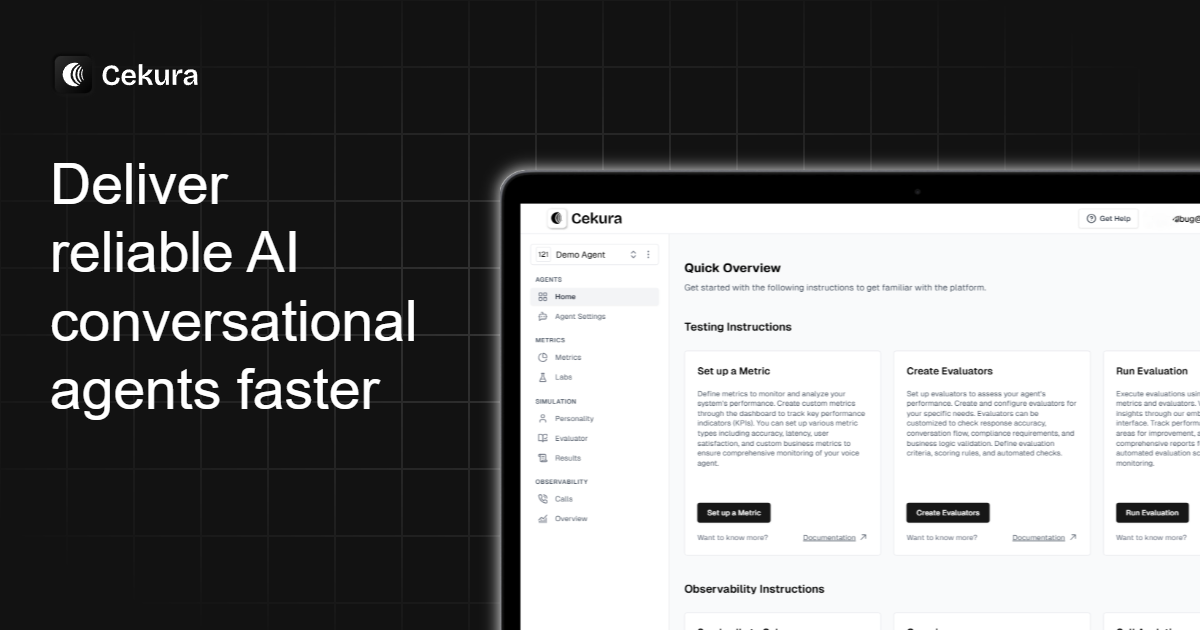

Cekura 是对话式 AI 代理(包括语音和聊天系统)的端到端测试与可观测性工具。其核心目的是帮助团队在发布前验证代理在多样化对话场景下的行为,并监控生产环境中的真实对话。

平台支持预上线仿真(测试指令遵循、工具调用和对话质量)和生产监控(检查通话并识别缺失检查或预期流程失败等问题)。

主要特性

- 语音与聊天代理的场景仿真:运行大规模场景预上线测试,验证代理在不同用户和对话条件下的行为。

- 基于角色和个性的测试:使用预定义角色(例如不同口音、性别和用户心态)评估代理在多样化对话风格下的响应是否合适。

- 并行调用与可操作评估:几分钟内执行仿真并生成评估结果,揭示核心用户流程相关问题。

- 已知问题对话重放:重新运行之前有问题的对话模式,防止提示或代理逻辑变更导致重复失败。

- 实时洞察与日志的可观测性:通过详细日志和趋势分析监控生产对话,评估指令遵循、工具调用及整体对话质量。

- 错误与性能下降告警:失败或性能退化时即时发送通知,便于团队快速响应。

如何使用 Cekura

- 创建或选择匹配代理工作流的场景(包括标准流程和边缘情况)。Cekura 提供数千个内置场景库,或支持自定义场景。

- 运行预上线仿真,使用角色测试代理对不同类型用户(例如困惑、中断式或偏离脚本用户)的表现。

- 审查评估结果,识别影响核心任务(例如取消、重新调度或跟进)的问题,并在提示或行为变更后使用重放重新测试已知问题点。

- 在生产环境中部署监控,观察真实对话、检查日志,并使用告警捕获失败、缺失检查或性能下降。

使用场景

- 预约流程的提示变更回归测试:当“新提示破坏预约取消”时,使用仿真查看变更如何影响取消、重调度及相关跟进任务。

- 处理中断与偏离脚本用户:评估代理是否能应对不耐烦或中断行为,同时遵循预期指导。

- 验证合规检查与免责声明:测试关键流程中是否遗漏合规步骤(例如确保必要免责或检查不被跳过)。

- 排查重复对话失败:重放“总是出问题的旧对话”以识别失败原因,并在更新后确认修复。

- 指令遵循与工具调用的生产监控:监控每通电话,检查代理是否正确遵循指令并执行预期工具调用,并跟踪时间趋势。

常见问题

-

Cekura 只测试预上线,还是也监控生产环境? Cekura 支持两者:预上线仿真用于评估,生产监控用于持续可观测性。

-

Cekura 进行哪些评估? 站点描述了对指令遵循、工具调用和对话质量的评估,包括共情/响应式评分及捕获跳过合规检查等示例检查。

-

可以测试不同类型用户和对话风格吗? 可以。Cekura 包含基于角色的测试(例如不同口音和用户心态),并支持自定义场景。

-

更改提示或代理行为时,Cekura 如何帮助? 它支持快速重新仿真核心用户流程并重放已知问题对话,以评估提示变更对结果的影响。

-

问题如何通知团队? 平台包含错误、失败和性能下降的即时通知/告警,同时提供日志和趋势分析。

替代方案

- 独立的 LLM/代理测试框架:专注于测试用例执行与评估的工具(通常缺乏完整的对话可观测性)。如果您已在其他地方处理监控,这些可能更合适。

- 对话分析与监控平台:专注于分析生产对话的解决方案(仪表板、日志、趋势),但可能无法提供同样结构化的上线前多角色仿真工作流。

- 客服支持 QA 与工单分析工具:事后分析支持交互的系统;有助于审查与报告,但可能无法提供指令遵循与工具调用的端到端仿真。

- 使用自定义脚本的代理工作流测试:自行构建场景运行与评分框架。这很灵活,但通常需要更多工程投入来实现多角色仿真、重放与告警工作流。

替代品

BenchSpan

BenchSpan 支持 AI agent 基准并行运行,自动记录得分与失败并整理运行历史;按提交标签复现,减少失败重跑浪费的 token。

PromptScout

PromptScout 监测你在 ChatGPT、Gemini、Google AI Overviews 和 Perplexity 的品牌提及、竞争对手推荐与引用来源,并结合网站审计与提示简报。

Sleek Analytics

Sleek Analytics 轻量且注重隐私的实时分析:查看访客来源、浏览页面和停留时长,了解站点当前互动。

Codex Plugins

使用 Codex Plugins 将技能、应用集成和 MCP 服务器打包成可复用工作流,扩展 Codex 访问 Gmail、Google Drive 与 Slack 等工具。

MacSpoof

MacSpoof 是 macOS 的 MAC 地址更改工具,可更改或随机 Wi‑Fi MAC 身份,重连网络并帮助减少公共 Wi‑Fi 的设备记录。

ClawTick

ClawTick 是 CLI 优先的 AI 代理自动化平台,可按 cron 调度基于 webhook 的任务,并提供监控、告警、重试与执行日志。