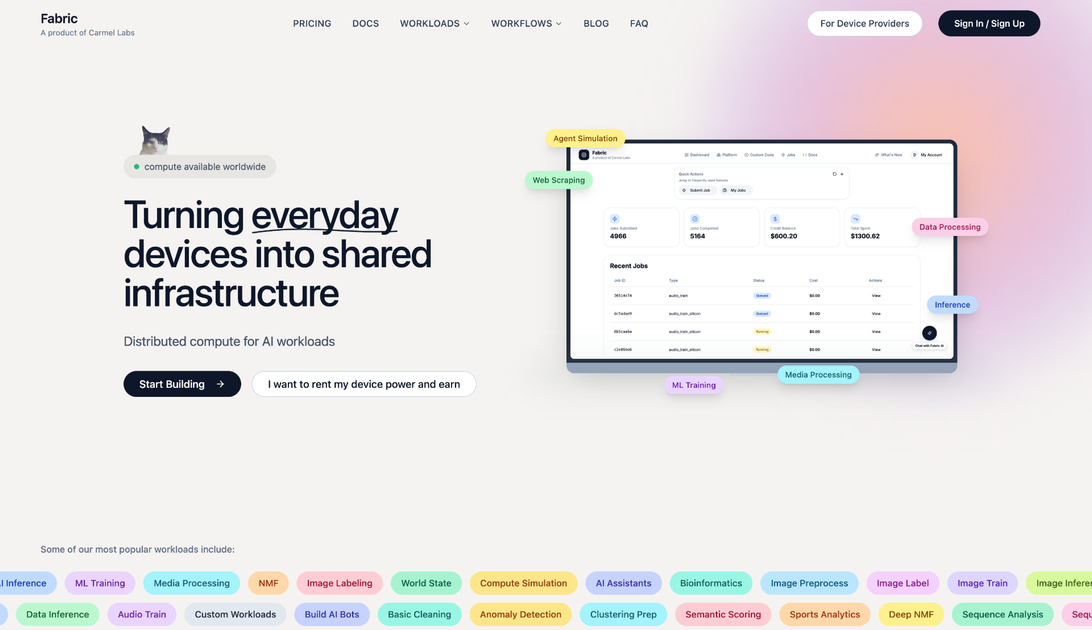

什么是 Fabric?

Fabric 通过创建一个全球性的、无需许可的分布式计算网络,引领下一代去中心化基础设施。其核心在于解决现代 AI 工作负载(如大型语言模型 (LLM) 推理和复杂的机器学习训练)所面临的成本不断攀升和中心化问题。通过利用全球范围内分散的、未充分利用的 GPU 和 CPU 容量——从数据中心到个人高性能机器——Fabric 为传统云提供商提供了一种可扩展、有弹性且成本显著更低的替代方案。

该网络充当一个市场,计算提供商(拥有闲置资源者)可以通过服务工作负载请求者(开发者、研究人员和企业)的计算请求来赚取被动收入。这种点对点模式极大地降低了开销,使得推理成本仅为标准云费率的一小部分,从而使前沿 AI 开发能够获得高性能计算的民主化访问。

核心特性

- 去中心化计算聚合: 连接全球范围内大量的闲置 GPU 和 CPU 算力,确保工作负载的高可用性和地理分布性。

- 成本效益: 为计算密集型任务(尤其是高容量推理工作)提供大幅降低的价格,使小型团队和初创公司也能负担得起先进的 AI。

- 灵活的工作负载支持: 针对要求严苛的 AI/ML 任务进行优化,包括实时推理、模型服务和分布式训练作业。

- 无需许可的访问: 欢迎任何拥有兼容硬件的人士加入成为提供商,或任何需要计算能力的人士加入成为请求者,从而培育一个真正开放的生态系统。

- 安全与验证: 利用强大的机制来确保跨分布式节点的数据和计算的完整性与安全性。

- 被动收入生成: 计算提供商可以通过为网络贡献资源,轻松地将其现有的闲置硬件资产货币化。

如何使用 Fabric

开始使用 Fabric 对提供资源者和消费资源者来说,有着不同的路径。

对于计算提供商(赚取收入):

- 设置节点: 在您的机器上安装 Fabric 客户端软件,确保您拥有兼容的高性能硬件(尤其是 GPU)。

- 入驻与质押: 遵循屏幕提示注册您的硬件容量,并可能需要质押代币以表明承诺和质量。

- 接受工作负载: 系统会根据硬件规格和地理位置的接近程度,自动将您的可用容量与传入的计算请求相匹配。

- 验证与支付: 作业完成后并经过网络验证,您将直接收到付款。

对于工作负载请求者(运行作业):

- 定义需求: 明确您的计算需求,包括所需的 GPU 类型(例如 A100、H100)、内存以及任务性质(例如 LLM 推理、微调)。

- 提交作业: 将您的工作负载包(例如 Docker 容器、模型权重)提交到 Fabric 网络。

- 自动匹配: Fabric 的编排层会智能地分解作业,并将其分配给最合适、最具成本效益的节点。

- 检索结果: 监控作业进度,并在完成后安全地检索最终输出或模型响应。

使用场景

- 高容量 LLM 推理服务: 运行面向消费者的 AI 应用(聊天机器人、内容生成)的初创公司和企业可以在 Fabric 上部署模型,以远低于中心化云 API 的成本处理海量请求量,从而提高利润率。

- AI 模型微调和实验: 研究人员和 ML 工程师可以快速迭代大型基础模型的微调工作,而不受高昂的小时 GPU 租用费用的限制,从而加速发现的步伐。

- 边缘 AI 部署和数据处理: 需要处理大型数据集或在更靠近数据源的位置运行推理的公司,可以利用 Fabric 的分布式特性,在需要时将计算资源部署到特定地理位置,从而减少延迟。

- 去中心化渲染和仿真: 除了纯粹的 AI 之外,Fabric 还可以支持其他计算密集型任务,例如需要突发容量的复杂科学模拟或 3D 渲染农场。

- 独立 AI 开发者: 以前因无法负担训练或部署大型模型所需基础设施的个人开发者,现在可以经济实惠地获取企业级的计算能力。

常见问题 (FAQ)

问:Fabric 如何确保我的专有模型和数据的安全? 答:Fabric 采用先进的加密验证技术和容器化技术(如安全的 Docker 环境)来隔离工作负载。数据在提供商的节点内安全处理,并在支付前验证结果,确保知识产权受到保护。

问:Fabric 网络上哪种类型的硬件最有价值? 答:目前,配备现代 NVIDIA GPU(尤其是具有高 VRAM 的,如 A10G、A100、H100)的硬件在 AI 工作负载中需求最高。然而,高核数的 CPU 对于某些准备任务和较小的推理作业也很有价值。

问:计算作业的定价是如何确定的? 答:定价是动态的,由供给(可用提供商的出价)和需求(请求者的需求)决定。提供商设定有竞争力的费率,网络会自动选择最能满足请求者指定质量和延迟要求的资源组合。

问:Fabric 仅限于 AI 吗,还是我可以运行通用计算任务? 答:虽然由于当前市场需求,Fabric 经过了针对 AI/ML 工作负载的重度优化和营销,但其底层架构支持可以在网络中容器化和执行的通用分布式计算任务。

问:如果一个计算提供商在作业中途离线会怎样? 答:网络利用冗余和容错机制。如果一个节点发生故障,作业的剩余部分会自动重新分配到网络中其他可用的、经过验证的节点上,以确保作业完成,而不会造成数据丢失或显著延迟。

替代品

AakarDev AI

AakarDev AI 是一个强大的平台,通过无缝的向量数据库集成简化 AI 应用程序的开发,实现快速部署和可扩展性。

Ably Chat

Ably Chat 提供聊天 API 和 SDK,用于自定义实时聊天应用:支持反应、在线/房间状态及消息编辑/删除,面向高并发场景。

Paperpal

Paperpal 面向学术写作的 AI 工具:支持智能文献阅读、英文润色学术改写、写作组件生成及投稿前检查与相似度检测。

VForms

VForms 允许在 YouTube 视频上直接叠加创建交互式问卷,使用户能够收集高度情境化的反馈和深入的用户洞察。

BookAI.chat

BookAI允许您通过简单提供书名和作者与您的书籍进行AI聊天。

DeepMotion

DeepMotion 是 AI 动作捕捉与人体追踪平台,可在浏览器中用视频(及文本)生成 3D 动画;并通过 Animate 3D API 便于开发集成。