Fabric

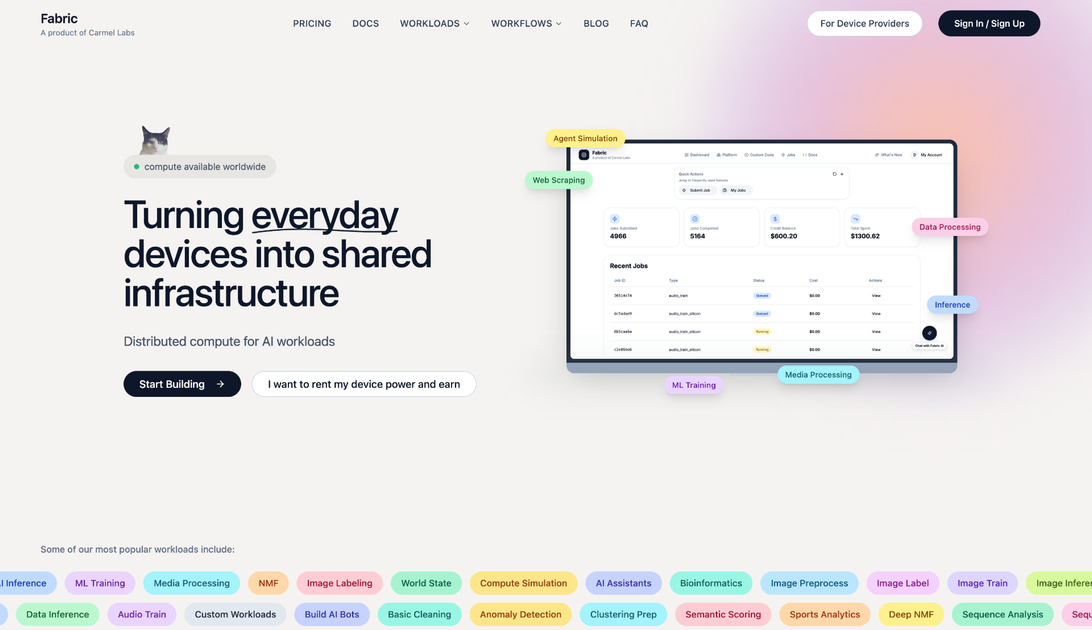

Fabric es una red de cómputo distribuida descentralizada que conecta recursos informáticos inactivos con cargas de trabajo exigentes de IA y aprendizaje automático, ofreciendo soluciones rentables para inferencia y entrenamiento.

¿Qué es Fabric?

Fabric está creando la próxima generación de infraestructura descentralizada al establecer una red global y sin permisos para el cómputo distribuido. En esencia, Fabric resuelve los crecientes problemas de costo y centralización asociados con las cargas de trabajo modernas de IA, como la inferencia de modelos de lenguaje grandes (LLM) y el entrenamiento complejo de aprendizaje automático. Al aprovechar la capacidad de GPU y CPU infrautilizada dispersa por todo el mundo —desde centros de datos hasta máquinas individuales de alto rendimiento—, Fabric proporciona una alternativa escalable, resiliente y significativamente más asequible a los proveedores de nube tradicionales.

Esta red funciona como un mercado donde los proveedores de cómputo (aquellos con recursos inactivos) pueden obtener ingresos pasivos al atender las solicitudes de cómputo de los solicitantes de cargas de trabajo (desarrolladores, investigadores y empresas). Este modelo peer-to-peer reduce drásticamente los gastos generales, lo que resulta en costos de inferencia que pueden ser una fracción de las tarifas estándar de la nube, democratizando el acceso a la computación de alto rendimiento para el desarrollo de IA de vanguardia.

Características Clave

- Agregación de Cómputo Descentralizado: Conecta vastas reservas de potencia de GPU y CPU inactivas a nivel mundial, asegurando alta disponibilidad y distribución geográfica para las cargas de trabajo.

- Eficiencia de Costos: Ofrece precios drásticamente reducidos para tareas intensivas en cómputo, particularmente para trabajos de inferencia de gran volumen, haciendo que la IA avanzada sea accesible para equipos más pequeños y startups.

- Soporte Flexible de Cargas de Trabajo: Optimizado para tareas exigentes de IA/ML, incluyendo inferencia en tiempo real, servicio de modelos y trabajos de entrenamiento distribuido.

- Acceso sin Permisos: Abierto a cualquiera con hardware compatible para unirse como proveedor o a cualquiera que necesite potencia de cómputo para unirse como solicitante, fomentando un ecosistema verdaderamente abierto.

- Seguridad y Verificación: Utiliza mecanismos robustos para garantizar la integridad y seguridad de los datos y la computación a través de los nodos distribuidos.

- Generación de Ingresos Pasivos: Los proveedores de cómputo pueden monetizar fácilmente sus activos de hardware inactivos existentes al contribuir a la red.

Cómo Usar Fabric

Comenzar con Fabric implica caminos distintos para quienes ofrecen recursos y para quienes los consumen.

Para Proveedores de Cómputo (Ganar Ingresos):

- Configurar Nodo: Instale el software cliente de Fabric en su máquina, asegurándose de tener hardware compatible y de alto rendimiento (especialmente GPUs).

- Incorporación y Staking: Siga las instrucciones en pantalla para registrar la capacidad de su hardware y potencialmente hacer staking de tokens para indicar compromiso y calidad.

- Aceptar Cargas de Trabajo: El sistema empareja automáticamente su capacidad disponible con las solicitudes de cómputo entrantes según las especificaciones del hardware y la proximidad geográfica.

- Verificación y Pago: Una vez que el trabajo se completa y es verificado por la red, usted recibe el pago directamente.

Para Solicitantes de Cargas de Trabajo (Ejecutar Trabajos):

- Definir Requisitos: Especifique sus necesidades computacionales, incluyendo el tipo de GPU requerido (ej. A100, H100), memoria y la naturaleza de la tarea (ej. inferencia LLM, ajuste fino).

- Enviar Trabajo: Envíe su paquete de carga de trabajo (ej. contenedor Docker, pesos del modelo) a la red Fabric.

- Emparejamiento Automatizado: La capa de orquestación de Fabric descompone inteligentemente el trabajo y lo distribuye entre los nodos más adecuados y rentables.

- Recuperar Resultados: Monitoree el progreso del trabajo y recupere de forma segura los resultados finales o las respuestas del modelo al finalizar.

Casos de Uso

- Servicio de Inferencia LLM de Alto Volumen: Las startups y empresas que ejecutan aplicaciones de IA orientadas al consumidor (chatbots, generación de contenido) pueden implementar sus modelos en Fabric para manejar volúmenes masivos de solicitudes a una fracción del costo de las APIs de nube centralizadas, lo que conduce a mejores márgenes.

- Ajuste Fino y Experimentación de Modelos de IA: Los investigadores e ingenieros de ML pueden iterar rápidamente en el ajuste fino de grandes modelos fundacionales sin estar limitados por las altas tarifas por hora de alquiler de GPU, acelerando el ritmo del descubrimiento.

- Despliegue de IA en el Borde y Procesamiento de Datos: Las empresas que necesitan procesar grandes conjuntos de datos o ejecutar inferencia más cerca de la fuente de datos pueden aprovechar la naturaleza distribuida de Fabric para desplegar recursos de cómputo geográficamente donde sea necesario, reduciendo la latencia.

- Renderizado y Simulación Descentralizados: Más allá de la IA pura, Fabric puede soportar otras tareas intensivas en cómputo como simulaciones científicas complejas o granjas de renderizado 3D que requieren capacidad de ráfaga.

- Desarrolladores de IA Independientes: Los desarrolladores individuales que anteriormente no podían pagar la infraestructura necesaria para entrenar o desplegar grandes modelos ahora pueden acceder a potencia de cómputo de nivel empresarial de manera asequible.

Preguntas Frecuentes (FAQ)

P: ¿Cómo garantiza Fabric la seguridad de mis modelos y datos propietarios? A: Fabric emplea técnicas avanzadas de verificación criptográfica y contenedorización (como entornos Docker seguros) para aislar las cargas de trabajo. Los datos se procesan de forma segura dentro del nodo del proveedor, y los resultados se verifican antes del pago, asegurando que la propiedad intelectual permanezca protegida.

P: ¿Qué tipo de hardware es más valioso en la red Fabric? A: Actualmente, el hardware equipado con GPUs NVIDIA modernas (especialmente aquellas con alta VRAM como A10G, A100, H100) tiene la mayor demanda para cargas de trabajo de IA. Sin embargo, las CPUs con un alto número de núcleos también son valiosas para ciertas tareas preparatorias y trabajos de inferencia más pequeños.

P: ¿Cómo se determina el precio para los trabajos de cómputo? A: El precio es dinámico, determinado por la oferta (ofertas de proveedores disponibles) y la demanda (necesidades del solicitante). Los proveedores establecen tarifas competitivas, y la red selecciona automáticamente la combinación más eficiente de recursos que cumplen con los requisitos de calidad y latencia especificados por el solicitante.

P: ¿Es Fabric solo para IA, o puedo ejecutar tareas de cómputo de propósito general? A: Si bien Fabric está fuertemente optimizado y comercializado para cargas de trabajo de IA/ML debido a la demanda actual del mercado, la arquitectura subyacente admite tareas de computación distribuida de propósito general que pueden ser contenidas y ejecutadas a través de la red.

P: ¿Qué sucede si un proveedor de cómputo se desconecta a mitad del trabajo? A: La red utiliza mecanismos de redundancia y tolerancia a fallos. Si un nodo falla, los segmentos restantes del trabajo se redistribuyen automáticamente a otros nodos disponibles y verificados en la red para garantizar la finalización del trabajo sin pérdida de datos ni retrasos significativos.

Alternativas

AakarDev AI

AakarDev AI es una plataforma poderosa que simplifica el desarrollo de aplicaciones de IA con integración fluida de bases de datos vectoriales, permitiendo un despliegue y escalabilidad rápidos.

Ably Chat

Ably Chat es una API y SDK de chat para crear aplicaciones personalizadas en tiempo real: reacciones, presencia y edición/eliminación de mensajes.

Paperpal

Paperpal es una herramienta de IA para escritura académica: lectura inteligente de literatura, pulido y reescritura en inglés, y revisión antes de enviar.

VForms

VForms permite la creación de cuestionarios interactivos superpuestos directamente sobre videos de YouTube, lo que permite a los usuarios recopilar comentarios altamente contextuales y obtener información profunda del usuario.

BookAI.chat

BookAI te permite chatear con tus libros usando IA simplemente proporcionando el título y el autor.

DeepMotion

DeepMotion es una plataforma de captura de movimiento con IA y body tracking para generar animaciones 3D desde video (y texto) en el navegador.