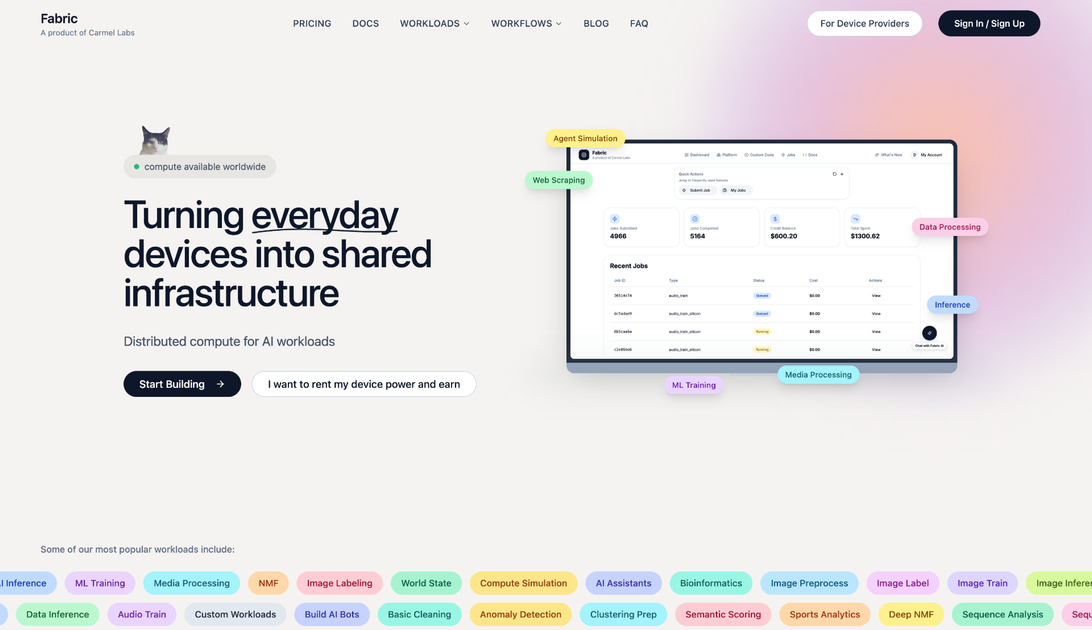

Fabric

Fabric est un réseau de calcul distribué décentralisé qui connecte les ressources informatiques inactives aux charges de travail d'IA et d'apprentissage automatique exigeantes, offrant des solutions rentables pour l'inférence et l'entraînement.

Qu'est-ce que Fabric ?

Fabric ouvre la voie à la prochaine génération d'infrastructure décentralisée en créant un réseau mondial et sans autorisation pour le calcul distribué. Au cœur de Fabric se trouve la résolution des problèmes croissants de coût et de centralisation associés aux charges de travail d'IA modernes, telles que l'inférence des grands modèles linguistiques (LLM) et l'entraînement complexe en apprentissage automatique. En exploitant la capacité GPU et CPU sous-utilisée, dispersée à travers le globe — des centres de données aux machines individuelles haute performance — Fabric offre une alternative évolutive, résiliente et nettement plus abordable aux fournisseurs de cloud traditionnels.

Ce réseau agit comme une place de marché où les fournisseurs de calcul (ceux disposant de ressources inactives) peuvent gagner un revenu passif en répondant aux demandes de calcul des demandeurs de charges de travail (développeurs, chercheurs et entreprises). Ce modèle pair-à-pair réduit considérablement les frais généraux, ce qui entraîne des coûts d'inférence qui peuvent représenter une fraction des tarifs standard du cloud, démocratisant ainsi l'accès au calcul haute performance pour le développement d'IA de pointe.

Fonctionnalités Clés

- Agrégation de Calcul Décentralisée : Connecte de vastes pools de puissance GPU et CPU inutilisée à l'échelle mondiale, assurant une haute disponibilité et une distribution géographique pour les charges de travail.

- Efficacité des Coûts : Offre des prix considérablement réduits pour les tâches gourmandes en calcul, en particulier pour les travaux d'inférence à volume élevé, rendant l'IA avancée accessible aux petites équipes et aux startups.

- Prise en Charge Flexible des Charges de Travail : Optimisé pour les tâches exigeantes d'IA/ML, y compris l'inférence en temps réel, le service de modèles et les travaux d'entraînement distribués.

- Accès Sans Autorisation : Ouvert à toute personne disposant d'un matériel compatible pour rejoindre en tant que fournisseur, ou à toute personne ayant besoin de puissance de calcul pour rejoindre en tant que demandeur, favorisant un écosystème véritablement ouvert.

- Sécurité et Vérification : Utilise des mécanismes robustes pour garantir l'intégrité et la sécurité des données et du calcul à travers les nœuds distribués.

- Génération de Revenus Passifs : Les fournisseurs de calcul peuvent facilement monétiser leurs actifs matériels inactifs existants en contribuant au réseau.

Comment Utiliser Fabric

Commencer avec Fabric implique des parcours distincts pour ceux qui offrent des ressources et ceux qui les consomment.

Pour les Fournisseurs de Calcul (Gagner des Revenus) :

- Configuration du Nœud : Installez le logiciel client Fabric sur votre machine, en vous assurant de disposer d'un matériel haute performance compatible (en particulier des GPU).

- Intégration et Staking : Suivez les instructions à l'écran pour enregistrer la capacité de votre matériel et potentiellement mettre en jeu des jetons pour signaler l'engagement et la qualité.

- Accepter les Charges de Travail : Le système fait correspondre automatiquement votre capacité disponible avec les demandes de calcul entrantes en fonction des spécifications matérielles et de la proximité géographique.

- Vérification et Paiement : Une fois le travail terminé et vérifié par le réseau, vous recevez le paiement directement.

Pour les Demandeurs de Charges de Travail (Exécuter des Tâches) :

- Définir les Exigences : Spécifiez vos besoins informatiques, y compris le type de GPU requis (par exemple, A100, H100), la mémoire et la nature de la tâche (par exemple, inférence LLM, réglage fin).

- Soumettre la Tâche : Soumettez votre package de charge de travail (par exemple, conteneur Docker, poids du modèle) au réseau Fabric.

- Correspondance Automatisée : La couche d'orchestration de Fabric décompose intelligemment la tâche et la distribue sur les nœuds les plus appropriés et les plus rentables.

- Récupérer les Résultats : Surveillez la progression de la tâche et récupérez en toute sécurité les sorties finales ou les réponses du modèle une fois terminé.

Cas d'Utilisation

- Service d'Inférence LLM à Grand Volume : Les startups et les entreprises exécutant des applications d'IA orientées consommateur (chatbots, génération de contenu) peuvent déployer leurs modèles sur Fabric pour gérer des volumes de requêtes massifs à une fraction du coût des API cloud centralisées, conduisant à de meilleures marges.

- Ajustement Fin et Expérimentation de Modèles d'IA : Les chercheurs et les ingénieurs ML peuvent itérer rapidement sur l'ajustement fin de grands modèles fondamentaux sans être contraints par des tarifs de location de GPU horaires élevés, accélérant ainsi le rythme de la découverte.

- Déploiement d'IA en Périphérie et Traitement des Données : Les entreprises ayant besoin de traiter de grands ensembles de données ou d'exécuter l'inférence plus près de la source de données peuvent tirer parti de la nature distribuée de Fabric pour déployer des ressources de calcul là où elles sont géographiquement nécessaires, réduisant ainsi la latence.

- Rendu et Simulation Décentralisés : Au-delà de l'IA pure, Fabric peut prendre en charge d'autres tâches gourmandes en calcul comme les simulations scientifiques complexes ou les fermes de rendu 3D qui nécessitent une capacité de rafale.

- Développeurs d'IA Indépendants : Les développeurs individuels qui n'avaient auparavant pas les moyens de s'offrir l'infrastructure nécessaire pour entraîner ou déployer de grands modèles peuvent désormais accéder à une puissance de calcul de qualité professionnelle à un prix abordable.

FAQ

Q : Comment Fabric assure-t-il la sécurité de mes modèles et données propriétaires ? A : Fabric emploie des techniques avancées de vérification cryptographique et de conteneurisation (comme des environnements Docker sécurisés) pour isoler les charges de travail. Les données sont traitées en toute sécurité dans le nœud du fournisseur, et les résultats sont vérifiés avant le paiement, garantissant que la propriété intellectuelle reste protégée.

Q : Quel type de matériel est le plus précieux sur le réseau Fabric ? A : Actuellement, le matériel équipé de GPU NVIDIA modernes (en particulier ceux avec une VRAM élevée comme A10G, A100, H100) est le plus demandé pour les charges de travail d'IA. Cependant, les CPU avec un nombre élevé de cœurs sont également précieux pour certaines tâches préparatoires et les petits travaux d'inférence.

Q : Comment les prix sont-ils déterminés pour les travaux de calcul ? A : Les prix sont dynamiques, déterminés par l'offre (enchères des fournisseurs disponibles) et la demande (besoins des demandeurs). Les fournisseurs fixent des tarifs compétitifs, et le réseau sélectionne automatiquement la combinaison la plus efficace de ressources qui répondent aux exigences de qualité et de latence spécifiées par le demandeur.

Q : Fabric est-il uniquement destiné à l'IA, ou puis-je exécuter des tâches de calcul à usage général ? A : Bien que Fabric soit fortement optimisé et commercialisé pour les charges de travail d'IA/ML en raison de la demande actuelle du marché, l'architecture sous-jacente prend en charge les tâches de calcul distribué à usage général qui peuvent être conteneurisées et exécutées sur le réseau.

Q : Que se passe-t-il si un fournisseur de calcul tombe en panne en cours de tâche ? A : Le réseau utilise des mécanismes de redondance et de tolérance aux pannes. Si un nœud échoue, les segments restants du travail sont automatiquement redistribués à d'autres nœuds vérifiés disponibles sur le réseau pour garantir l'achèvement de la tâche sans perte de données ni retards importants.

Alternatives

AakarDev AI

AakarDev AI est une plateforme puissante qui simplifie le développement d'applications d'IA avec une intégration fluide des bases de données vectorielles, permettant un déploiement rapide et une évolutivité.

Ably Chat

Ably Chat : API et SDK de chat temps réel pour créer des applications personnalisées, avec réactions, présence et édition/suppression de messages.

Paperpal

Paperpal est un outil d’IA pour l’écriture académique : lecture intelligente des articles, amélioration et reformulation en anglais, génération et contrôles avant soumission.

VForms

VForms permet la création de questionnaires interactifs superposés directement sur les vidéos YouTube, permettant aux utilisateurs de recueillir des commentaires hautement contextuels et des informations approfondies sur les utilisateurs.

BookAI.chat

BookAI vous permet de discuter avec vos livres en utilisant l'IA en fournissant simplement le titre et l'auteur.

DeepMotion

DeepMotion est une plateforme IA de motion capture et body-tracking pour générer des animations 3D à partir de vidéo (et texte) dans votre navigateur.