Phi-4-Vision-Reasoning

Modèle multimodal compact Phi-4-Vision-Reasoning : raisonnement IA, vision-langage et compréhension d'interface utilisateur performants.

Qu'est-ce que Phi-4-Vision-Reasoning ?

Phi-4-Vision-Reasoning est un modèle de raisonnement multimodal révolutionnaire de 15 milliards de paramètres, à poids ouverts, développé par Microsoft. Il représente une avancée significative dans le domaine de l'intelligence artificielle, offrant une solution puissante mais remarquablement compacte pour un large éventail de tâches de vision-langage. Ce modèle est conçu pour combler le fossé entre des capacités de raisonnement sophistiquées et un déploiement efficace, rendant l'IA avancée plus accessible et pratique pour diverses applications.

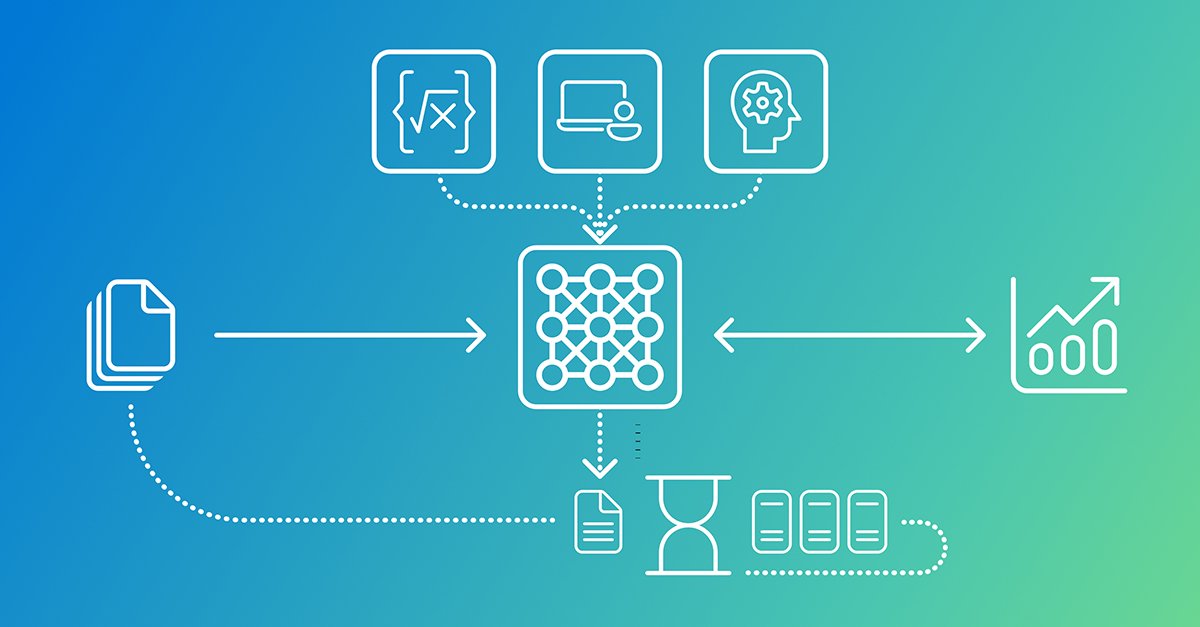

Au cœur de son fonctionnement, Phi-4-Vision-Reasoning est conçu pour comprendre et traiter à la fois les informations visuelles et textuelles, permettant une interaction naturelle et une résolution de problèmes complexe. Il excelle particulièrement dans les domaines nécessitant des compétences analytiques approfondies, comme le raisonnement mathématique et scientifique, et se distingue par son interprétation et son interaction avec les interfaces utilisateur graphiques sur les écrans d'ordinateurs et de mobiles. La conception du modèle privilégie un équilibre entre haute performance et efficacité computationnelle, remettant en question la tendance aux modèles de plus en plus volumineux qui entraînent souvent des coûts et une latence accrus. En tirant parti de choix architecturaux judicieux et d'une curation de données rigoureuse, Phi-4-Vision-Reasoning atteint des performances compétitives avec beaucoup moins de ressources computationnelles que de nombreux autres modèles à poids ouverts.

Fonctionnalités Clés pour le Raisonnement IA

- Compact et Efficace : Un modèle de 15 milliards de paramètres offrant des performances élevées avec des coûts computationnels et une latence réduits, le rendant adapté aux environnements aux ressources contraintes.

- Raisonnement Multimodal : Intègre et raisonne de manière transparente sur des données visuelles et textuelles pour un large éventail de tâches.

- Raisonnement Spécialisé : Excelle dans des domaines complexes comme les mathématiques et les sciences, fournissant une analyse précise et perspicace.

- Compréhension d'Interface Utilisateur : Capable de comprendre et d'ancrer des éléments au sein des interfaces d'écran d'ordinateurs et de mobiles.

- Capacités Étendues Vision-Langage : Prend en charge des tâches telles que la description d'images, la réponse aux questions visuelles, la lecture de documents et l'analyse de séquences.

- Modèle à Poids Ouverts : Disponible gratuitement pour la recherche et l'usage commercial, favorisant l'innovation communautaire et l'accessibilité.

- Performance sur la Frontière de Pareto : Atteint un compromis supérieur entre précision et coût de calcul par rapport à de nombreux modèles existants.

- Entraînement Efficace : Entraîné sur un ensemble de données de 200 milliards de tokens soigneusement sélectionnés, nettement inférieur à celui de nombreux modèles comparables, démontrant une utilisation efficace des données.

Comment Utiliser Phi-4-Vision-Reasoning

Commencer avec Phi-4-Vision-Reasoning est simple grâce à sa nature à poids ouverts et sa disponibilité sur les plateformes populaires. Les utilisateurs peuvent accéder au modèle via Microsoft Foundry, Hugging Face et GitHub.

- Accéder au Modèle : Téléchargez les poids du modèle depuis votre plateforme préférée (Hugging Face ou GitHub).

- Intégration : Intégrez le modèle dans vos flux de travail ou applications IA existants. Le modèle peut être utilisé pour diverses tâches de vision-langage.

- Données d'Entrée : Fournissez au modèle des entrées à la fois image et texte. Pour les tâches de compréhension d'interface utilisateur, saisissez des captures d'écran ou des enregistrements d'écran.

- Exécution de la Tâche : Utilisez le modèle pour des tâches telles que l'analyse d'images, la réponse à des questions sur le contenu visuel, la résolution de problèmes mathématiques présentés visuellement ou l'interprétation d'éléments d'interface utilisateur.

- Ajustement Fin (Optionnel) : Pour les applications spécialisées, le modèle peut être ajusté davantage sur des ensembles de données personnalisés afin d'améliorer les performances dans des domaines spécifiques.

La documentation détaillée et les meilleures pratiques pour l'entraînement et le déploiement sont disponibles avec la publication du modèle, guidant les utilisateurs sur l'optimisation de ses capacités.

Cas d'Usage de l'IA Multimodale

- Outils Éducatifs : Aider les étudiants avec leurs devoirs, en particulier en mathématiques et en sciences, en analysant les problèmes présentés visuellement ou textuellement.

- Logiciels d'Accessibilité : Aider les utilisateurs malvoyants à comprendre les images, les documents et les interfaces informatiques en fournissant des descriptions et des interactions détaillées.

- Support Client Automatisé : Analyser des captures d'écran de problèmes utilisateurs pour fournir une assistance de dépannage plus rapide et plus précise.

- Modération de Contenu : Examiner les images et le texte associé pour détecter les violations de politique, en particulier dans des contextes visuels complexes.

- Robotique et Automatisation : Permettre aux robots de comprendre leur environnement grâce à l'entrée visuelle et d'interagir avec les interfaces de contrôle.

- Analyse de Documents : Extraire des informations de reçus, de formulaires et de documents complexes, y compris la compréhension de la mise en page et des champs spécifiques.

FAQ sur Phi-4-Vision-Reasoning

-

Q : Qu'est-ce qui différencie Phi-4-Vision-Reasoning des autres modèles multimodaux ? R : Phi-4-Vision-Reasoning se distingue par son équilibre exceptionnel entre performance et efficacité. Il atteint une précision compétitive avec des exigences computationnelles et des temps d'inférence nettement inférieurs à ceux de nombreux modèles plus grands ou de taille similaire, excellant particulièrement dans les tâches de raisonnement et la compréhension d'interface utilisateur.

-

Q : Phi-4-Vision-Reasoning convient-il aux applications en temps réel ? R : Oui, sa taille compacte et sa conception efficace le rendent bien adapté aux applications en temps réel où une faible latence est cruciale, comme l'assistance interactive ou l'analyse d'environnement dynamique.

-

Q : Puis-je utiliser Phi-4-Vision-Reasoning à des fins commerciales ? R : Oui, Phi-4-Vision-Reasoning est un modèle à poids ouverts, ce qui signifie qu'il est disponible pour la recherche et l'usage commercial, encourageant une adoption et une innovation larges.

-

Q : Quel type de matériel est recommandé pour exécuter Phi-4-Vision-Reasoning ? R : Bien que les exigences spécifiques puissent varier en fonction de l'utilisation, sa conception efficace lui permet de fonctionner sur du matériel plus modeste par rapport aux modèles plus grands. Les recommandations matérielles détaillées se trouvent dans la documentation du modèle.

-

Q : Comment les données d'entraînement se comparent-elles à celles d'autres modèles ? R : Phi-4-Vision-Reasoning a été entraîné sur 200 milliards de tokens de données multimodales, un ensemble de données considérablement plus petit que celui de nombreux modèles comparables (par exemple, plus de 1 billion de tokens pour certains). Cette curation de données efficace est essentielle à sa performance et à sa rentabilité.

Alternatives

BookAI.chat

BookAI vous permet de discuter avec vos livres en utilisant l'IA en fournissant simplement le titre et l'auteur.

skills-janitor

skills-janitor audite, suit l’usage et compare vos compétences Claude Code avec neuf actions d’analyse par commandes slash, sans dépendances.

Struere

Struere est un système opérationnel natif AI qui remplace les workflows Excel par des logiciels structurés : tableaux de bord, alertes et automatisations.

garden-md

Transformez des transcriptions de réunion en wiki d’entreprise structuré et lié, via des fichiers markdown locaux et une vue HTML, avec synchronisation.

Falconer

Falconer est une plateforme de connaissances qui se met à jour automatiquement pour équipes rapides : écrivez, partagez et trouvez une documentation interne fiable.

AakarDev AI

AakarDev AI est une plateforme puissante qui simplifie le développement d'applications d'IA avec une intégration fluide des bases de données vectorielles, permettant un déploiement rapide et une évolutivité.