Playground by Natoma

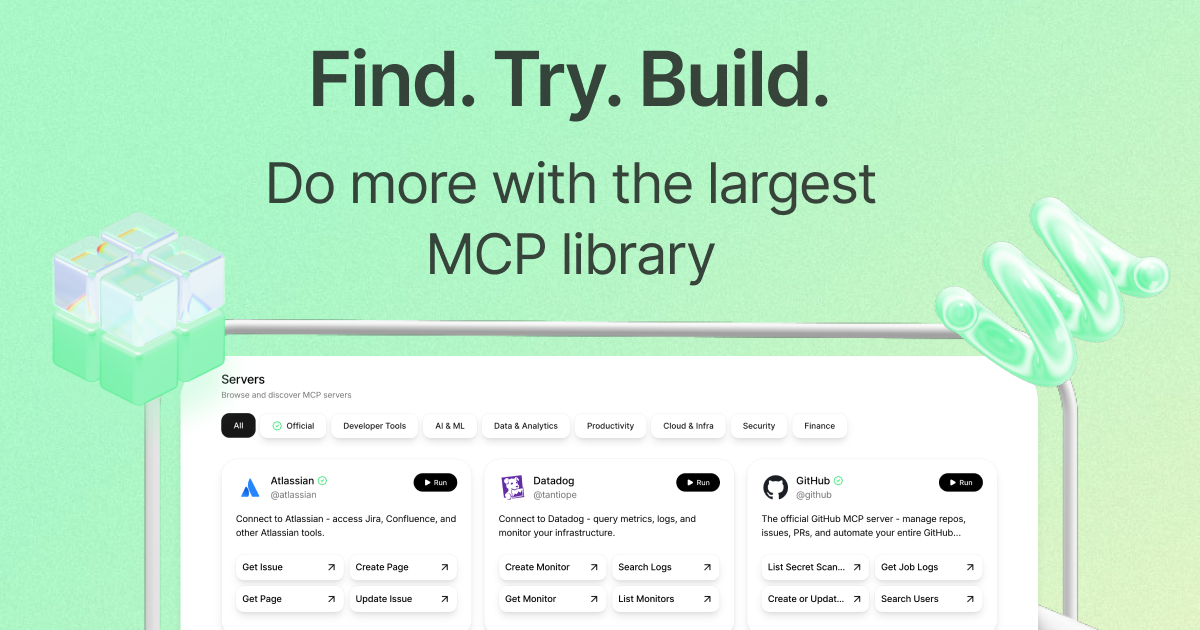

Playground by Natoma: scopri e prova facilmente i server MCP nel browser, senza setup. Sfoglia server ufficiali e per categoria, esegui azioni.

Cos'è Playground by Natoma?

Playground by Natoma è un'interfaccia web per esplorare e provare server MCP (Model Context Protocol). È pensata per una scoperta rapida: così puoi trovare un server MCP per uno strumento o fonte dati specifico ed eseguire azioni senza configurare un tuo ambiente.

La pagina elenca molti server MCP in categorie come Atlassian, Datadog, GitHub, Linear, Notion, Slack, Google Workspace e tooling per database/analisi. Ogni voce descrive cosa puoi fare (ad esempio, recuperare issue, interrogare metriche, cercare file o eseguire job) e offre un modo orientato alle azioni per “eseguire” quelle capacità.

Caratteristiche Principali

- Esplora server MCP per categoria (es. Produttività, Cloud & Infra, Sicurezza, Finanza) per restringere rapidamente ciò che ti serve.

- Scopri server MCP “ufficiali”, incluse integrazioni note come GitHub, Linear, Notion, Slack e altre.

- Esegui azioni dei server direttamente dal playground (es. crea/aggiorna elementi, cerca, recupera log o analisi) senza setup aggiuntivo menzionato nella pagina.

- Supporta workflow specifici per strumento in vari domini, come:

- Atlassian (azioni stile Jira/Confluence come ottieni/crea/aggiorna issue)

- Osservabilità (metriche/log/monitor Datadog; log/eventi/metriche/tracce Dynatrace)

- Codice e CI/CD (operazioni repo/issue/PR GitHub; job/build/status CircleCI)

- App business/produttività (pagine/database Notion; messaggi/ricerca/post Slack; operazioni issue/progetto Linear)

- Fornisce esempi di server per cloud e tooling dati, come AWS, Azure DevOps, Airbyte, Amplitude, Elasticsearch, Docker e Chroma (ricerca vettoriale/indicizzazione documenti).

Come Usare Playground by Natoma

- Apri Playground by Natoma ed esplora l'elenco dei server MCP disponibili.

- Seleziona il server MCP che corrisponde al tuo sistema target (es. GitHub per repo/issue/PR, o Datadog per metriche/log/monitor).

- Usa le azioni disponibili del server (mostrate come elementi eseguibili come “Get Issue”, “Search Logs”, “List Monitors”, “Create Page”, ecc.) per provare il workflow nel browser.

- Ripeti con azioni o server diversi per confrontare le capacità tra strumenti.

Casi d'Uso

- Test di un'integrazione MCP prima dello sviluppo: Prova azioni su un server MCP (es. gestione repo/issue/PR GitHub) per capire i tipi di operazioni disponibili.

- Risoluzione problemi osservabilità: Usa gli elenchi server MCP Datadog o Dynatrace per esplorare query log/metriche/monitor (e operazioni stile “get traces”/“query metrics”).

- Interazione knowledge-base e aggiornamenti contenuti: Usa le azioni server Notion per cercare pagine workspace, leggere/aggiornare contenuti e gestire database.

- Esplorazione automazione workflow team: Usa azioni server Linear o Slack per cercare issue/messaggi ed eseguire operazioni comuni come creare o aggiornare elementi.

- Esplorazione pipeline dati e analisi: Usa azioni server Airbyte per elencare destinazioni/sorgenti/connessioni o attivare sync; usa azioni server Amplitude/Elasticsearch/Chroma per interrogare analisi o eseguire ricerca e filtraggio.

FAQ

- Devo configurare qualcosa per provare i server MCP qui? La pagina indica un'esperienza “Simple, fast” con “No setup”, quindi puoi scoprire e provare i server direttamente via playground.

- È limitato a un solo tipo di server MCP? No. L'elenco include molte categorie (strumenti developer, app produttività, cloud/infrastruttura, sicurezza, analisi/dati).

- Che tipi di azioni posso eseguire? La pagina mostra operazioni orientate alle azioni come “run”, “search”, “list”, “create/update” e recupero task/job/log a seconda del server MCP scelto.

- Queste integrazioni sono legate a strumenti specifici come GitHub o Notion? Sì. L'elenco include server MCP nominati legati a quegli strumenti (es. GitHub, Notion, Slack, Linear, Atlassian).

Alternative

- Client/tool diretti per server MCP: Invece di sfogliare un playground centralizzato, puoi usare un client/host MCP che configuri tu stesso per connetterti a server MCP specifici e invocare azioni.

- API e dashboard specifici del vendor: Ad esempio, usare GitHub/GitHub Actions, API di Slack o console Datadog/Dynatrace direttamente può offrire capacità simili, ma senza il workflow unificato “esegui azioni server MCP”.

- Tool generali per test API: Strumenti che ti permettono di chiamare API HTTP e ispezionare le risposte possono servire per prototipare integrazioni, ma non sono organizzati intorno alle azioni e alla scoperta dei server MCP allo stesso modo.

- Console di query per dati/observability: Per casi d’uso data-intensive, le interfacce di query native (es. per analytics/logging/search) possono sostituire parti di ciò che aiuta a esplorare un playground server MCP—a seconda dei tuoi obiettivi di integrazione.

Alternative

AakarDev AI

AakarDev AI è una piattaforma potente che semplifica lo sviluppo di applicazioni AI con integrazione fluida dei database vettoriali, consentendo un rapido deployment e scalabilità.

Lasso

Lasso è un PIM AI-first per team ecommerce: arricchisce attributi e descrizioni, gestisce dati fornitori e consente monitoraggio competitor via app o API.

Ably Chat

Ably Chat è un’API e SDK per chat realtime: crea applicazioni personalizzate con reazioni, presenza e modifica/eliminazione dei messaggi.

Tavus

Tavus sviluppa sistemi AI in tempo reale per interazioni faccia a faccia: vedono, ascoltano e rispondono. Video agent, digital twin e companion via API.

HiringPartner.ai

HiringPartner.ai è una piattaforma di recruiting autonoma con agenti AI che ricercano, selezionano, chiamano e intervistano i candidati 24/7, riducendo il time-to-hire da settimane a appena 48 ore.

AgentMail

AgentMail è una Email Inbox API per agenti AI: crea, invia, ricevi e cerca email via REST per conversazioni bidirezionali.