Manifest

Manifest は OpenClaw 向けオープンソース LLM ルーター。クエリをローカルでスコアし、最も費用対効果の高いモデルへルーティング。トークン費用も追跡・制限可能。

Manifest とは?

Manifest は OpenClaw 向けのオープンソース LLM ルーターです。クエリをインターセプトし、各リクエストを最も費用対効果の高いモデルに送信してトークン使用コストを削減します。

プロジェクトページによると、Manifest はマシン上でクエリをローカルでスコアリング(2ms 未満)し、最適なモデルにルーティングします。また、トークンおよびメッセージコストを追跡し、使用制限やアラートを設定可能です。

主な機能

- ルーティング決定のためのローカルクエリスコアリング:Manifest は各クエリを 2ms 未満でローカル分析し、リクエストを転送します。

- 最も費用対効果の高いモデルへのルーティング:すべてのトラフィックを単一モデルに送るのではなく、リクエストごとに最適なモデルを選択します。

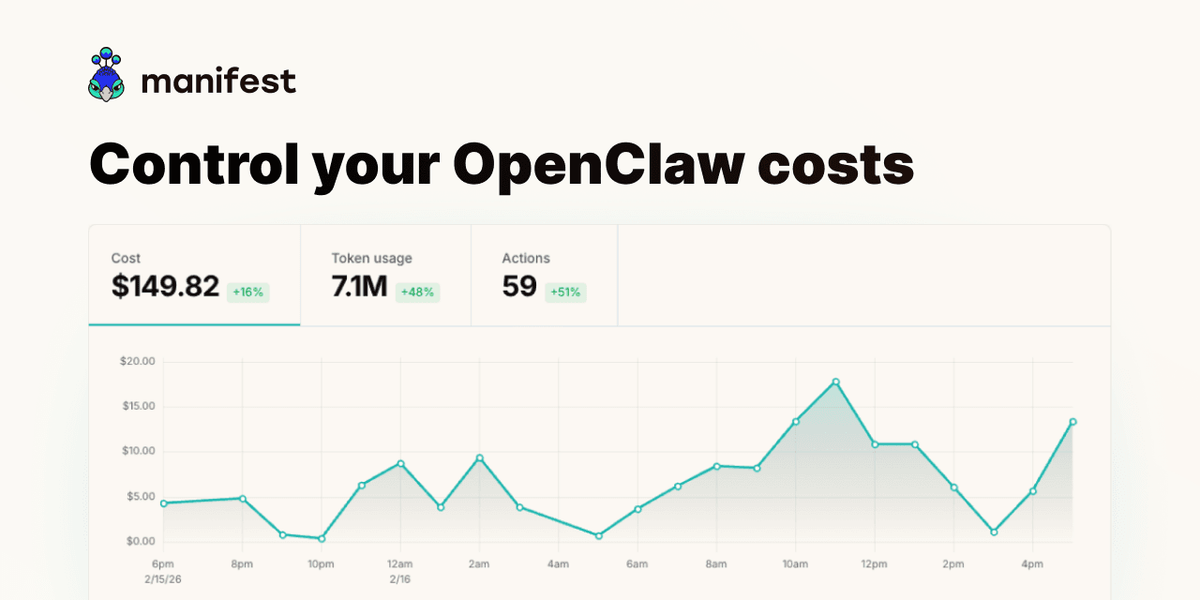

- メッセージごとのコスト追跡:ページではメッセージのトークンコスト測定と節約監視のガイドを説明しています。

- 使用制限とアラート:予算超過時に制限やアラートを設定できます。

- プライバシー重視のテレメトリ:ページではコンテンツ収集なしと述べ、テレメトリメタデータのみ使用し、デバイス上でクエリスコアリングを行います。また、プライバシー重視のアーキテクチャとして「クラウド版」を盲目的プロキシとして言及しています。

- OpenTelemetry 互換テレメトリ:Manifest は OpenTelemetry 標準を使用してテレメトリデータを収集・エクスポートします。

- オープンソースで検証可能:Manifest は完全にオープンソースで、検証・拡張・セルフホスティングが可能(ブラックボックスなし)。

- ネイティブ OpenClaw プラグイン:インストールはページで説明される1コマンド設定で、コーディング不要です。

Manifest の使い方

- ページで説明される1コマンドインストーラを使って、Manifest をネイティブ OpenClaw プラグインとしてインストールします。

- OpenClaw を Manifest 経由で設定し、モデル選択前にリクエストをインターセプトします。

- OpenClaw 経由でリクエストを送信開始;Manifest が各クエリをローカルスコアリングし、選択モデルにルーティングします。

- Manifest が生成するコストとトークンデータを確認し、予算内に収まるよう使用制限やアラートを設定します。

- テレメトリをエクスポートする場合、プロジェクトで説明される OpenTelemetry 形式を使用して観測性ワークフローに統合します。

ユースケース

- クエリの複雑度が異なる場合のコスト削減:タスクの一部が小規模(または低能力)で他が高度な場合、Manifest が各リクエストを費用対効果の高いモデルにルーティングします。

- 稼働中のデプロイメントでの予算管理:チームは使用制限やアラートを設定し、支出閾値到達時にコスト停止や通知をトリガーできます。

- プライバシー制約下での運用:デバイス上での決定を好む場合、ページではクエリスコアリングがマシン上で行われ、コンテンツは収集されない(テレメトリメタデータのみ)と述べています。

- モデル使用コストの監視と監査:各メッセージのコスト追跡と OpenTelemetry 経由のテレメトリエクスポートにより、トークン支出の変化を把握できます。

- ルーティングロジックのセルフホスティングや検証:Manifest がオープンソースで検証・セルフホスティングをサポートするため、開発者は環境に合わせて動作を確認・適応できます。

FAQ

Manifest は私のコンテンツを収集しますか?

ページでは、Manifest はコンテンツを収集せず、テレメトリメタデータのみ使用すると述べています。また、クエリスコアリングはマシン上で行われます。

Manifest はどのモデルを使うかをどう決定しますか?

Manifest は各クエリをローカルで分析(ページによると 2ms 未満)し、そのスコアリングに基づいて最適/費用対効果の高いモデルにリクエストをルーティングします。

トークン数とコストの使用量を監視できますか?

はい。ページではトークン/メッセージコストの追跡を説明し、予算超過時に制限やアラートを設定する機能を備えています。

Manifest はオープンソースですか?

はい。ページでは完全にオープンソースで、検証・拡張・セルフホスティングが可能と述べています。

テレメトリはどのように扱われますか?

Manifest は OpenTelemetry 標準を使用してテレメトリデータを収集・エクスポートします。ページではテレメトリメタデータのみ収集しプライバシーを重視すると強調しています。

代替案

- セルフマネージド LLM ルーティングサービス: OpenClaw プラグインの代わりに、自分でルーターサービスを運用してリクエストごとにモデルを選択。利便性を犠牲にルーティングとスコアリングのカスタム制御を得る。

- ルーティングなしの OpenTelemetry ベース監視: 主な目的がコストとモデル使用量の監視なら、モデル選択・ルーティングではなくテレメトリ/監視ツールに注力。

- 手動モデル選択のシングルモデルデプロイ: 一部のセットアップでは全リクエストを1モデルにルーティング(またはクライアント選択)。シンプルだが、クエリごとの費用対効果によるモデル切り替えはしない。

- その他の AI プロキシ/ゲートウェイアプローチ: スタック次第で AI ゲートウェイ/プロキシパターンを用いてリクエストを仲介。ただし、Manifest が説明する OpenClaw プラグインモデルとはワークフローが異なる可能性。

代替品

AakarDev AI

AakarDev AIは、シームレスなベクターデータベース統合を通じてAIアプリケーションの開発を簡素化し、迅速な展開とスケーラビリティを実現する強力なプラットフォームです。

BenchSpan

BenchSpanはAIエージェントのベンチマークを並列実行し、スコアと失敗を整理した実行履歴に記録。コミット連携で再現性向上。

Edgee

Edgeeは、プロンプトを圧縮してLLMプロバイダーへ送るエッジネイティブAIゲートウェイ。OpenAI互換APIで200+モデルへルーティング。

Pioneer AI by Fastino Labs

Pioneer AI by Fastino LabsはAdaptive Inferenceと継続評価で、ライブ推論データからオープンソース言語モデルを改良するエージェント型微調整基盤です。

Codex Plugins

Codex Pluginsでスキル、アプリ連携、MCPサーバーを再利用可能なワークフローにまとめ、Gmail・Google Drive・Slack等のツールにアクセス。

Whirr

WhirrはmacOSのメニューバー常駐アプリ。Claude Codeエージェントの作業状況をノッチに静かにミラーし、画面確認なしで一目確認。