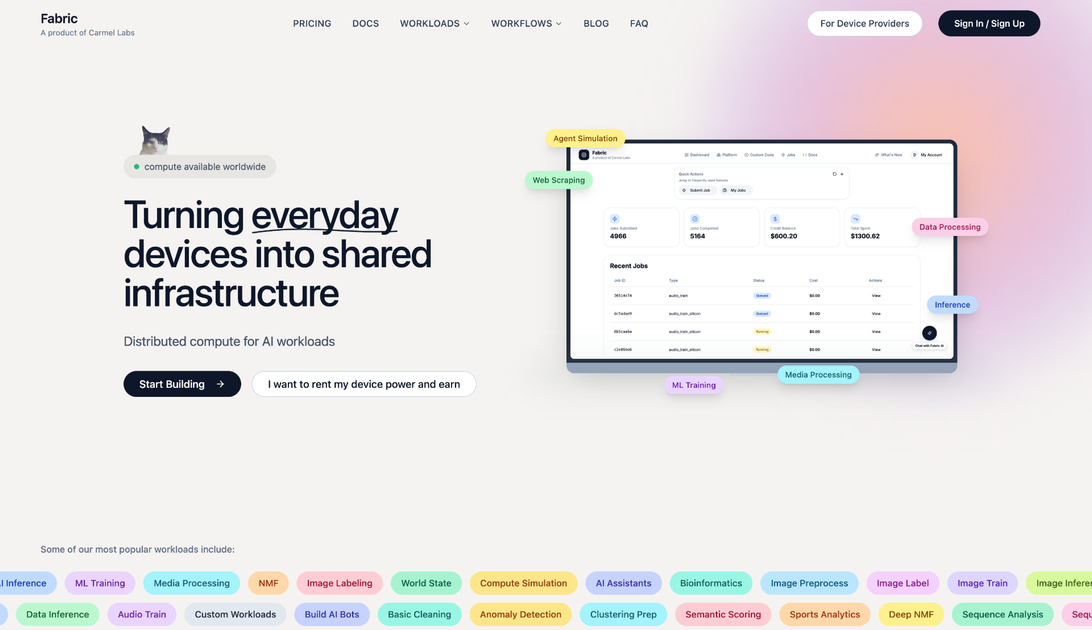

Fabric

Fabric — это децентрализованная распределенная вычислительная сеть, которая связывает незадействованные вычислительные ресурсы с требовательными рабочими нагрузками в области искусственного интеллекта (ИИ) и машинного обучения (МО), предлагая экономически эффективные решения для инференса и обучения.

Что такое Fabric?

Fabric прокладывает путь к следующему поколению децентрализованной инфраструктуры, создавая глобальную, не требующую разрешений сеть для распределенных вычислений. По своей сути, Fabric решает растущие проблемы стоимости и централизации, связанные с современными рабочими нагрузками ИИ, такими как инференс больших языковых моделей (LLM) и сложное обучение машинного обучения. Используя неиспользуемые мощности GPU и CPU, разбросанные по всему миру — от центров обработки данных до отдельных высокопроизводительных машин — Fabric предоставляет масштабируемую, отказоустойчивую и значительно более доступную альтернативу традиционным облачным провайдерам.

Эта сеть действует как маркетплейс, где поставщики вычислительных ресурсов (те, у кого есть незадействованные ресурсы) могут получать пассивный доход, выполняя запросы на вычисления от заказчиков (разработчиков, исследователей и предприятий). Эта модель "равный к равному" резко снижает накладные расходы, что приводит к стоимости инференса, составляющей долю от стандартных облачных тарифов, демократизируя доступ к высокопроизводительным вычислениям для передовой разработки ИИ.

Ключевые особенности

- Агрегация децентрализованных вычислений: Объединяет огромные пулы незадействованной мощности GPU и CPU по всему миру, обеспечивая высокую доступность и географическое распределение для рабочих нагрузок.

- Экономическая эффективность: Предлагает значительно сниженные цены на ресурсоемкие задачи, особенно для задач инференса с большим объемом, делая передовой ИИ доступным для небольших команд и стартапов.

- Гибкая поддержка рабочих нагрузок: Оптимизирована для требовательных задач ИИ/МО, включая инференс в реальном времени, обслуживание моделей и распределенное обучение.

- Открытый доступ (Permissionless Access): Открыта для любого, у кого есть совместимое оборудование, чтобы присоединиться в качестве поставщика, или для любого, кому требуется вычислительная мощность, чтобы присоединиться в качестве заказчика, способствуя созданию по-настоящему открытой экосистемы.

- Безопасность и верификация: Использует надежные механизмы для обеспечения целостности и безопасности данных и вычислений в распределенных узлах.

- Генерация пассивного дохода: Поставщики вычислительных ресурсов могут легко монетизировать свои существующие незадействованные аппаратные активы, внося вклад в сеть.

Как использовать Fabric

Начало работы с Fabric включает в себя разные пути для тех, кто предлагает ресурсы, и тех, кто их потребляет.

Для поставщиков вычислительных ресурсов (получение дохода):

- Настройка узла: Установите клиентское программное обеспечение Fabric на свою машину, убедившись, что у вас есть совместимое, высокопроизводительное оборудование (особенно GPU).

- Онбординг и стейкинг: Следуйте инструкциям на экране, чтобы зарегистрировать мощность вашего оборудования и, возможно, внести токены в стейкинг, чтобы подтвердить приверженность и качество.

- Принятие рабочих нагрузок: Система автоматически сопоставляет вашу доступную мощность с входящими запросами на вычисления на основе спецификаций оборудования и географической близости.

- Верификация и выплата: После завершения и проверки задания сетью вы получаете оплату напрямую.

Для заказчиков рабочих нагрузок (запуск заданий):

- Определение требований: Укажите свои вычислительные потребности, включая требуемый тип GPU (например, A100, H100), память и характер задачи (например, инференс LLM, дообучение).

- Отправка задания: Отправьте пакет вашей рабочей нагрузки (например, Docker-контейнер, веса модели) в сеть Fabric.

- Автоматическое сопоставление: Уровень оркестрации Fabric интеллектуально разбивает задание и распределяет его по наиболее подходящим и экономически эффективным узлам.

- Получение результатов: Отслеживайте ход выполнения задания и безопасно извлекайте окончательные результаты или ответы модели по завершении.

Сценарии использования

- Обслуживание LLM-инференса с высоким объемом: Стартапы и предприятия, запускающие ИИ-приложения, ориентированные на потребителей (чат-боты, генерация контента), могут развертывать свои модели на Fabric для обработки огромных объемов запросов по цене, составляющей долю от стоимости централизованных облачных API, что приводит к лучшей маржинальности.

- Дообучение и эксперименты с моделями ИИ: Исследователи и инженеры МО могут быстро итерировать дообучение больших базовых моделей, не будучи ограниченными высокими почасовыми ставками аренды GPU, что ускоряет темпы открытий.

- Развертывание периферийного ИИ и обработка данных: Компании, которым необходимо обрабатывать большие наборы данных или выполнять инференс ближе к источнику данных, могут использовать децентрализованную природу Fabric для развертывания вычислительных ресурсов географически там, где это необходимо, снижая задержки.

- Децентрализованный рендеринг и симуляция: Помимо чистого ИИ, Fabric может поддерживать другие ресурсоемкие задачи, такие как сложные научные симуляции или фермы 3D-рендеринга, требующие пиковой мощности.

- Независимые разработчики ИИ: Отдельные разработчики, которые ранее не могли позволить себе инфраструктуру, необходимую для обучения или развертывания больших моделей, теперь могут получить доступ к вычислительной мощности корпоративного уровня по доступной цене.

Часто задаваемые вопросы (FAQ)

В: Как Fabric обеспечивает безопасность моих проприетарных моделей и данных? О: Fabric использует передовые методы криптографической верификации и контейнеризацию (например, безопасные среды Docker) для изоляции рабочих нагрузок. Данные обрабатываются безопасно внутри узла поставщика, а результаты проверяются перед выплатой, что гарантирует защиту интеллектуальной собственности.

В: Какое оборудование наиболее ценно в сети Fabric? О: В настоящее время оборудование, оснащенное современными графическими процессорами NVIDIA (особенно с большим объемом видеопамяти, такими как A10G, A100, H100), пользуется наибольшим спросом для рабочих нагрузок ИИ. Однако высокоядерные процессоры также ценны для определенных подготовительных задач и небольших заданий инференса.

В: Как определяется ценообразование для вычислительных заданий? О: Ценообразование динамическое, определяется спросом (потребности заказчика) и предложением (предложения поставщиков). Поставщики устанавливают конкурентоспособные тарифы, а сеть автоматически выбирает наиболее эффективную комбинацию ресурсов, соответствующую требованиям к качеству и задержке, указанным заказчиком.

В: Fabric предназначен только для ИИ, или я могу запускать общецелевые вычислительные задачи? О: Хотя Fabric сильно оптимизирован и позиционируется для рабочих нагрузок ИИ/МО из-за текущего рыночного спроса, базовая архитектура поддерживает общецелевые распределенные вычислительные задачи, которые могут быть контейнеризированы и выполнены в сети.

В: Что произойдет, если поставщик вычислительных ресурсов отключится в середине задания? О: Сеть использует механизмы избыточности и отказоустойчивости. Если узел выходит из строя, оставшиеся сегменты задания автоматически перераспределяются на другие доступные, проверенные узлы в сети для обеспечения завершения задания без потери данных или значительных задержек.

Альтернативы

AakarDev AI

AakarDev AI — это мощная платформа, которая упрощает разработку приложений ИИ с бесшовной интеграцией векторных баз данных, позволяя быстрое развертывание и масштабируемость.

Ably Chat

Ably Chat — chat API и SDK для кастомных realtime-приложений: реакции, presence и правка/удаление сообщений для чатов в масштабе.

Paperpal

Paperpal — AI‑инструмент для академического письма: чтение литературы, английская правка и научный rewriter, генерация и проверка перед投稿 и похожестью.

VForms

VForms позволяет создавать интерактивные опросники, накладываемые непосредственно поверх видео YouTube, что дает возможность собирать высококонтекстную обратную связь и глубокие инсайты пользователей.

BookAI.chat

BookAI позволяет вам общаться с вашими книгами, просто предоставив название и автора.

DeepMotion

DeepMotion — платформа ИИ для motion capture и body-tracking: создавайте 3D-анимации из видео (и текста) в браузере; интеграция через Animate 3D API.