Arlopass 是什么?

Arlopass 是一个免费开源的浏览器扩展和开发 SDK,帮助网页应用在不将您的 API 密钥暴露给浏览器或服务器代理的情况下使用您的 AI 提供商。与将凭证硬编码到应用中不同,Arlopass 在用户端处理提供商连接和路由。

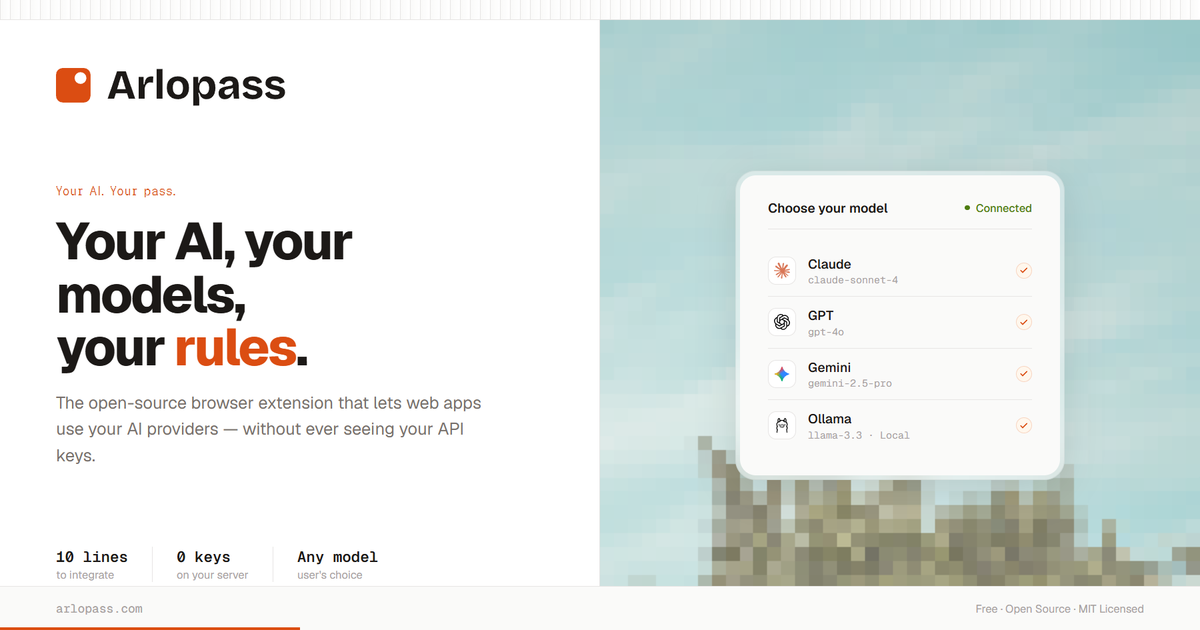

使用 Arlopass,用户可以选择特定站点允许访问哪些 AI 提供商和模型、批准连接请求,并设置规则,例如是否每次请求都需要许可。目标是让模型选择和凭证处理始终由用户掌控。

主要特性

- 按应用 AI 访问的浏览器扩展:当网页应用通过 Arlopass 请求 AI 使用时,用户可以批准或拒绝连接,并选择允许的提供商/模型。

- 提供商和模型选择:用户可以切换提供商(例如 Ollama、Claude、OpenAI/GPT、Gemini、Bedrock),并选择站点可用的具体模型。

- 本地凭证存储库(密钥不在浏览器/服务器中):API 凭证存储在设备上的本地存储库中,静态加密(AES-256-GCM)。源文本指出密钥绝不会置于浏览器中,也不会发送到服务器。

- “零密钥管理”工作流程:对开发者和用户而言,界面聚焦于批准访问和选择模型,而非在应用代码中管理密钥。

- 开发 SDK,集成仅需约 10 行代码:提供的示例使用

connect()和session.createChat()配合chat.stream(...)通过异步迭代器流式输出响应,用户端的 Arlopass 处理提供商认证和路由。 - 按应用权限规则和限制:UI 支持“始终询问许可”、连续调用“自动驾驶模式”,以及“每日令牌限制”设置。

如何使用 Arlopass

- 安装 Chrome 扩展,从 Chrome 网上应用店获取。

- 在 Arlopass 中连接您的 AI 提供商(源文本显示 Ollama、Claude、OpenAI、Gemini、Bedrock)。凭证加密存储在您的设备本地存储库中。

- 为特定网页应用允许访问:当站点请求 AI 使用时,Arlopass 会提示您选择允许的提供商和模型,然后确认安全会话。

- 在应用中使用 SDK(面向开发者):安装

@arlopass/web-sdk,调用connect(),创建聊天会话,并从chat.stream(...)流式获取结果。您的应用不会接收或存储 API 密钥。

使用场景

- 特定网站的用户控制 AI 访问:您可以连接后限制单个站点(例如仅允许该站点的 Claude 模型),同时拒绝其他站点。

- 无需更改应用代码即可切换模型:如果站点允许多个提供商/模型,用户可以更新权限以使用不同模型,而应用继续调用 Arlopass。

- 权限确认 vs. 自动化请求流程:对于高敏感任务,保持“始终询问许可”启用;对于轻量工作流,启用“自动驾驶模式”以运行连续 AI 调用而无需每次提示。

- 通过每日令牌限制进行限流:为每个连接的应用设置“每日令牌限制”(源文本显示示例 100k / 50k),以控制消耗。

- 开发者无需后端代理即可集成:开发者无需构建服务器端凭证代理,只需使用 SDK 通过 Arlopass 路由 AI 请求,将用户凭证保留在设备上。

常见问题

-

Arlopass 会将我的 API 密钥暴露给浏览器吗?

不会。源文本指出凭证加密存储在您的设备本地存储库中,不会置于浏览器中。

-

开发者需要在服务器或代码中管理 API 密钥吗?

源文本强调“零密钥管理”和“无需后端代理”,SDK 示例显示

connect()和会话创建无需开发者查看或存储 API 密钥。 -

用户可以批准站点使用哪些提供商和模型吗?

可以。连接流程包括为请求应用选择提供商(步骤 1)和模型(步骤 2)。

-

是否有选项要求每次 AI 请求都确认?

有。权限 UI 包含“始终询问许可”,以及连续调用的“自动驾驶模式”。

-

可以为应用的用法设置哪些限制?

源文本提到“每日令牌限制”,并在应用权限 UI 中显示示例令牌限制值。

替代方案

- 网页应用中的直接提供商 API 集成:你可以从服务器直接调用模型提供商,但通常需要自行处理 API 密钥和路由,而不是依赖用户端的凭证存储库和按应用审批。

- LLM 的服务器端代理服务:另一种方法是构建后端来持有凭证并转发请求。这与 Arlopass 不同,后者将密钥管理移至用户设备而非你的基础设施。

- 用户管理密钥的客户端模型调用:某些设置要求用户将 API 密钥粘贴到浏览器或客户端中。这与 Arlopass 声明的方法不同,后者将凭证保存在本地加密存储库中而非浏览器内。

替代品

AakarDev AI

AakarDev AI 是一个强大的平台,通过无缝的向量数据库集成简化 AI 应用程序的开发,实现快速部署和可扩展性。

Arduino VENTUNO Q

Arduino VENTUNO Q 边缘AI电脑,集成AI推理与微控制器确定性控制;用 Arduino App Lab 打通嵌入式、Linux与边缘AI开发。

Devin

Devin 是 AI 编程代理,帮助软件团队并行完成代码迁移与大规模重构子任务;工程师负责项目管理并批准改动。

BenchSpan

BenchSpan 支持 AI agent 基准并行运行,自动记录得分与失败并整理运行历史;按提交标签复现,减少失败重跑浪费的 token。

open-codex-computer-use

open-codex-computer-use 是开源“电脑使用”服务的 MCP 服务器封装,让 AI 代理在 macOS/Linux/Windows 上执行桌面 GUI 操作。

Codex Plugins

使用 Codex Plugins 将技能、应用集成和 MCP 服务器打包成可复用工作流,扩展 Codex 访问 Gmail、Google Drive 与 Slack 等工具。